11 月 3 日,LinkedIn 將開始與 Microsoft 及其附屬公司共享您的資料以進行 AI 訓練。您預設為選擇加入,但還有時間對此採取行動。

這項新的 LinkedIn AI 政策似乎符合 Microsoft 將更多資料輸入其 AI 生態系統的更廣泛策略(新視窗)。就在幾週前,該公司宣布 Word 文件將預設開始儲存到 OneDrive,Excel 和 PowerPoint 也將緊隨其後。此舉引發了疑慮,即將個人或專業檔案轉移到 Microsoft 的雲端可能會如何與 AI 訓練交叉,特別是考慮到 Microsoft 對 ChatGPT 的製造商 OpenAI 的數十億美元投資。

為什麼 LinkedIn 要變更其資料隱私設定?

9 月 18 日,LinkedIn 宣布(新視窗)從 2025 年 11 月 3 日開始,來自歐盟、歐洲經濟區和瑞士使用者的資料將與 Microsoft 及其附屬公司共享以進行 AI 訓練。您在該日期之後仍然可以選擇退出,但這不會影響過去的資料:在此之前您在 LinkedIn 上分享的資訊都是公平競爭的。

此公告是在加州一項訴訟指控 LinkedIn(新視窗) 秘密與第三方分享私人訊息以訓練 AI 模型之後發布的。該公司否認了這些說法,並隨後更新了其隱私文件,指明英國、歐洲經濟區和瑞士的使用者被排除在這些變更之外。但現在,該平台正在將相同的 AI 訓練政策擴展到這些地區。

LinkedIn 將使用哪些資料進行 AI 訓練?

以下是可能用於 AI 管道的 LinkedIn 資料類型:

- 個人檔案資料,包括姓名、相片、目前職位、過去工作經驗、教育程度、位置、技能、出版物、專利、認可和推薦。

- 工作相關資料,例如履歷、篩選問題的回覆和申請詳細資料。

- 會員內容,例如貼文、文章、民意調查回覆、貢獻和留言。

- 群組資料,包括活動和訊息。

- 意見回饋,包括您提供的評分和回應。在選擇退出後,LinkedIn 仍可能使用您的意見回饋並將其與您關聯。

以下內容被明確排除:私人訊息、登入憑證、付款方式、信用卡詳細資料,以及可以連結到特定個人的會員提供的薪資或申請資料。

如果 LinkedIn 有理由相信您未滿 18 歲——例如,如果您正在讀中學或其當地同等學歷——您的資料將不會被用於訓練內容生成 AI 模型,即使您的設定是開啟的。

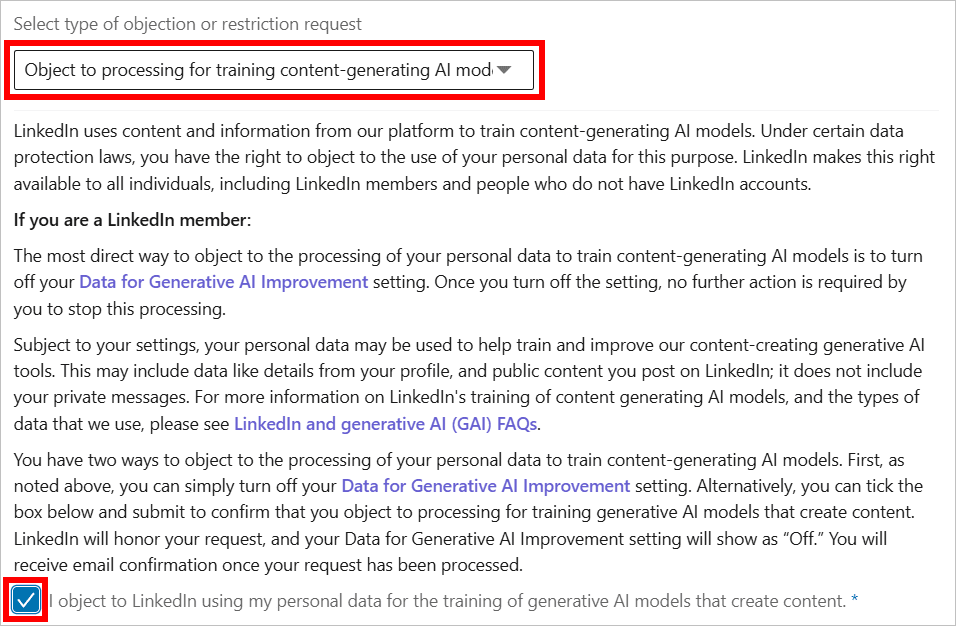

LinkedIn 澄清所有這些資訊都可能被其生成式 AI 模型使用——這些系統會生成建議貼文或自動起草訊息等內容。雖然它提供了選擇退出設定,但僅適用於內容生成 AI。要阻止 LinkedIn 將您的意見回饋用於非內容 AI 模型——如個人化、安全性、信任或反濫用——唯一的選擇是提交資料處理異議表。

如何在 LinkedIn 上選擇退出 AI 訓練

以下是您如何在隱私設定中選擇退出 AI 訓練:

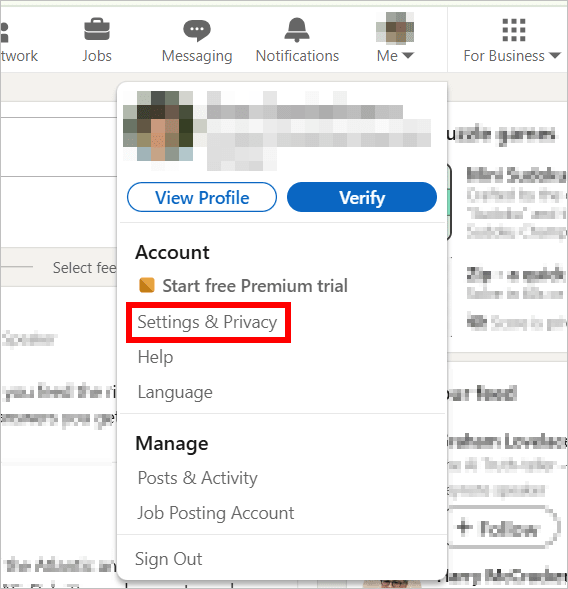

- 選取設定和隱私。

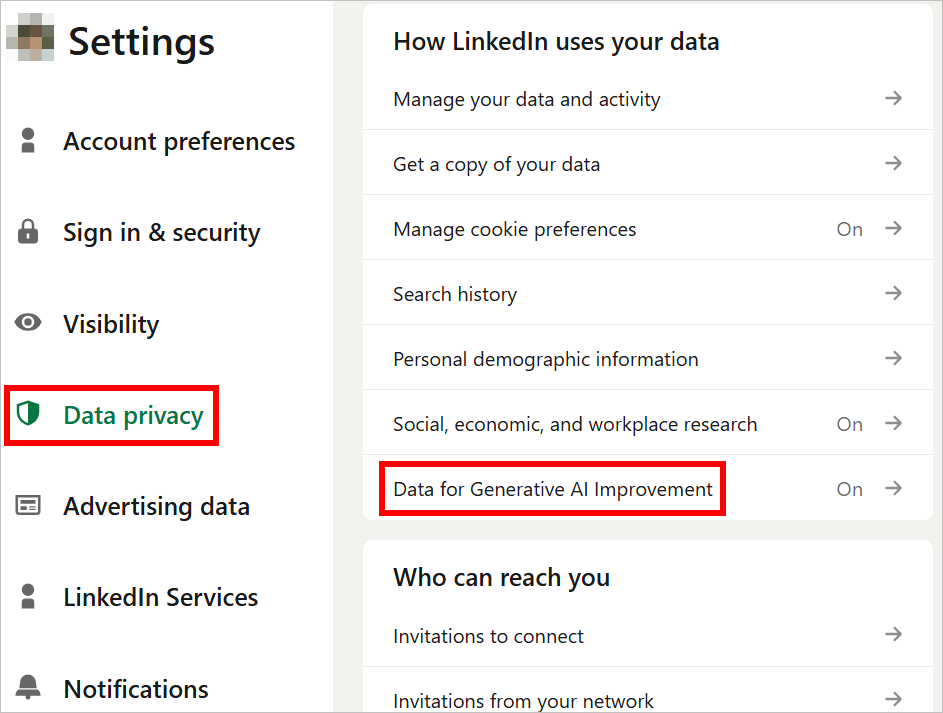

- 前往資料隱私 → 生成式 AI 改進資料。

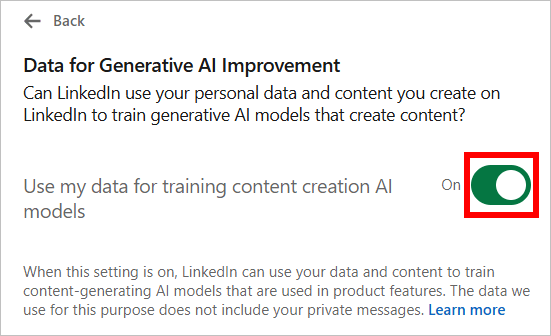

- 關閉使用我的資料進行內容創作 AI 模型訓練。

- 存取資料處理異議表(新視窗),選取反對處理用於訓練內容生成 AI 模型,並傳送請求。非會員如果其個人資料被會員在 LinkedIn 上分享,也可以提出異議。

如果您在美國或 LinkedIn 已經推出這些設定的其他地區,您可能已經受到影響。而在 11 月 3 日之後,歐盟、歐洲經濟區和瑞士的使用者也將被納入。但您仍然可以採取步驟減少您的暴露:

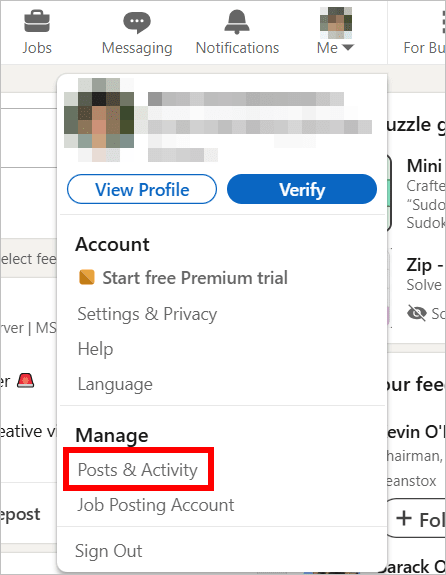

- 審核並清理可能包含敏感資訊的舊貼文。例如,您可以前往管理 → 貼文和活動輕鬆查看您發布的所有內容。

- 審核您的帳號個人檔案並刪除任何您不願意與 LinkedIn AI 模型分享的內容,例如生日、電話號碼或地址。

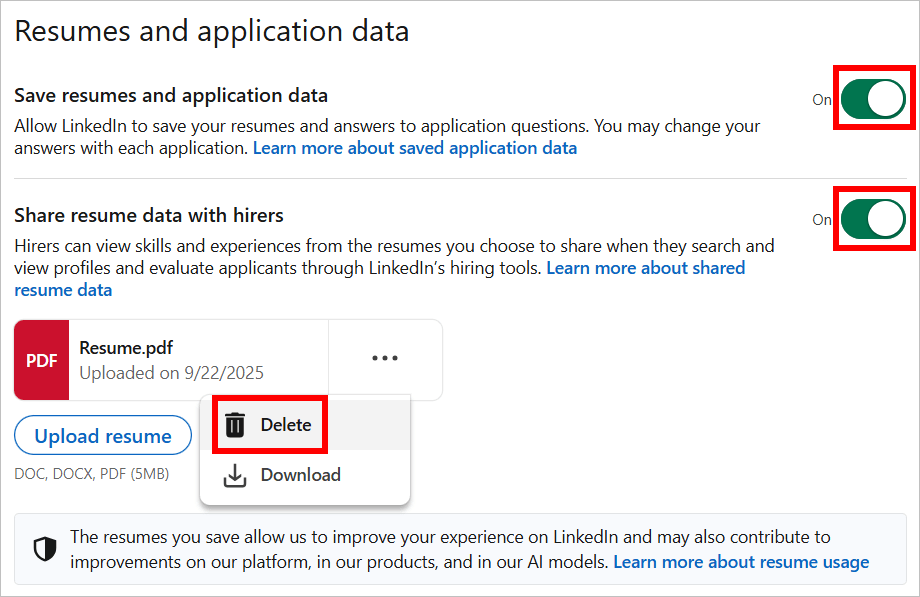

- 前往資料隱私 → 工作申請設定並刪除您上載到 LinkedIn 的任何履歷。

- 假設您發布的任何公開內容,例如技能、留言或行業見解,都可能被用於訓練 AI。

注意:如果其他人分享您的資訊,您的資訊仍可能最終進入 AI 訓練。例如,如果同事轉發您的文章或引用您的履歷,該資訊仍可能被拉入訓練管道。

您的職涯資料不應成為 AI 訓練燃料

LinkedIn 並不是第一個透過預設將使用者選擇加入來擴展其 AI 訓練資料集的平台。例如,Facebook (新視窗)一直在使用公開貼文(新視窗),而 Google 最近與 Reddit 達成協議(新視窗)。但作為一個儲存履歷、工作申請和專業互動的招聘平台,LinkedIn 的舉動引發了關於您的數位職涯身分如何助長 AI 管道的疑慮。

在 Proton,我們相信您的專業歷史和職涯資料應該只屬於您自己。這就是為什麼我們建立具有端對端加密的工具,所以無論如何我們都無法存取您的私人資訊。而且我們絕不使用它來訓練 AI 模型。我們的業務是保護您的資料,而不是重新利用它。