ChatGPT este un asistent IA(fereastră nouă) puternic, folosit zilnic de milioane de utilizatori zilnic, dar este sigur de utilizat? Este deținut și operat de OpenAI, una dintre cele mai mari companii tech din lume. Și, ca multe platforme Big Tech, OpenAI colectează cantități mari de date despre utilizatori. Aceste date nu sunt protejate prin criptare cu acces zero, astfel încât compania le poate divulga partenerilor de afaceri (inclusiv companiilor de publicitate și analiză), guvernului și hackerilor în cazul unui incident de încălcare a datelor.

În spatele scenei, modelele lingvistice mari (LLM) ale OpenAI învață constant din ceea ce tastați. Întrebările sensibile, cum ar fi cele despre simptome medicale, chestiuni juridice sau proprietate intelectuală, pot alimenta sisteme complexe de profilare sau pot ajuta la antrenarea unor modele de IA folosite mult dincolo de intenția dvs. inițială.

Preocupările legate de modul în care companiile de IA gestionează datele utilizatorilor cresc. În martie 2026, peste 2,5 milioane de utilizatori(fereastră nouă) s-au angajat să părăsească ChatGPT după ce un parteneriat controversat cu guvernul SUA a ridicat întrebări despre modul în care sistemele de IA sunt implementate și guvernate. Este un memento că, atunci când interacționați cu un asistent IA fără protecții puternice de confidențialitate, este posibil să partajați mai multe informații decât vă dați seama.

- Este ChatGPT sigur? Riscurile utilizării IA precum ChatGPT și ale altor companii Big Tech

- Lucruri pe care nu ar trebui niciodată să le partajați cu ChatGPT

- Cum să rămâneți în siguranță când folosiți ChatGPT

- Treceți la un asistent IA privat

Este ChatGPT sigur? Riscurile utilizării IA precum ChatGPT și ale altor companii Big Tech

Înainte de a alege instrumente IA precum ChatGPT, Gemini, Meta AI, Copilot și DeepSeek, merită să le înțelegeți riscurile de securitate și de confidențialitate:

| Risc | Impact potențial | De ce contează |

| Colectarea și jurnalizarea datelor | Prompturile, încărcările de fișiere și tiparele de interacțiune pot fi stocate | Pot fi folosite pentru antrenarea IA, profilare comportamentală sau revizuire umană |

| Lipsa criptării cu acces zero | Conversațiile pot fi accesate de OpenAI și partenerii săi | Crește riscul expunerii datelor sensibile |

| Preocupări de reglementare și privind proprietatea intelectuală | Expunere la GDPR/HIPAA sau divulgări de date proprietare | Răspundere juridică și consecințe financiare |

| Sistem cu sursă închisă | Transparență limitată privind gestionarea datelor | Necesită încredere în OpenAI |

| Reclame în aplicație | Urmărire și profilare sporite | Nu este clar cum influențează datele din chat reclamele personalizate |

Confidențialitate personală

Iată ce riscați folosind ChatGPT:

- ChatGPT poate colecta informațiile pe care le introduceți — cum ar fi întrebări, răspunsuri și modul în care interacționați cu instrumentul — pentru a-și antrena modelele de IA. Dacă încărcați un CV, un document juridic, un raport medical sau un alt fișier cu date personale, și acel conținut poate fi stocat și prelucrat.

- Chiar dacă nu introduceți niciodată numele dvs. sau alte date personale, prompturile dvs. pot dezvălui în timp tipare, precum preocupări legate de sănătate, îndoieli religioase, înclinații politice, statut familial sau stare emoțională. Combinat cu adresa IP(fereastră nouă) și alți identificatori tehnici, aceste tipare pot fi folosite pentru a construi profiluri comportamentale detaliate.

- S-ar putea să puteți renunța la antrenarea IA, dar conversațiile dvs. sunt în continuare jurnalizate, iar detaliile sensibile ar putea fi văzute de revizori umani dacă sunt semnalate, cum ar fi atunci când trimiteți feedback.

- Istoricul dvs. de chat este protejat în timpul trimiterii și stocării, dar nu este protejat prin criptare cu acces zero, astfel încât OpenAI sau un terț pot totuși accesa conversațiile dvs. anterioare.

- În iulie 2025, mii de conversații ChatGPT partajate au apărut în rezultatele căutării Google(fereastră nouă), expunând schimburi profund personale pe care utilizatorii probabil le considerau private. OpenAI a retras rapid funcția și a spus că lucra cu Google pentru a elimina indexarea rezultatelor, dar incidentul evidențiază cât de ușor pot interacțiunile cu IA să ajungă în domeniul public fără să vă dați seama.

- La începutul anului 2026, OpenAI a introdus reclame pentru utilizatorii ChatGPT din planurile gratuit și ChatGPT Go. În ciuda asigurărilor că reclamele nu vor influența răspunsurile și nu vor implica partajarea datelor personale cu advertiserii, această schimbare urmează un model Big Tech bine stabilit, în care publicitatea ajunge în cele din urmă să fie normalizată după îngrijorări inițiale privind confidențialitatea.

Risc de business

OpenAI este o companie din SUA, așa că utilizarea ChatGPT poate ridica preocupări privind protecția datelor și riscuri de divulgare a informațiilor sensibile. Dacă vă aflați în Europa sau în altă parte, datele dvs. ar putea fi totuși supuse jurisdicției SUA, deoarece sunt prelucrate de o companie americană. Iată ce înseamnă asta:

- Fără garanții solide de protecție a datelor, organizația dvs. riscă amenzi sau control de reglementare în baza unor legi precum GDPR și HIPAA(fereastră nouă).

- Vă expuneți la divulgări prin antrenarea modelelor de IA cu datele companiei dvs. De exemplu, angajații ar putea introduce în ChatGPT cod proprietar, contracte confidențiale sau informații despre clienți, expunând potențial proprietate intelectuală, secrete comerciale sau date despre clienți.

- OpenAI poate partaja date cu parteneri, furnizori, alți terți sau prin integrări de aplicații — care ar putea avea protecții mai slabe de confidențialitate sau politici diferite privind datele. În 2025, o încălcare care a implicat unul dintre furnizorii de analiză ai OpenAI a expus informații de identificare despre clienții API.

- Conform legilor SUA precum Patriot Act sau FISA (Foreign Intelligence Surveillance Act), companiile pot fi obligate să furnizeze date agențiilor guvernamentale, adesea însoțite de ordine de confidențialitate care le împiedică să notifice utilizatorii.

Lipsă de transparență

Cele de mai sus sunt riscuri cunoscute. Dar ceea ce este deosebit de riscant la ChatGPT (și la alte software-uri cu sursă închisă) este ceea ce nu vi se permite să știți.

- Codul aplicațiilor ChatGPT nu este cod sursă public, deci nu există supraveghere publică asupra modului în care funcționează, ce jurnalizează sau cum vă prelucrează datele în culise. Trebuie să vă bazați pe politicile OpenAI și să aveți încredere că sistemul gestionează datele în mod responsabil.

- Deși OpenAI a lansat modele cu ponderi deschise care pot fi examinate public, modelele de IA pe care le folosește ChatGPT nu sunt cu cod sursă public, așa că nu puteți verifica modul în care datele au fost preantrenate pe seturi mari de date.

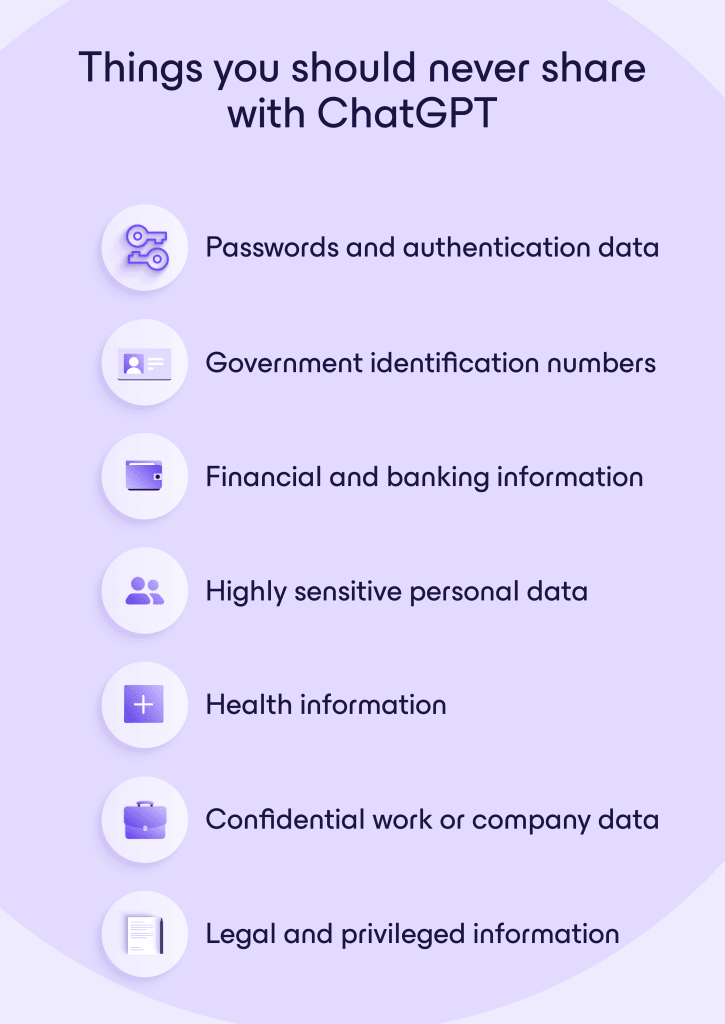

Lucruri pe care nu ar trebui niciodată să le partajați cu ChatGPT

Chiar dacă ChatGPT poate fi util, nu ar trebui niciodată să îl tratați ca pe un seif securizat pentru informații sensibile. Evitați să introduceți orice v-ar putea afecta pe dvs., compania dvs. sau alte persoane dacă ar fi stocat, revizuit sau expus accidental:

Parole și date de autentificare, cum ar fi parolele conturilor, codurile de autentificare cu doi factori (A2F), codurile de autentificare de backup sau cheile API private.

Numere de identificare guvernamentale, inclusiv numere de securitate socială, carte națională de identitate, pașaport, permis de conducere și numere de identificare fiscală.

Informații financiare și bancare, cum ar fi numere de card de credit sau de debit, IBAN-uri, acreditări pentru banking conectat, conectări la conturi de investiții sau chei private pentru portofele Bitcoin.

Date personale extrem de sensibile care ar putea fi folosite pentru a vă identifica sau urmări pe dvs. ori familia dvs., cum ar fi adresa de acasă și numărul de telefon, data nașterii sau fotografii ori documente private.

Informații medicale, cum ar fi rapoarte medicale, înregistrări de diagnostic, numere de asigurare, ID-uri de pacient sau istorice medicale detaliate asociate identității dvs.

Date confidențiale de muncă sau ale companiei, inclusiv cod sursă proprietar, documente interne de strategie, contracte confidențiale, baze de date cu clienți, detalii despre clienți, proiecții financiare, rapoarte nepublicate sau NDA-uri.

Informații juridice și privilegiate, cum ar fi comunicări avocat-client, strategii pentru cazuri juridice, documente cu dovezi sau discuții confidențiale privind soluționări.

Cum să rămâneți în siguranță când folosiți ChatGPT

Nu trebuie să evitați complet instrumentele IA, dar ar trebui să le tratați mai degrabă ca pe servicii orientate spre public decât ca pe spații private de lucru. Câteva obiceiuri simple vă pot reduce semnificativ riscul:

- Evitați să partajați informații sensibile pe care nu ați dori să fie stocate, revizuite sau expuse public.

- Eliminați detaliile de identificare sau înlocuiți-le cu substituenți ori exemple fictive.

- Încărcați doar fișiere care nu conțin informații sensibile sau confidențiale.

- Tratați chat-urile cu IA ca pe e-mailuri sau tichete de asistență care ar putea fi văzute de alte persoane.

- Revizuiți setările de confidențialitate și dezactivați opțiuni precum istoricul chatului, memoria sau antrenarea IA.

- Ștergeți conversațiile de care nu mai aveți nevoie pentru a reduce cantitatea de informații personale care rămâne asociată cu contul dvs.

Treceți la un asistent IA privat

Dacă vă preocupă partajarea informațiilor personale sau de business cu instrumente IA, încercați Lumo. Alternativa noastră privată la ChatGPT nu jurnalizează niciodată conversațiile dvs. și nu le folosește pentru antrenarea modelelor. Datele dvs. sunt protejate prin criptare asimetrică bidirecțională (o formă de criptare de la un capăt la altul) și prelucrate pe servere europene controlate de Proton.

Când folosiți Lumo cu un cont Proton, conversațiile dvs. sunt protejate prin criptare cu acces zero, ceea ce înseamnă că doar dvs. le puteți citi — nici măcar Proton nu le poate citi. Pentru confidențialitate maximă, modul Ghost vă permite să folosiți Lumo fără a salva deloc istoricul.

Lumo folosește modele cu cod sursă public, astfel încât oricine poate verifica faptul că nu are loc nicio urmărire ascunsă sau colectare de date.

Încercați Lumo acum și vedeți cum arată IA atunci când confidențialitatea dvs. contează cel mai mult. Și când sunteți gata să aduceți același nivel de confidențialitate la locul dvs. de muncă, Lumo for Business vă ajută echipa să colaboreze în siguranță și să rămână productivă fără a compromite datele sensibile ale companiei.

De asemenea, puteți descărca Lumo de pe Google Play(fereastră nouă) sau App Store(fereastră nouă).