ChatGPT 是一個強大的 AI 助理(新視窗),每天有數百萬使用者使用,但它安全嗎?它由全球最大的科技公司之一 OpenAI 擁有並營運。與許多大型科技平台一樣,OpenAI 收集大量使用者資料。這些資料不受零存取加密的保護,因此該公司可能會將其洩露給業務合作夥伴(包括廣告和分析公司)、政府,以及在發生資料外洩事件時的駭客。

在幕後,OpenAI 的大型語言模型 (LLM) 不斷從您輸入的內容中學習。敏感問題,例如詢問有關健康症狀、法律事務或智慧財產權的問題,可能會進入複雜的效能分析系統中,或者協助訓練遠超出您最初意圖使用的 AI 模型。

關於 AI 公司如何處理使用者資料的擔憂日益增加。2026 年 3 月,在一項與美國政府的爭議性合作引發了關於 AI 系統如何被部署與治理的質疑後,超過 250 萬名使用者(新視窗)承諾離開 ChatGPT。這提醒了我們,當您在沒有強大隱私保護的情況下與 AI 助理互動時,您可能正在共享比您意識到的更多資訊。

ChatGPT 安全嗎?使用 ChatGPT 等 AI 與其他大型科技公司的風險

在選擇 ChatGPT、Gemini、Meta AI、Copilot 與 DeepSeek 等 AI 工具之前,值得了解它們的安全性與隱私風險:

| 風險 | 潛在影響 | 為何重要 |

| 資料收集與日誌記錄 | 提示、檔案上載與互動模式可能會被已儲存 | 可用於 AI 訓練、行為效能分析或人工審查 |

| 缺乏零存取加密 | OpenAI 及其合作夥伴可能會存取對話 | 增加暴露敏感資料的風險 |

| 監管與智慧財產權考量 | GDPR/HIPAA 暴露或專有資料外洩 | 法律責任與財務後果 |

| 閉源系統 | 資料處理的透明度有限 | 需要信任 OpenAI |

| App 內廣告 | 增加追蹤與效能分析 | 不清楚聊天資料如何影響個人化廣告 |

個人隱私

以下是您使用 ChatGPT 的風險:

- ChatGPT 可能會收集您輸入的資訊(例如問題、回覆以及您與該工具的互動方式)來訓練其 AI 模型。如果您上載履歷、法律文件、醫療報告或包含個人資料的其他檔案,該內容也可能被已儲存並處理。

- 即使您從未輸入您的姓名或其他個人資料,隨著時間的推移,您的提示也能揭露您的模式,例如健康問題、宗教疑慮、政治傾向、家庭狀況或情緒狀態。結合您的 IP 位址(新視窗)與其他技術識別碼,這些模式可用於建立詳細的行為效能分析。

- 您或許可以選擇退出 AI 訓練,但您的對話仍會記錄日誌,如果被標記,敏感的詳細資料可能會被人工審查員看到,例如當您提交意見回饋時。

- 您的聊天記錄在傳送與已儲存時會受到保護,但它不受零存取加密的保護,因此 OpenAI 或第三方仍可存取您過去的對話。

- 2025 年 7 月,數千個共享的 ChatGPT 對話出現在 Google 搜尋結果中(新視窗),暴露了使用者可能認為是私有且高度個人的交流。OpenAI 很快撤下了該功能,並表示正在與 Google 合作取消索引結果,但此事件凸顯了 AI 互動有多容易在您不知情的情況下溜進公共網域中。

- 在 2026 年初,OpenAI 針對免付費及 ChatGPT Go 方案的使用者推出了 ChatGPT 廣告。儘管保證廣告不會影響回覆,也不會涉及與廣告商共享個人資料,但這項舉動遵循了既定的大型科技公司模式,即在最初的隱私擔憂之後,廣告最終會變得常態化。

業務風險

OpenAI 是一家美國公司,因此使用 ChatGPT 可能會引發資料保護的擔憂與外洩敏感資訊的風險。如果您位於歐洲或其他地方,由於您的資料由美國公司處理,因此您的資料仍可能受美國管轄。這意味著:

- 如果沒有強大的資料保護保證,您的組織將面臨在 GDPR 與 HIPAA(新視窗) 等法律下的罰款或監管審查風險。

- 在您的公司資料上訓練 AI 模型會帶來外洩風險。例如,員工可能會將專有代碼、機密合約或客戶資訊輸入到 ChatGPT 中,這可能會暴露智慧財產權、商業機密或客戶資料。

- OpenAI 可能會與合作夥伴、供應商、其他第三方共享資料,或透過應用程式整合共享資料,而這些可能具有較弱的隱私保護或不同的資料政策。在 2025 年,一起涉及 OpenAI 分析供應商之一的資料外洩事件暴露了有關應用程式介面客戶的識別資訊。

- 在《愛國者法案》或《外國情報監視法》(FISA)等美國法律下,公司可能會被迫向政府機構提供資料,且通常附帶保密命令,阻止他們通知使用者。

缺乏透明度

以上是已知的風險。但 ChatGPT(以及其他閉源軟體)特別危險的地方在於您不被允許知道的事情。

- ChatGPT 應用程式的代碼不是開放原始碼,因此無法公開監督其運作方式、它所記錄的日誌或在幕後如何處理您的資料。您必須依賴 OpenAI 的政策並相信系統會負責任地處理資料。

- 雖然 OpenAI 已經發布了可以公開審查的開放權重模型,但 ChatGPT 使用的 AI 模型並非開放原始碼,因此您無法檢查資料是如何在大型資料集上進行預先訓練的。

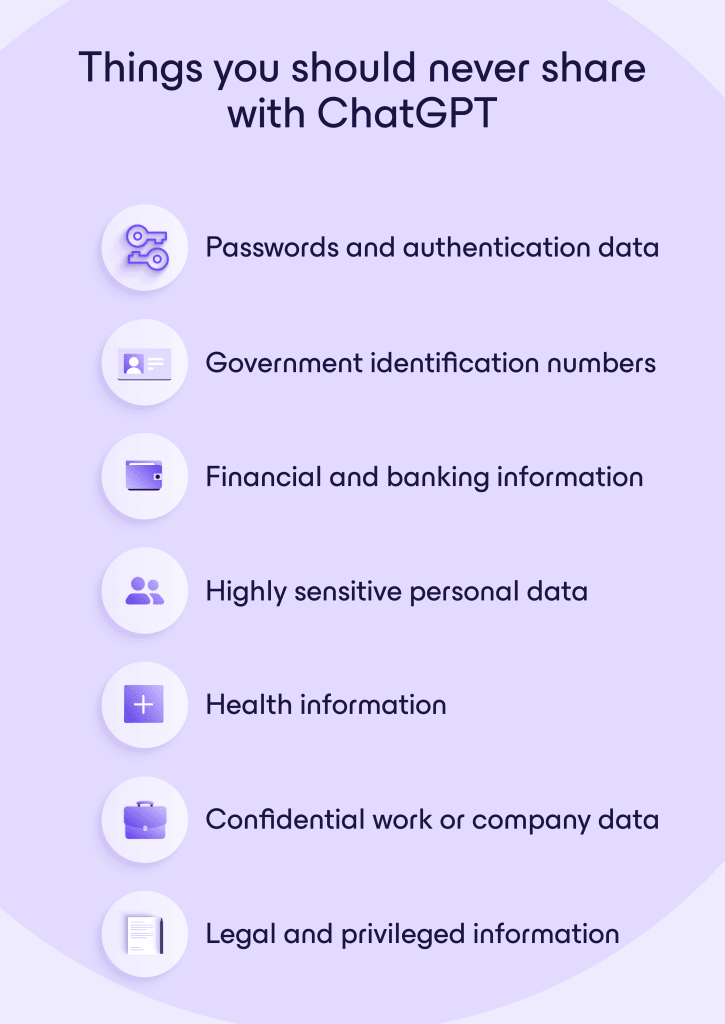

您絕對不應與 ChatGPT 共享的內容

儘管 ChatGPT 很有幫助,但您絕不應將其視為敏感資訊的安全保管庫。避免輸入任何一旦被已儲存、審查或意外暴露可能會對您、您的公司或他人造成傷害的內容:

密碼與驗證資料,例如帳號密碼、雙重身分驗證 (2FA) 代碼、備份驗證代碼或私有應用程式介面金鑰。

政府識別號碼,包括社會安全碼、國民身分證、護照、駕照與納稅識別碼。

金融與銀行資訊,例如信用卡或簽帳金融卡號碼、IBAN、線上銀行憑證、投資帳號登入資訊,或 Bitcoin 錢包私有金鑰。

高度敏感的個人資料,這些資料可能被用來識別或追蹤您或您的家人,例如家庭位址與電話號碼、出生日期,或私有照片或文件。

健康資訊,例如醫療報告、診斷記錄、保險號碼、病患 ID,或與您身分相關的詳細健康病史。

機密工作或公司資料,包括專有原始代碼、內部策略文件、機密合約、客戶資料庫、客戶詳細資料、財務預測、未發布的報告或保密協定(NDA)。

法律與特權資訊,例如律師與客戶的溝通、法律案件策略、證據文件或機密的和解討論。

如何在使用 ChatGPT 時保持安全

您不必完全避免使用 AI 工具,但您應該將其視為面向大眾的服務,而不是私有工作區。幾個簡單的習慣可以顯著降低您的風險:

- 避免共享您不想被已儲存、審查或公開暴露的敏感資訊。

- 移除可識別的詳細資料,或使用預留位置或虛構範例進行替換。

- 僅上載不包含敏感或機密資訊的檔案。

- 將 AI 聊天視為可能會被其他人看到的電子郵件或支援工單。

- 審查隱私設定並停用諸如聊天記錄、記憶體或 AI 訓練等設定。

- 刪除您不再需要的對話,以減少與您帳號相關的個人資訊量。

切換至私有 AI 助理

如果您擔心與 AI 工具共享個人或業務資訊,請嘗試使用 Lumo。我們私有的 ChatGPT 替代方案從不記錄您的對話日誌,也不會將其用於模型訓練。您的資料受到雙向非對稱加密(一種端對端加密形式)的保護,並在 Proton 控制的歐洲伺服器上處理。

當您搭配 Proton 帳號使用 Lumo 時,您的對話受到零存取加密的保護,這意味著只有您可以已讀它們 — 甚至 Proton 也不行。為了獲得最大的隱私,幽靈模式允許您使用 Lumo 而不儲存任何歷史記錄。

Lumo 使用開放原始碼模型,因此任何人都可以驗證是否沒有發生隱藏的追蹤或資料收集。

立即嘗試 Lumo,看看當您的隱私至關重要時,AI 是什麼樣子。而當您準備好將相同層級的隱私帶入工作場所時,Lumo for Business 可以幫助您的團隊安全地協作並保持生產力,而不必擔心敏感的公司資料遭入侵。

您也可以從 Google Play(新視窗) 或 App Store(新視窗) 下載 Lumo。