ChatGPT er en effektiv AI-assistent(nyt vindue), som bruges af millioner af brugere hver dag, men er den sikker at bruge? Den ejes og drives af OpenAI, en af de største teknologivirksomheder i verden. Og ligesom mange Big Tech-platforme indsamler OpenAI store mængder brugerdata. Disse data er ikke beskyttet med zero-access-kryptering, så virksomheden kan videregive dem til forretningspartnere (herunder reklame- og analysevirksomheder), myndighederne og hackere i tilfælde af et databrud.

Bag kulisserne lærer OpenAIs store sprogmodeller (LLM) konstant af det, De skriver. Følsomme spørgsmål, som for eksempel at spørge om helbredssymptomer, juridiske anliggender eller intellektuel ejendomsret, kan indgå i komplekse profileringssystemer eller hjælpe med at træne AI-modeller, der bruges langt ud over Deres oprindelige hensigt.

Bekymringer om, hvordan AI-virksomheder håndterer brugerdata, vokser. I marts 2026 forpligtede over 2,5 millioner brugere(nyt vindue) sig til at forlade ChatGPT, efter at et kontroversielt partnerskab med den amerikanske regering rejste spørgsmål om, hvordan AI-systemer bliver udrullet og styret. Det er en påmindelse om, at når De interagerer med en AI-assistent uden stærk privatlivsbeskyttelse, deler De muligvis flere oplysninger, end De er klar over.

- Er ChatGPT sikkert? Risiciene ved at bruge AI som ChatGPT og anden Big Tech

- Ting, De aldrig bør dele med ChatGPT

- Sådan forbliver De sikker, når De bruger ChatGPT

- Skift til en privat AI-assistent

Er ChatGPT sikkert? Risiciene ved at bruge AI som ChatGPT og anden Big Tech

Før De vælger AI-værktøjer som ChatGPT, Gemini, Meta AI, Copilot og DeepSeek, er det værd at forstå deres sikkerheds- og privatlivsrisici:

| Risiko | Potentiel påvirkning | Hvorfor det betyder noget |

| Dataindsamling og logning | Prompts, fil-uploads og interaktionsmønstre kan blive lagret | Kan bruges til AI-træning, adfærdsprofilering eller menneskelig gennemgang |

| Mangel på nuladgangskryptering | OpenAI og dets partnere kan få adgang til samtaler | Øger risikoen for at afsløre følsomme data |

| Lovgivningsmæssige og IP-relaterede bekymringer | GDPR/HIPAA-eksponering eller lækager af ejendomsretlige data | Juridisk ansvar og økonomiske konsekvenser |

| Closed source-system | Begrænset gennemsigtighed i datahåndtering | Kræver tillid til OpenAI |

| In-app-annoncer | Øget sporing og profilering | Uklart, hvordan chatdata informerer personlige annoncer |

Personligt privatliv

Her er, hvad De risikerer ved at bruge ChatGPT:

- ChatGPT kan indsamle de oplysninger, De indtaster — såsom spørgsmål, svar, og hvordan De interagerer med værktøjet — til at træne sine AI-modeller. Hvis De uploader et CV, et juridisk dokument, en lægejournal eller en anden fil med personlige data, kan dette indhold også blive lagret og behandlet.

- Selvom De aldrig indtaster Deres navn eller andre personlige data, kan Deres prompts afsløre mønstre over tid, såsom helbredsproblemer, religiøs tvivl, politiske tilhørsforhold, familiestatus eller følelsesmæssig tilstand. Kombineret med Deres IP-adresse(nyt vindue) og andre tekniske identifikatorer kan disse mønstre bruges til at opbygge detaljerede adfærdsprofiler.

- De kan muligvis fravælge AI-træning, men Deres samtaler bliver stadig logget, og følsomme detaljer kan blive set af menneskelige anmeldere, hvis de markeres, f.eks. når De indsender feedback.

- Deres chathistorik er beskyttet, mens den bliver sendt og lagret, men den er ikke beskyttet med nuladgangskryptering, så OpenAI eller en tredjepart kan stadig få adgang til Deres tidligere samtaler.

- I juli 2025 dukkede tusindvis af delte ChatGPT-samtaler op i Googles søgeresultater(nyt vindue) og afslørede dybt personlige udvekslinger, som brugere sandsynligvis antog var private. OpenAI trak hurtigt funktionen tilbage og sagde, at de arbejdede med Google for at af-indeksere resultaterne, men hændelsen fremhæver, hvor let AI-interaktioner kan glide ind i det offentlige domæne, uden at De er klar over det.

- I begyndelsen af 2026 introducerede OpenAI annoncer for ChatGPT-brugere på gratis- og ChatGPT Go-abonnementer. På trods af forsikringer om, at annoncer ikke vil påvirke svar eller involvere deling af personlige data med annoncører, følger dette træk et veletableret Big Tech-mønster, hvor annoncering til sidst bliver normaliseret efter indledende privatlivsbekymringer.

Forretningsrisiko

OpenAI er et amerikansk firma, så brugen af ChatGPT kan rejse databeskyttelsesbekymringer og risici for at lække følsomme oplysninger. Hvis De er baseret i Europa eller andre steder, kan Deres data stadig være underlagt amerikansk jurisdiktion, da de behandles af en amerikansk virksomhed. Her er, hvad det betyder:

- Uden stærke databeskyttelsesgarantier risikerer Deres organisation bøder eller lovgivningsmæssig granskning under love som GDPR og HIPAA(nyt vindue).

- De risikerer lækager ved at træne AI-modeller på Deres virksomhedsdata. For eksempel kan medarbejdere indtaste ejendomsretlig kode, fortrolige kontrakter eller klientoplysninger i ChatGPT, hvilket potentielt kan afsløre intellektuel ejendom, forretningshemmeligheder eller kundedata.

- OpenAI kan dele data med partnere, leverandører, andre tredjeparter eller gennem app-integrationer — som kan have svagere privatlivsbeskyttelse eller andre datapolitikker. I 2025 afslørede et databrud, der involverede en af OpenAIs analyseleverandører, identificerende oplysninger om API-kunder.

- Under amerikanske love som Patriot Act eller FISA (Foreign Intelligence Surveillance Act) kan virksomheder blive tvunget til at levere data til regeringsorganer, ofte med hemmeligholdelsesordrer, der forhindrer dem i at underrette brugere.

Mangel på gennemsigtighed

Ovenstående er kendte risici. Men hvad der er særligt risikabelt ved ChatGPT (og anden closed source-software) er, hvad De ikke har tilladelse til at vide.

- Koden til ChatGPTs apps er ikke open source, så der er intet offentligt tilsyn med, hvordan det fungerer, hvad det logger, eller hvordan det behandler Deres data bag kulisserne. De skal stole på OpenAIs politikker og have tillid til, at systemet håndterer data ansvarligt.

- Selvom OpenAI har frigivet open-weight-modeller, der kan undersøges offentligt, er de AI-modeller, som ChatGPT bruger, ikke open source, så De kan ikke kontrollere, hvordan dataene blev forudtrænet på store datasæt.

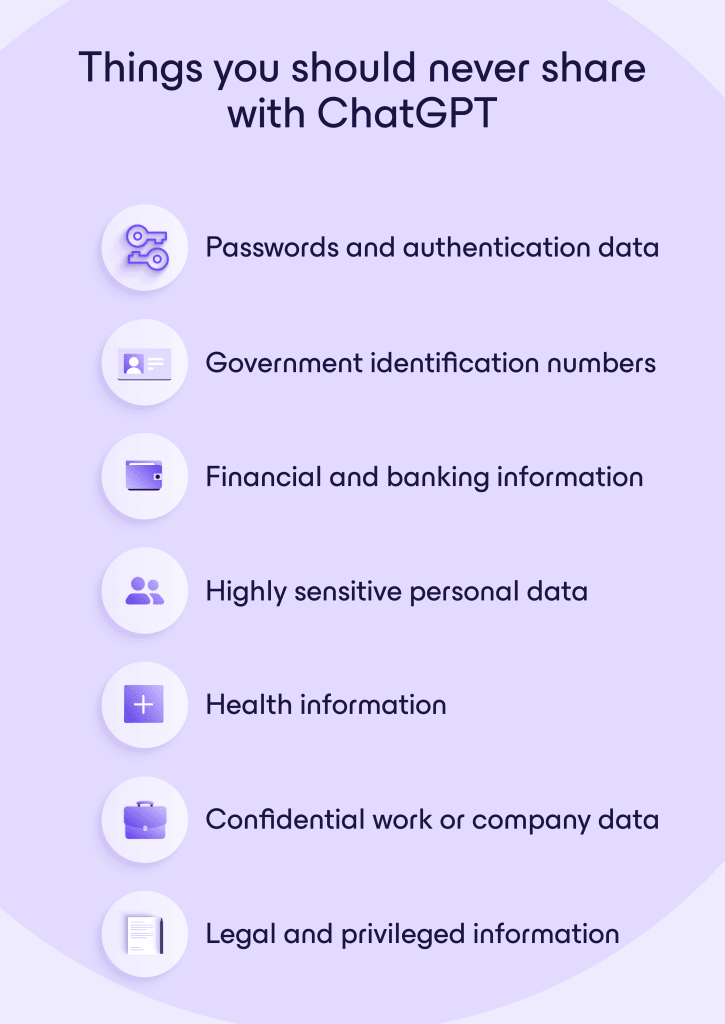

Ting, De aldrig bør dele med ChatGPT

Selvom ChatGPT kan være nyttig, bør De aldrig behandle den som en sikker boks til følsomme oplysninger. Undgå at indtaste noget, der kunne skade Dem, Deres virksomhed eller andre, hvis det blev lagret, gennemgået eller utilsigtet afsløret:

Adgangskoder og godkendelsesdata, såsom kontoadgangskoder, koder til to-faktor-godkendelse (2FA), godkendelseskoder til sikkerhedskopi eller private API-nøgler.

Offentlige identifikationsnumre, herunder personnumre, nationalt ID, pas, kørekort og skatteidentifikationsnumre.

Finansielle oplysninger og bankoplysninger, såsom numre på kredit- eller debetkort, IBAN-numre, legitimationsoplysninger til online bank, login til investeringskonti eller private nøgler til Bitcoin-pung.

Meget følsomme persondata, der kan bruges til at identificere eller spore Dem eller Deres familie, såsom hjemmeadresse og telefonnummer, fødselsdato eller private billeder eller dokumenter.

Helbredsoplysninger, såsom lægejournaler, diagnostiske optegnelser, forsikringsnumre, patient-ID’er eller detaljerede sundhedshistorikker knyttet til Deres identitet.

Fortrolige arbejds- eller virksomhedsdata, herunder proprietær kildekode, interne strategidokumenter, fortrolige kontrakter, kundedatabaser, klientdetaljer, finansielle fremskrivninger, upublicerede rapporter eller NDA’er.

Juridiske og privilegerede oplysninger, såsom kommunikation mellem advokat og klient, juridiske sagsstrategier, bevisdokumenter eller fortrolige forligsdrøftelser.

Sådan forbliver De sikker, når De bruger ChatGPT

De behøver ikke helt at undgå AI-værktøjer, men De bør behandle dem som offentligt tilgængelige tjenester frem for private arbejdsområder. Nogle få enkle vaner kan reducere Deres risiko markant:

- Undgå at dele følsomme oplysninger, som De ikke ønsker lagret, gennemgået eller eksponeret offentligt.

- Fjern identificerende detaljer, eller erstat dem med pladsholdere eller fiktive eksempler.

- Upload kun filer, der ikke indeholder følsomme eller fortrolige oplysninger.

- Behandl AI-chats som e-mails eller support-anmodninger, der kan ses af andre personer.

- Gennemgå privatlivsindstillinger og deaktiver indstillinger som chathistorik, hukommelse eller AI-træning.

- Slet samtaler, De ikke længere har brug for, for at reducere, hvor mange personlige oplysninger der forbliver knyttet til Deres konto.

Skift til en privat AI-assistent

Hvis De er bekymret for at dele personlige oplysninger eller forretningsoplysninger med AI-værktøjer, kan De prøve Lumo. Vores private ChatGPT-alternativ fører aldrig log over Deres samtaler eller bruger dem til modeltræning. Deres data er beskyttet med todirektionel asymmetrisk kryptering (en form for end-to-end kryptering) og behandles på europæiske servere kontrolleret af Proton.

Når De bruger Lumo med en Proton-konto, er Deres samtaler beskyttet med nul-adgangs-kryptering, hvilket betyder, at kun De kan læse dem — ikke engang Proton. For maksimalt privatliv giver Ghost-tilstand Dem mulighed for at bruge Lumo helt uden at gemme nogen historik.

Lumo bruger open source-modeller, så alle kan bekræfte, at der ikke forekommer skjult sporing eller dataindsamling.

Prøv Lumo nu og se, hvordan AI ser ud, når Deres privatliv er vigtigst. Og når De er klar til at bringe det samme niveau af privatliv til Deres arbejdsplads, hjælper Lumo for Business Deres team med at samarbejde sikkert og forblive produktivt uden at kompromittere følsomme virksomhedsdata.

De kan også downloade Lumo fra Google Play(nyt vindue) eller App Store(nyt vindue).