ChatGPT är en kraftfull AI-assistent(nytt fönster) som används av miljontals användare dagligen, men är den säker att använda? Den ägs och drivs av OpenAI, ett av världens största teknikföretag. Och som många plattformar från Big Tech samlar OpenAI in stora mängder användardata. Dessa data skyddas inte med kryptering med noll åtkomst, så företaget kan lämna ut dem till affärspartner (inklusive annons- och analysföretag), myndigheter och hackare vid en dataöverträdelse.

Bakom kulisserna lär sig OpenAIs stora språkmodeller (LLM) ständigt av det du skriver. Känsliga frågor, som att fråga om hälsosymtom, juridiska frågor eller immateriella rättigheter, kan matas in i komplexa profileringssystem eller hjälpa till att träna AI-modeller som används långt utanför din ursprungliga avsikt.

Oro över hur AI-företag hanterar användardata växer. I mars 2026 lovade över 2,5 miljoner användare(nytt fönster) att lämna ChatGPT efter att ett kontroversiellt partnerskap med den amerikanska staten väckt frågor om hur AI-system distribueras och styrs. Det är en påminnelse om att när du interagerar med en AI-assistent utan starkt integritetsskydd kan du dela mer information än du inser.

- Är ChatGPT säkert? Riskerna med att använda AI som ChatGPT och annan Big Tech

- Saker du aldrig bör dela med ChatGPT

- Så håller du dig säker när du använder ChatGPT

- Byt till en privat AI-assistent

Är ChatGPT säkert? Riskerna med att använda AI som ChatGPT och annan Big Tech

Innan du väljer AI-verktyg som ChatGPT, Gemini, Meta AI, Copilot och DeepSeek är det värt att förstå deras säkerhets– och integritetsrisker:

| Risk | Potentiell påverkan | Varför det spelar roll |

| Datainsamling och loggning | Promptar, filuppladdningar och interaktionsmönster kan lagras | Kan användas för AI-träning, beteendeprofilering eller mänsklig granskning |

| Brist på kryptering med noll åtkomst | Konversationer kan nås av OpenAI och dess partner | Ökar risken för att exponera känsliga data |

| Regulatoriska frågor och frågor om immateriella rättigheter | Exponering enligt GDPR/HIPAA eller läckor av skyddade data | Juridiskt ansvar och ekonomiska konsekvenser |

| System med sluten källkod | Begränsad transparens i datahantering | Kräver förtroende för OpenAI |

| Annonser i appen | Ökad spårning och profilering | Oklart hur chattdata påverkar personliga annonser |

Personlig integritet

Här är vad du riskerar genom att använda ChatGPT:

- ChatGPT kan samla in informationen du anger — såsom frågor, svar och hur du interagerar med verktyget — för att träna sina AI-modeller. Om du laddar upp ett CV, ett juridiskt dokument, en medicinsk rapport eller någon annan fil med personuppgifter kan även det innehållet lagras och behandlas.

- Även om du aldrig anger ditt namn eller andra personuppgifter kan dina promptar över tid avslöja mönster, som hälsobekymmer, religiösa tvivel, politiska åsikter, familjesituation eller känslomässigt tillstånd. Tillsammans med din IP-adress(nytt fönster) och andra tekniska identifierare kan dessa mönster användas för att skapa detaljerade beteendeprofiler.

- Du kan kanske välja bort AI-träning, men dina konversationer loggas fortfarande och känsliga detaljer kan ses av mänskliga granskare om de flaggas, till exempel när du skickar feedback.

- Din chatthistorik skyddas när den skickas och lagras, men den skyddas inte med kryptering med noll åtkomst, så OpenAI eller en tredje part kan fortfarande få åtkomst till dina tidigare konversationer.

- I juli 2025 dök tusentals delade ChatGPT-konversationer upp i Googles sökresultat(nytt fönster), vilket exponerade djupt personliga utbyten som användare sannolikt antog var privata. OpenAI drog snart tillbaka funktionen och sa att företaget arbetade med Google för att avindexera resultaten, men incidenten visar hur lätt AI-interaktioner kan hamna i det offentliga rummet utan att du inser det.

- I början av 2026 införde OpenAI annonser för ChatGPT-användare på gratisplanen och ChatGPT Go-planerna. Trots försäkringar om att annonser inte kommer att påverka svar eller innebära delning av personuppgifter med annonsörer följer detta ett välkänt mönster från Big Tech där reklam till slut normaliseras efter inledande integritetsoro.

Affärsrisk

OpenAI är ett amerikanskt företag, så användning av ChatGPT kan väcka dataskyddsfrågor och risker för läckage av känslig information. Om du är baserad i Europa eller någon annanstans kan dina data fortfarande omfattas av amerikansk jurisdiktion eftersom de behandlas av ett amerikanskt företag. Det här innebär följande:

- Utan starka garantier för dataskydd riskerar din organisation böter eller regulatorisk granskning enligt lagar som GDPR och HIPAA(nytt fönster).

- Du riskerar läckor genom att träna AI-modeller på dina företagsdata. Till exempel kan anställda ange skyddad kod, konfidentiella avtal eller kundinformation i ChatGPT, vilket potentiellt exponerar immateriella rättigheter, affärshemligheter eller kunddata.

- OpenAI kan dela data med partner, leverantörer, andra tredje parter eller via appintegrationer — som kan ha svagare integritetsskydd eller andra datapolicyer. År 2025 exponerade ett intrång som involverade en av OpenAIs analysleverantörer identifierande information om API-kunder.

- Enligt amerikanska lagar som Patriot Act eller FISA (Foreign Intelligence Surveillance Act) kan företag tvingas att lämna ut data till myndigheter, ofta med sekretessförordnanden som hindrar dem från att informera användare.

Brist på transparens

Ovanstående är kända risker. Men det som är särskilt riskabelt med ChatGPT (och annan mjukvara med sluten källkod) är det du inte får veta.

- Koden i ChatGPT:s appar är inte öppen källkod, så det finns ingen offentlig tillsyn över hur den fungerar, vad den loggar eller hur den behandlar dina data bakom kulisserna. Du måste förlita dig på OpenAIs policyer och lita på att systemet hanterar data ansvarsfullt.

- Även om OpenAI har släppt modeller med öppna vikter som kan granskas offentligt är AI-modellerna som ChatGPT använder inte öppen källkod, så du kan inte kontrollera hur datan förtränades på stora dataset.

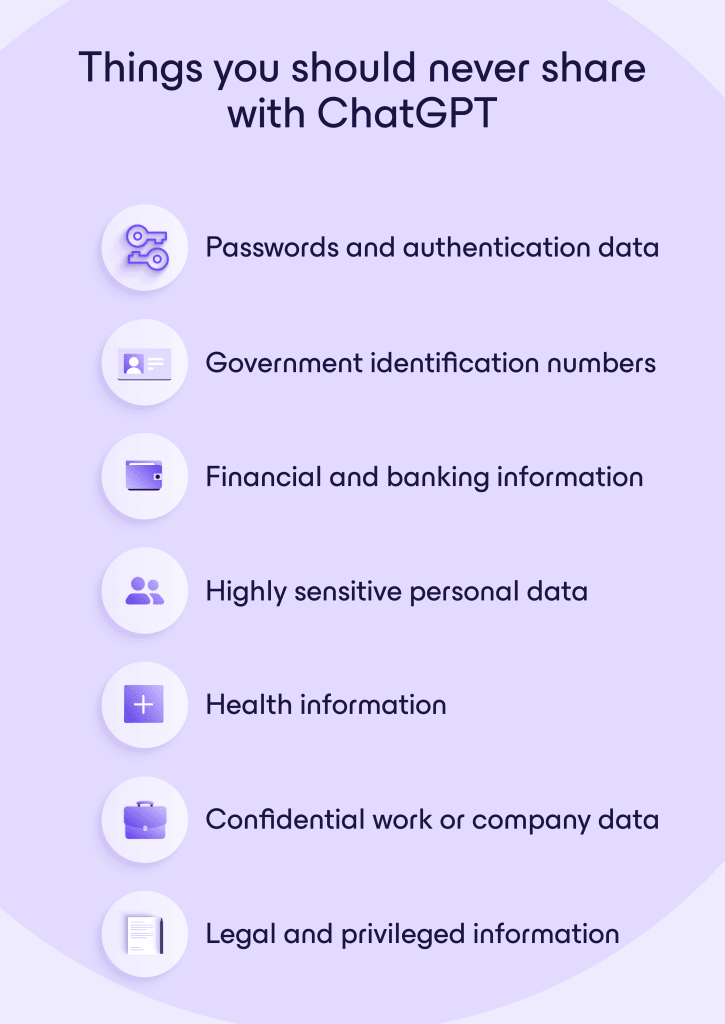

Saker du aldrig bör dela med ChatGPT

Även om ChatGPT kan vara hjälpsamt bör du aldrig behandla det som ett säkert valv för känslig information. Undvik att ange något som kan skada dig, ditt företag eller andra om det lagras, granskas eller av misstag exponeras:

Lösenord och autentiseringsdata, såsom kontolösenord, 2FA-koder, säkerhetskopieringskoder för autentisering eller privata API-nycklar.

Statliga identifikationsnummer, inklusive personnummer, nationellt ID, passnummer, körkortsnummer och skatteidentifikationsnummer.

Finansiell information och bankinformation, såsom kredit- eller betalkortsnummer, IBAN-nummer, inloggningsuppgifter till internetbank, investeringskontons inloggningar eller privata nycklar till Bitcoin-plånböcker.

Mycket känsliga personuppgifter som kan användas för att identifiera eller spåra dig eller din familj, såsom hemadress och telefonnummer, födelsedatum eller privata foton eller dokument.

Hälsoinformation, såsom medicinska rapporter, diagnostiska journaler, försäkringsnummer, patient-ID eller detaljerade sjukdomshistoriker kopplade till din identitet.

Konfidentiella arbets- eller företagsdata, inklusive skyddad källkod, interna strategidokument, konfidentiella avtal, kunddatabaser, klientdetaljer, finansiella prognoser, opublicerade rapporter eller sekretessavtal.

Juridisk och skyddad information, såsom kommunikation mellan advokat och klient, strategier i rättsfall, bevisdokument eller konfidentiella förlikningsdiskussioner.

Så håller du dig säker när du använder ChatGPT

Du behöver inte undvika AI-verktyg helt, men du bör behandla dem som publika tjänster snarare än privata arbetsytor. Några enkla vanor kan avsevärt minska din risk:

- Undvik att dela känslig information som du inte vill ska lagras, granskas eller exponeras offentligt.

- Ta bort identifierande detaljer eller ersätt dem med platshållare eller fiktiva exempel.

- Ladda bara upp filer som inte innehåller känslig eller konfidentiell information.

- Behandla AI-chattar som e-post eller supportärenden som kan ses av andra människor.

- Granska integritetsinställningar och inaktivera inställningar som chatthistorik, minne eller AI-träning.

- Ta bort konversationer du inte längre behöver för att minska hur mycket personlig information som förblir kopplad till ditt konto.

Byt till en privat AI-assistent

Om du är orolig för att dela personlig information eller företagsinformation med AI-verktyg kan du prova Lumo. Vårt privata ChatGPT-alternativ loggar aldrig dina konversationer och använder dem inte för modellträning. Dina data skyddas med dubbelriktad asymmetrisk kryptering (en form av end-to-end-kryptering) och behandlas på europeiska servrar som kontrolleras av Proton.

När du använder Lumo med ett Proton-konto skyddas dina konversationer med kryptering med noll åtkomst, vilket innebär att bara du kan läsa dem — inte ens Proton. För maximal integritet gör Ghost mode det möjligt att använda Lumo utan att spara någon historik alls.

Lumo använder öppen källkodsmodeller, så att vem som helst kan verifiera att ingen dold spårning eller datainsamling sker.

Prova Lumo nu och se hur AI ser ut när din integritet är viktigast. Och när du är redo att införliva samma nivå av integritet på din arbetsplats, hjälper Lumo for Business ditt team att samarbeta säkert och förbli produktiva utan att avslöja känsliga företagsdata.

\n\nDu kan också ladda ner Lumo från Google Play(nytt fönster) eller App Store(nytt fönster).