ChatGPT is een krachtige AI-assistent(nieuw venster) die dagelijks door miljoenen gebruikers wordt gebruikt, maar is het veilig om te gebruiken? Het is eigendom van en wordt beheerd door OpenAI, een van de grootste technologiebedrijven ter wereld. En net als veel Big Tech-platforms verzamelt OpenAI grote hoeveelheden gebruikersgegevens. Die gegevens worden niet beschermd met zero-access versleuteling, dus het bedrijf kan deze onthullen aan zakenpartners (inclusief advertentie- en analysebedrijven), de overheid en hackers bij een gegevensschending.

Achter de schermen leren de large language models (LLM) van OpenAI constant van wat u typt. Gevoelige vragen, zoals vragen over gezondheidssymptomen, juridische zaken of intellectueel eigendom, kunnen complexe profileringssystemen voeden of AI-modellen helpen trainen die ver buiten uw oorspronkelijke bedoeling worden gebruikt.

Zorgen over hoe AI-bedrijven omgaan met gebruikersgegevens nemen toe. In maart 2026 beloofden meer dan 2,5 miljoen gebruikers(nieuw venster) ChatGPT te verlaten na een controversiële samenwerking met de Amerikaanse overheid die vragen opriep over hoe AI-systemen worden geïmplementeerd en bestuurd. Het is een herinnering dat wanneer u een interactie aangaat met een AI-assistent zonder sterke privacybescherming, u mogelijk meer informatie deelt dan u zich realiseert.

- Is ChatGPT veilig? De risico’s van het gebruik van AI zoals ChatGPT en andere Big Tech

- Dingen die u nooit met ChatGPT moet delen

- Hoe u veilig kunt blijven tijdens het gebruik van ChatGPT

- Schakel over naar een privé AI-assistent

Is ChatGPT veilig? De risico’s van het gebruik van AI zoals ChatGPT en andere Big Tech

Voordat u AI-tools zoals ChatGPT, Gemini, Meta AI, Copilot en DeepSeek kiest, is het de moeite waard om hun beveiligings- en privacyrisico’s te begrijpen:

| Risico | Potentiële impact | Waarom het uitmaakt |

| Gegevensverzameling en logging | Prompts, bestandsuploads en interactiepatronen kunnen worden opgeslagen | Kan worden gebruikt voor AI-training, gedragsprofilering of menselijke beoordeling |

| Gebrek aan zero-access versleuteling | Gesprekken kunnen toegankelijk zijn voor OpenAI en haar partners | Verhoogt het risico op het blootleggen van gevoelige gegevens |

| Zorgen over regelgeving en intellectueel eigendom (IE) | Blootstelling aan GDPR/HIPAA of lekken van bedrijfseigen gegevens | Juridische aansprakelijkheid en financiële consequenties |

| Closed-source systeem | Beperkte transparantie in de verwerking van gegevens | Vereist vertrouwen in OpenAI |

| In-app advertenties | Verhoogde tracking en profilering | Onduidelijk hoe chatgegevens gepersonaliseerde advertenties informeren |

Persoonlijke privacy

Dit is wat u riskeert door ChatGPT te gebruiken:

- ChatGPT kan de informatie verzamelen die u invoert — zoals vragen, antwoorden en hoe u met de tool communiceert — om de AI-modellen te trainen. Als u een cv, juridisch document, een medisch rapport of een ander bestand met persoonlijke gegevens uploadt, kan die inhoud ook worden opgeslagen en verwerkt.

- Zelfs als u nooit uw naam of andere persoonlijke gegevens invoert, kunnen uw prompts in de loop van de tijd patronen onthullen, zoals gezondheidsproblemen, religieuze twijfels, politieke voorkeuren, gezinssituatie of emotionele toestand. Gecombineerd met uw IP-adres(nieuw venster) en andere technische identificatiegegevens, kunnen deze patronen worden gebruikt om gedetailleerde gedragsprofielen op te bouwen.

- U kunt zich mogelijk afmelden voor AI-training, maar uw gesprekken worden nog steeds gelogd en gevoelige details kunnen worden gezien door menselijke beoordelaars als ze worden gemarkeerd, zoals wanneer u feedback indient.

- Uw chatgeschiedenis is beschermd tijdens het verzenden en opgeslagen, maar is niet beschermd met zero-access versleuteling, dus OpenAI of een derde partij heeft nog steeds toegang tot uw eerdere gesprekken.

- In juli 2025 verschenen duizenden gedeelde ChatGPT-gesprekken in de zoekresultaten van Google(nieuw venster), waardoor zeer persoonlijke uitwisselingen aan het licht kwamen waarvan gebruikers waarschijnlijk aannamen dat ze privé waren. OpenAI trok de functie al snel in en zei dat het samenwerkte met Google om de resultaten te de-indexeren, maar het incident benadrukt hoe gemakkelijk AI-interacties in het publieke domein kunnen glippen zonder dat u het doorhebt.

- Begin 2026 introduceerde OpenAI advertenties voor ChatGPT-gebruikers met het gratis en ChatGPT Go-abonnement. Ondanks garanties dat advertenties de reacties niet zullen beïnvloeden en geen betrekking hebben op het delen van persoonlijke gegevens met adverteerders, volgt de stap een welbekend patroon in Big Tech, waarbij adverteren na initiële zorgen over de privacy uiteindelijk genormaliseerd wordt.

Zakelijk risico

OpenAI is een Amerikaans bedrijf, dus het gebruik van ChatGPT kan zorgen over gegevensbescherming en risico’s op het lekken van gevoelige informatie opleveren. Als u in Europa of ergens anders bent gevestigd, kunnen uw gegevens nog steeds vallen onder de jurisdictie van de VS, aangezien ze door een Amerikaans bedrijf worden verwerkt. Dit is wat dat betekent:

- Zonder sterke garanties voor gegevensbescherming riskeert uw organisatie boetes of regelgevend toezicht op grond van wetten zoals de GDPR en HIPAA(nieuw venster).

- U loopt het risico op lekken door AI-modellen te trainen op uw bedrijfsgegevens. Werknemers kunnen bijvoorbeeld bedrijfseigen code, vertrouwelijke contracten of klantinformatie in ChatGPT invoeren, waardoor intellectueel eigendom, bedrijfsgeheimen of klantengegevens kunnen worden blootgesteld.

- OpenAI kan gegevens delen met partners, leveranciers, andere derden of via app-integraties — wat zou kunnen leiden tot zwakkere privacybeschermingen of ander gegevensbeleid. In 2025 heeft een schending met betrekking tot een van de analyteleveranciers van OpenAI identificatie-informatie over API-klanten blootgelegd.

- Onder Amerikaanse wetten zoals de Patriot Act of FISA (Foreign Intelligence Surveillance Act) kunnen bedrijven worden gedwongen om gegevens aan overheidsinstanties te verstrekken, vaak met geheimhoudingsbevelen die voorkomen dat ze gebruikers informeren.

Gebrek aan transparantie

De bovenstaande zijn bekende risico’s. Maar wat vooral riskant is aan ChatGPT (en andere closed source-software), is wat u niet mag weten.

- De code van de ChatGPT-apps is niet open source, dus er is geen openbaar toezicht op hoe het werkt, wat het logt of hoe het uw gegevens achter de schermen verwerkt. U moet vertrouwen op het beleid van OpenAI en erop vertrouwen dat het systeem verantwoord omgaat met gegevens.

- Hoewel OpenAI open-weight-modellen heeft uitgebracht die openbaar kunnen worden onderzocht, zijn de AI-modellen die ChatGPT gebruikt niet open source, dus u kunt niet controleren hoe de gegevens vooraf zijn getraind op grote datasets.

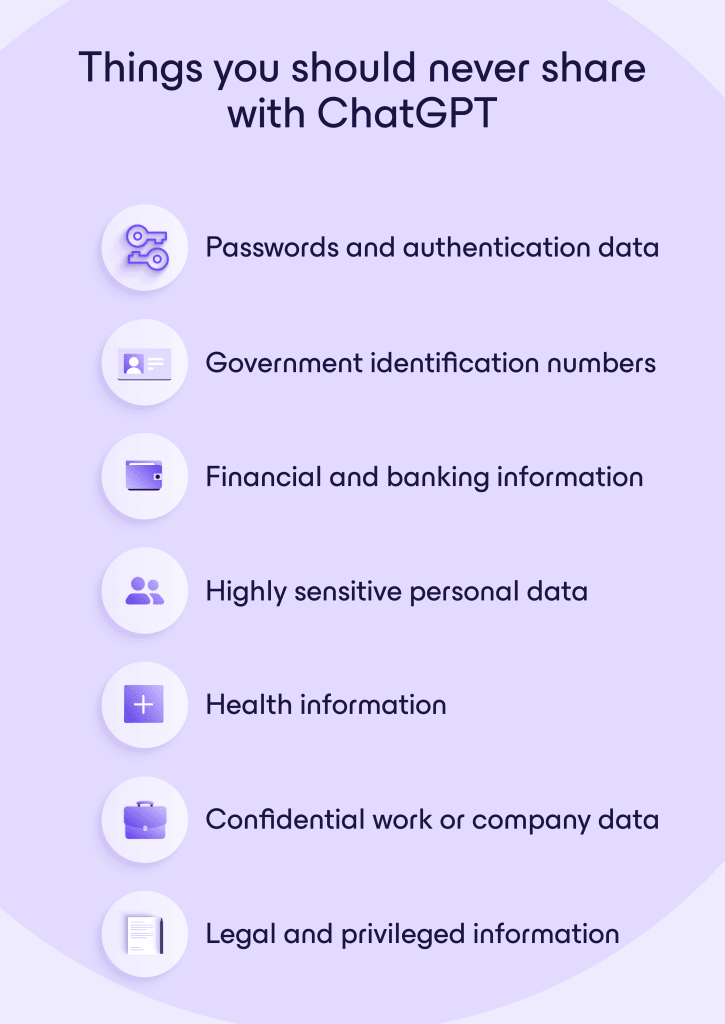

Dingen die u nooit met ChatGPT moet delen

Hoewel ChatGPT nuttig kan zijn, moet u het nooit behandelen als een veilige kluis voor gevoelige informatie. Voorkom het invoeren van zaken die u, uw bedrijf of anderen kunnen schaden als ze zouden worden opgeslagen, beoordeeld of per ongeluk zouden worden blootgesteld:

Wachtwoorden en verificatiegegevens, zoals accountwachtwoorden, Tweestapsverificatie (2FA)-codes, back-upverificatiecodes of geheime API-sleutels.

Identificatienummers van de overheid, inclusief burgerservicenummers, nationale ID’s, paspoorten, rijbewijzen en fiscale identificatienummers.

Financiële en bankgegevens, zoals creditcard- of bankpasnummers, IBAN’s, online bankinloggegevens, inloggegevens voor beleggingsaccounts of geheime sleutels van een Bitcoin-portemonnee.

Zeer gevoelige persoonlijke gegevens die kunnen worden gebruikt om u of uw gezin te identificeren of te volgen, zoals uw huisadres en telefoonnummer, geboortedatum of privéfoto’s of documenten.

Gezondheidsinformatie, zoals medische rapporten, diagnostische dossiers, verzekeringsnummers, patiënt-ID’s of gedetailleerde gezondheidsgeschiedenissen die zijn gekoppeld aan uw identiteit.

Vertrouwelijke werk- of bedrijfsgegevens, inclusief bedrijfseigen broncode, interne strategiedocumenten, vertrouwelijke contracten, klantendatabases, klantgegevens, financiële projecties, ongepubliceerde rapporten of NDA’s.

Juridische en bevoorrechte informatie, zoals communicatie tussen advocaat en cliënt, juridische casusstrategieën, bewijsdocumenten of vertrouwelijke schikkingsbesprekingen.

Hoe u veilig kunt blijven tijdens het gebruik van ChatGPT

U hoeft AI-tools niet helemaal te vermijden, maar u moet ze behandelen als publiekgerichte diensten in plaats van privé-werkruimtes. Een paar simpele gewoontes kunnen uw risico aanzienlijk verminderen:

- Vermijd het delen van gevoelige informatie waarvan u niet wilt dat deze wordt opgeslagen, beoordeeld of openbaar wordt gemaakt.

- Verwijder identificerende gegevens of vervang ze door tijdelijke aanduidingen of fictieve voorbeelden.

- Upload alleen bestanden die geen gevoelige of vertrouwelijke informatie bevatten.

- Behandel AI-chats als e-mails of ondersteuningstickets die door andere mensen kunnen worden gezien.

- Bekijk de privacyinstellingen en schakel instellingen uit zoals chatgeschiedenis, geheugen of AI-training.

- Verwijder gesprekken die u niet meer nodig heeft om te verminderen hoeveel persoonlijke informatie aan uw account is gekoppeld.

Schakel over naar een privé AI-assistent

Als u zich zorgen maakt over het delen van persoonlijke of zakelijke informatie met AI-tools, probeer dan Lumo. Ons privé ChatGPT-alternatief logt nooit uw gesprekken en gebruikt ze niet voor modeltraining. Uw gegevens worden beschermd met bidirectionele asymmetrische versleuteling (een vorm van end-to-end versleuteling) en verwerkt op Europese servers die door Proton worden beheerd.

Wanneer u Lumo gebruikt met een Proton-account, worden uw gesprekken beschermd met zero-access versleuteling, wat betekent dat alleen u ze kunt lezen — zelfs Proton niet. Voor maximale privacy stelt de Ghost-modus u in staat Lumo te gebruiken zonder enige geschiedenis op te slaan.

Lumo gebruikt open-source modellen, zodat iedereen kan verifiëren dat er geen verborgen tracking of gegevensverzameling plaatsvindt.

Probeer Lumo nu en zie hoe AI eruitziet wanneer uw privacy het belangrijkst is. En als u klaar bent om datzelfde niveau van privacy naar uw werkplek te brengen, helpt Lumo for Business uw team veilig samen te werken en productief te blijven zonder gevoelige bedrijfsgegevens in gevaar te brengen.

U kunt Lumo ook downloaden via Google Play(nieuw venster) of de App Store(nieuw venster).