ChatGPT er en kraftig KI-assistent(nytt vindu) som brukes av millioner av brukere daglig, men er det trygt å bruke? Det eies og drives av OpenAI, et av de største teknologiselskapene i verden. Og som mange Big Tech-plattformer, samler OpenAI inn store mengder brukerdata. Disse dataene er ikke beskyttet med nulltilgangskryptering, slik at selskapet kan utlevere det til forretningspartnere (inkludert reklame- og analyseselskaper), regjeringen og hackere ved en hendelse med databrudd.

I kulissene lærer OpenAIs store språkmodeller (LLM) kontinuerlig av det du skriver. Sensitive spørsmål, som å spørre om helsesymptomer, juridiske saker eller immateriell eiendom, kan mate komplekse profileringssystemer eller bidra til å trene KI-modeller som brukes langt utover din opprinnelige hensikt.

Bekymringene rundt hvordan KI-selskaper håndterer brukerdata øker. I mars 2026 forpliktet mer enn 2,5 millioner brukere(nytt vindu) seg til å forlate ChatGPT etter at et kontroversielt partnerskap med den amerikanske regjeringen reiste spørsmål om hvordan KI-systemer distribueres og styres. Det er en påminnelse om at når du samhandler med en KI-assistent uten sterkt personvern, kan du dele mer informasjon enn du innser.

- Er ChatGPT trygt? Risikoen ved å bruke KI som ChatGPT og andre store teknologiselskaper

- Ting du aldri bør dele med ChatGPT

- Slik holder du deg trygg når du bruker ChatGPT

- Bytt til en privat KI-assistent

Er ChatGPT trygt? Risikoen ved å bruke KI som ChatGPT og andre store teknologiselskaper

Før du velger KI-verktøy som ChatGPT, Gemini, Meta AI, Copilot og DeepSeek, er det verdt å forstå sikkerhets– og personvernrisikoene deres:

| Risiko | Potensiell innvirkning | Hvorfor det er viktig |

| Datainnsamling og logging | Forespørsler, filopplastinger og samhandlingsmønstre kan bli lagret | Kan brukes til KI-trening, atferdsprofilering eller menneskelig gjennomgang |

| Mangel på nulltilgangskryptering | OpenAI og partnerne deres kan få tilgang til samtaler | Øker risikoen for å eksponere sensitive data |

| Regulatoriske og IP-bekymringer | GDPR-/HIPAA-eksponering eller lekkasjer av proprietære data | Juridisk ansvar og økonomiske konsekvenser |

| System med lukket kildekode | Begrenset åpenhet om datahåndtering | Krever tillit til OpenAI |

| Annonser i appen | Økt sporing og profilering | Uklart hvordan chatdata informerer om personlige annonser |

Personlig personvern

Dette er hva du risikerer ved å bruke ChatGPT:

- ChatGPT kan samle inn informasjonen du angir — som spørsmål, svar og hvordan du samhandler med verktøyet — for å trene KI-modellene sine. Hvis du laster opp en CV, et juridisk dokument, en medisinsk rapport eller en annen fil med personopplysninger, kan dette innholdet også bli lagret og behandlet.

- Selv om du aldri angir navnet ditt eller andre personopplysninger, kan forespørslene dine avsløre mønstre over tid, for eksempel helsebekymringer, religiøse tvil, politisk tilhørighet, familiestatus eller følelsesmessig tilstand. Kombinert med IP-adressen(nytt vindu) din og andre tekniske identifikatorer, kan disse mønstrene brukes til å bygge detaljerte atferdsprofiler.

- Du kan kanskje velge bort KI-trening, men samtalene dine blir fortsatt loggført, og sensitive detaljer kan bli sett av menneskelige kontrollører hvis de blir flagget, for eksempel når du sender inn tilbakemelding.

- Chatloggen din er beskyttet mens den sendes og lagres, men den er ikke beskyttet med nulltilgangskryptering, slik at OpenAI eller en tredjepart fortsatt kan få tilgang til de tidligere samtalene dine.

- I juli 2025 dukket tusenvis av delte ChatGPT-samtaler opp i Google-søkeresultater(nytt vindu), noe som eksponerte dypt personlige utvekslinger som brukere sannsynligvis antok at var private. OpenAI trakk raskt funksjonen og sa at de samarbeidet med Google for å avindeksere resultatene, men hendelsen belyser hvor lett KI-interaksjoner kan gli inn i det offentlige domenet uten at du er klar over det.

- Tidlig i 2026 introduserte OpenAI annonser for ChatGPT-brukere på de gratis abonnementene og ChatGPT Go-abonnementene. Til tross for forsikringer om at annonser ikke vil påvirke svar eller innebære at du deler personopplysninger med annonsører, følger dette trekket et veletablert Big Tech-mønster der reklame til slutt blir normalisert etter innledende personvernbekymringer.

Forretningsrisiko

OpenAI er et amerikansk selskap, så bruk av ChatGPT kan reise bekymringer rundt databeskyttelse og risiko for lekkasje av sensitiv informasjon. Hvis du er basert i Europa eller andre steder, kan dataene dine fortsatt være underlagt amerikansk jurisdiksjon siden de behandles av et amerikansk selskap. Her er hva det betyr:

- Uten sterke garantier for databeskyttelse risikerer organisasjonen din bøter eller regulatorisk gransking under lover som GDPR og HIPAA(nytt vindu).

- Du risikerer lekkasjer ved å trene KI-modeller på firmadataene dine. For eksempel kan ansatte angi proprietær kode, konfidensielle kontrakter eller klientinformasjon i ChatGPT, og potensielt eksponere immateriell eiendom, forretningshemmeligheter eller kundedata.

- OpenAI kan dele data med partnere, leverandører, andre tredjeparter eller gjennom appintegrasjoner — som kan ha svakere personvernbeskyttelse eller andre retningslinjer for data. I 2025 førte et brudd som involverte en av OpenAIs analyseleverandører til at identifiserende informasjon om API-kunder ble eksponert.

- Under amerikanske lover som Patriot Act eller FISA (Foreign Intelligence Surveillance Act), kan selskaper tvinges til å utlevere data til offentlige etater, ofte med hemmeligholdsordrer som forhindrer dem i å varsle brukere.

Mangel på åpenhet

Ovennevnte er kjente risikoer. Men det som er spesielt risikabelt med ChatGPT (og annen lukket programvare) er det du ikke har lov til å vite.

- Koden til ChatGPTs apper har ikke åpen kildekode, så det er ingen offentlig tilsyn med hvordan den fungerer, hva den logger, eller hvordan den behandler dataene dine i kulissene. Du må stole på OpenAIs retningslinjer og ha tillit til at systemet håndterer data ansvarlig.

- Selv om OpenAI har lansert «open-weight»-modeller som kan undersøkes offentlig, har ikke KI-modellene som ChatGPT bruker åpen kildekode, så du kan ikke sjekke hvordan dataene ble forhåndstrent på store datasett.

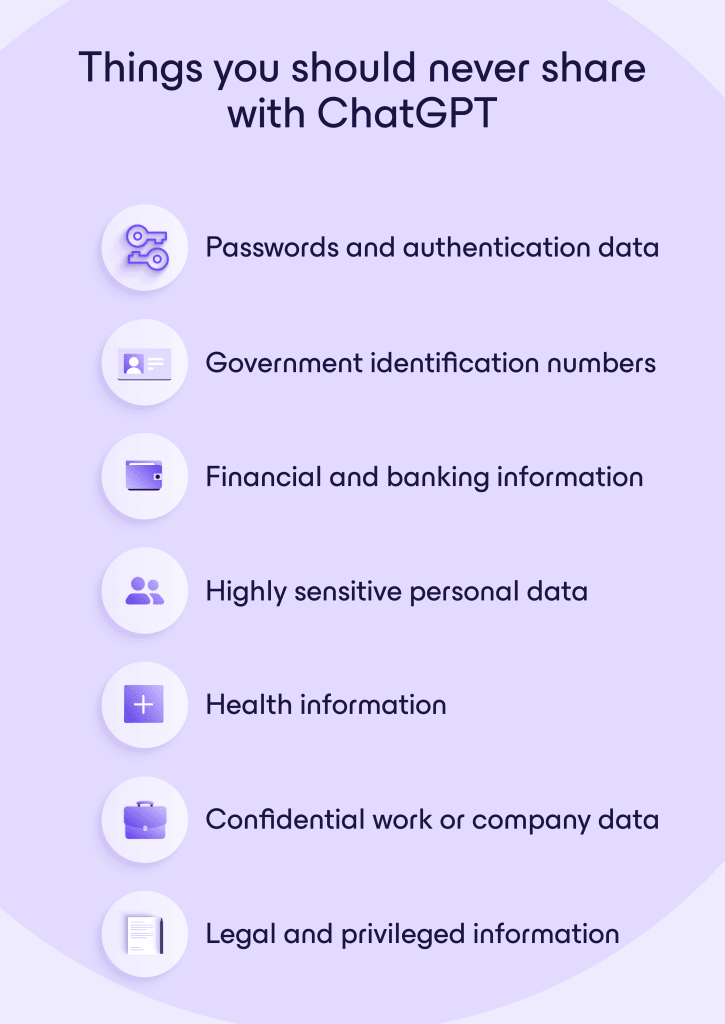

Ting du aldri bør dele med ChatGPT

Selv om ChatGPT kan være nyttig, bør du aldri behandle det som et sikkert hvelv for sensitiv informasjon. Unngå å angi noe som kan skade deg, selskapet ditt eller andre hvis det ble lagret, gjennomgått eller utilsiktet eksponert:

Passord og autentiseringsdata, for eksempel kontopassord, koder for tofaktorautentisering (2FA), koder for sikkerhetskopiering eller private API-nøkler.

Myndighetsutstedte identifikasjonsnumre, inkludert personnummer, nasjonalt ID-kort, pass, førerkort og skatteidentifikasjonsnumre.

Økonomisk og bankinformasjon, for eksempel kreditt- eller debetkortnumre, IBAN, påloggingsinformasjon for nettbank, pålogginger til investeringskontoer eller private nøkler til Bitcoin-lommebøker.

Svært sensitive personopplysninger som kan brukes til å identifisere eller spore deg eller familien din, for eksempel hjemmeadresse og telefonnummer, fødselsdato eller private bilder eller dokumenter.

Helseinformasjon, for eksempel medisinske rapporter, diagnostiske journaler, forsikringsnumre, pasient-ID-er eller detaljerte helsehistorikker knyttet til identiteten din.

Konfidensielt arbeid eller bedriftsdata, inkludert proprietær kildekode, interne strategidokumenter, konfidensielle kontrakter, kundedatabaser, klientdetaljer, økonomiske anslag, upubliserte rapporter eller taushetserklæringer (NDA-er).

Juridisk og taushetsbelagt informasjon, for eksempel kommunikasjon mellom advokat og klient, juridiske saksstrategier, bevisdokumenter eller konfidensielle forliksdiskusjoner.

Slik holder du deg trygg når du bruker ChatGPT

Du trenger ikke å unngå KI-verktøy helt, men du bør behandle dem som offentlig tilgjengelige tjenester i stedet for private arbeidsområder. Noen enkle vaner kan redusere risikoen din betydelig:

- Unngå å dele sensitiv informasjon du ikke vil skal bli lagret, gjennomgått eller eksponert offentlig.

- Fjern identifiserende detaljer eller erstatt dem med plassholdere eller fiktive eksempler.

- Last opp bare filer som ikke inneholder sensitiv eller konfidensiell informasjon.

- Behandle KI-chatter som e-poster eller støttebilletter som kan bli sett av andre mennesker.

- Gjennomgå personverninnstillinger og deaktiver innstillinger som chatlogg, minne eller KI-trening.

- Slett samtaler du ikke lenger trenger, for å redusere hvor mye personlig informasjon som forblir knyttet til kontoen din.

Bytt til en privat KI-assistent

Hvis du er bekymret for å dele personlig eller forretningsmessig informasjon med KI-verktøy, prøv Lumo. Vårt private ChatGPT-alternativ logger aldri samtalene dine eller bruker dem til modelltrening. Dataene dine er beskyttet med toveis asymmetrisk kryptering (en form for ende-til-ende-kryptering) og behandles på europeiske tjenere kontrollert av Proton.

Når du bruker Lumo med en Proton-konto, er samtalene dine beskyttet med nulltilgangskryptering, noe som betyr at de bare kan bli lest av deg — ikke engang Proton. For maksimalt personvern lar Ghost-modus deg bruke Lumo uten å lagre noen logg i det hele tatt.

Lumo bruker modeller med åpen kildekode, slik at hvem som helst kan verifisere at ingen skjult sporing eller datainnsamling forekommer.

Prøv Lumo nå og se hvordan KI ser ut når personvernet ditt betyr mest. Og når du er klar til å bringe det samme nivået av personvern til arbeidsplassen din, hjelper Lumo for Business teamet ditt med å samarbeide sikkert og holde seg produktive uten å kompromittere sensitive selskapsdata.

Du kan også laste ned Lumo fra Google Play(nytt vindu) eller App Store(nytt vindu).