ChatGPT je výkonný AI asistent(nové okno), kterého denně používají miliony uživatelů, ale je jeho používání bezpečné? Vlastní jej a provozuje OpenAI, jedna z největších technologických společností na světě. A stejně jako mnoho platforem Big Tech i OpenAI shromažďuje velké množství dat uživatelů. Tato data nejsou chráněna šifrováním s nulovým přístupem, takže je společnost může zpřístupnit obchodním partnerům (včetně reklamních a analytických společností), vládě a hackerům v případě narušení bezpečnosti dat.

V zákulisí se rozsáhlé jazykové modely (LLM) od OpenAI neustále učí z toho, co píšete. Citlivé dotazy, jako jsou otázky týkající se zdravotních příznaků, právních záležitostí nebo duševního vlastnictví, se mohou stát součástí komplexních systémů profilování nebo pomoci trénovat modely AI využívané daleko za hranicemi Vašeho původního záměru.

Obavy z toho, jak AI společnosti nakládají s uživatelskými daty, rostou. V březnu 2026 se více než 2,5 milionu uživatelů(nové okno) zavázalo opustit ChatGPT poté, co kontroverzní partnerství s americkou vládou vyvolalo otázky o tom, jak jsou systémy AI implementovány a řízeny. Je to připomínka toho, že když komunikujete s AI asistentem bez silné ochrany soukromí, můžete sdílet více informací, než si uvědomujete.

- Je ChatGPT bezpečný? Rizika používání umělé inteligence jako ChatGPT a dalších řešení od velkých technologických společností

- Věci, které byste nikdy neměli sdílet s ChatGPT

- Jak zůstat v bezpečí při používání ChatGPT

- Přejděte na soukromého AI asistenta

Je ChatGPT bezpečný? Rizika používání umělé inteligence jako ChatGPT a dalších řešení od velkých technologických společností

Než si vyberete nástroje AI, jako jsou ChatGPT, Gemini, Meta AI, Copilot a DeepSeek, stojí za to porozumět jejich bezpečnostním a rizikům pro soukromí:

| Riziko | Potenciální dopad | Proč na tom záleží |

| Shromažďování dat a ukládání logů | Pokyny, nahrávání souborů a vzorce interakce mohou být uložené | Lze zneužít k trénování AI, behaviorálnímu profilování nebo ruční kontrole lidmi |

| Chybějící šifrování s nulovým přístupem | K Vašim konverzacím může přistupovat společnost OpenAI a její partneři | Zvyšuje riziko odhalení citlivých dat |

| Regulační obavy a obavy o duševní vlastnictví | Nedodržení GDPR/HIPAA nebo úniky proprietárních dat | Právní odpovědnost a finanční důsledky |

| Uzavřený zdrojový kód systému | Omezená transparentnost při nakládání s daty | Vyžaduje důvěru v OpenAI |

| Reklamy v aplikaci | Zvýšené sledování a profilování | Není jasné, jak chatová data ovlivňují personalizované reklamy |

Osobní soukromí

Při používání ChatGPT riskujete následující:

- ChatGPT může shromažďovat informace, které zadáte — jako jsou dotazy, odpovědi a to, jak s nástrojem interagujete — k trénování svých modelů AI. Pokud nahrajete životopis, právní dokument, lékařskou zprávu nebo jiný soubor s osobními údaji, tento obsah může být také uložený a zpracován.

- I když nikdy nezadáte své jméno nebo jiné osobní údaje, mohou Vaše pokyny postupem času odhalit určité vzorce, jako jsou zdravotní problémy, náboženské pochybnosti, politické sklony, rodinný stav nebo emocionální rozpoložení. V kombinaci s Vaší IP adresou(nové okno) a dalšími technickými identifikátory lze tyto vzorce použít k vytvoření podrobných behaviorálních profilů.

- Možná se dokážete odhlásit z trénování AI, ale u Vašich konverzací jsou stále ukládány logy a citlivé detaily by mohli vidět lidští hodnotitelé, pokud jsou nahlášeny, jako například při odeslání zpětné vazby.

- Historie Vašich chatů je sice chráněna při odesílání a je bezpečně uložená, ale není chráněna šifrováním bez přístupu poskytovatele (zero-access encryption), takže společnost OpenAI nebo třetí strana může k Vašim předchozím konverzacím nadále přistupovat.

- V červenci 2025 se tisíce sdílených konverzací na ChatGPT objevily ve výsledcích vyhledávání na platformě Google(nové okno), čímž byly odhaleny hluboce osobní výměny názorů, o nichž uživatelé pravděpodobně předpokládali, že jsou soukromé. OpenAI tuto funkci brzy stáhla a uvedla, že spolupracuje se společností Google na odstranění indexace výsledků. Tento incident ale zdůrazňuje, jak snadno mohou AI interakce uniknout do veřejné domény, aniž byste si to uvědomili.

- Začátkem roku 2026 představila OpenAI reklamy pro uživatele ChatGPT s bezplatným plánem a plánem ChatGPT Go. Navzdory ujištěním, že reklamy neovlivní odpovědi ani nebudou zahrnovat sdílení osobních údajů s inzerenty, tento krok sleduje dobře zavedený vzorec Big Tech, ve kterém se inzerce po počátečních obavách o soukromí nakonec stane normální.

Obchodní riziko

OpenAI je americká společnost, takže používání ChatGPT může vyvolat obavy o ochranu osobních údajů a rizika úniku citlivých informací. Pokud sídlíte v Evropě nebo jinde, mohou být Vaše data stále předmětem americké jurisdikce, protože jsou zpracovávána americkou společností. Zde je vysvětlení, co to znamená:

- Bez silných záruk ochrany osobních údajů riskuje Vaše organizace pokuty nebo regulační kontrolu podle zákonů, jako je GDPR a HIPAA(nové okno).

- Trénováním AI modelů na Vašich firemních datech riskujete úniky. Zaměstnanci mohou například do ChatGPT zadat proprietární kód, důvěrné smlouvy nebo informace o klientech a potenciálně tak odhalit duševní vlastnictví, obchodní tajemství nebo data o zákaznících.

- OpenAI může sdílet data s partnery, prodejci, s další třetí stranou nebo prostřednictvím integrací v aplikacích — to vše by mohlo znamenat slabší ochranu soukromí nebo odlišné zásady práce s daty. V roce 2025 úniky informací týkající se jednoho z poskytovatelů analytiky OpenAI odhalily identifikační údaje o zákaznících z API.

- Podle amerických zákonů, jako je Patriot Act nebo FISA (Zákon o dohledu nad zahraničními zpravodajskými službami), mohou být společnosti nuceny poskytnout data vládním agenturám, často s příkazy k mlčenlivosti, které jim brání informovat uživatele.

Nedostatek transparentnosti

Výše uvedené představuje známá rizika. Ale to, co je na ChatGPT (a jiném softwaru s uzavřeným zdrojovým kódem) obzvláště rizikové, je to, co nesmíte vědět.

- Kód aplikací ChatGPT nemá otevřený zdrojový kód, takže neexistuje žádný veřejný dohled nad tím, jak funguje, jaké logy ukládá nebo jak zpracovává Vaše data v zákulisí. Musíte spoléhat na zásady OpenAI a věřit, že systém s daty nakládá zodpovědně.

- Ačkoli OpenAI vydala modely s otevřenou vahou (open-weight), které lze veřejně prozkoumat, modely AI, které ChatGPT používá, nemají otevřený zdrojový kód, takže nemůžete zkontrolovat, jak byla data předtrénována na velkých datových sadách.

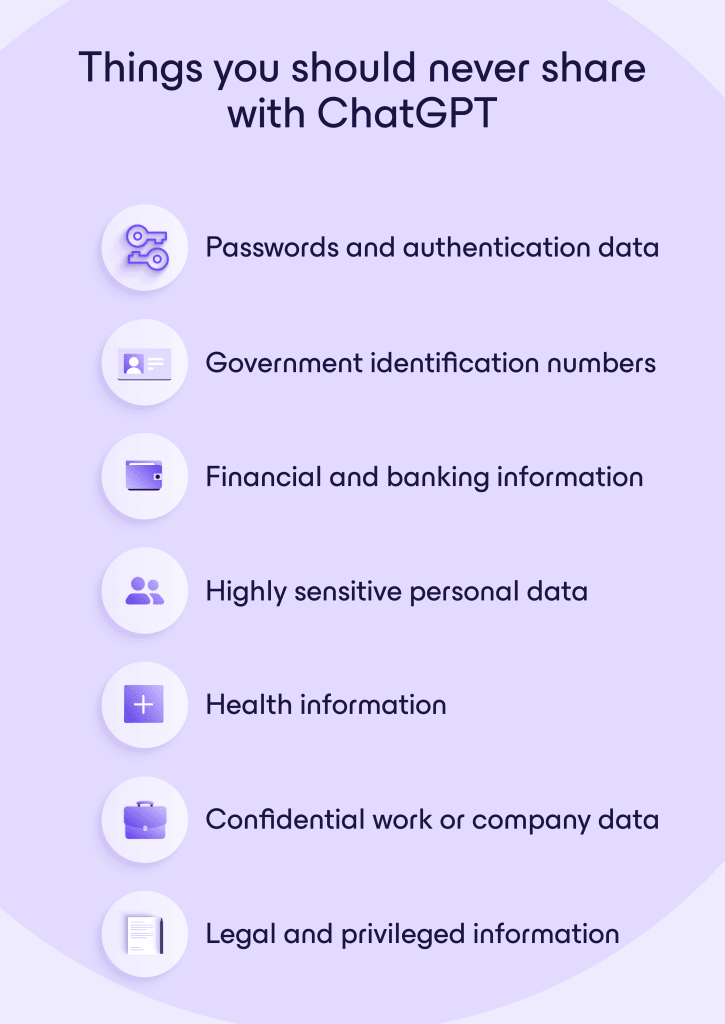

Věci, které byste nikdy neměli sdílet s ChatGPT

Ačkoli může být ChatGPT užitečný, nikdy byste s ním neměli zacházet jako s bezpečným trezorem pro citlivé informace. Vyvarujte se zadání čehokoli, co by Vám, Vaší společnosti nebo jiným mohlo ublížit, pokud by to bylo uložené, kontrolované nebo náhodně vystavené:

Hesla a ověřovací data, jako jsou hesla k účtům, kódy pro dvoufázové ověření (2FA), záložní kódy pro ověření nebo soukromé API klíče.

Vládní identifikační čísla, včetně čísla sociálního zabezpečení, národního průkazu totožnosti, pasu, řidičského průkazu a daňového identifikačního čísla.

Finanční a bankovní informace, jako jsou čísla kreditních nebo debetních karet, IBAN, přihlašovací údaje k online bankovnictví, přihlášení k investičním účtům nebo soukromé klíče od bitcoinových peněženek.

Vysoce citlivé osobní údaje, které by mohly být zneužity k Vaší identifikaci nebo sledování Vás či Vaší rodiny, jako je adresa bydliště a telefonní číslo, datum narození nebo soukromé fotografie či dokumenty.

Zdravotní informace, jako jsou lékařské zprávy, diagnostické záznamy, čísla pojištění, identifikační čísla pacientů nebo podrobné zdravotní anamnézy spojené s Vaší identitou.

Důvěrná pracovní nebo firemní data, včetně proprietárního zdrojového kódu, interních strategických dokumentů, důvěrných smluv, zákaznických databází, detailů o klientech, finančních prognóz, nepublikovaných zpráv nebo dohod o mlčenlivosti (NDA).

Právní a chráněné informace, jako je komunikace mezi advokátem a klientem, strategie právních případů, důkazní dokumenty nebo diskuze o důvěrných urovnáních.

Jak zůstat v bezpečí při používání ChatGPT

Nemusíte se vyhýbat AI nástrojům úplně, ale měli byste k nim přistupovat spíše jako k veřejným službám než k soukromým pracovním prostorům. Několik jednoduchých návyků může významně snížit Vaše riziko:

- Vyvarujte se sdílení citlivých informací, u kterých byste nechtěli, aby byly uložené, zkontrolované nebo veřejně vystavené.

- Odeberte identifikační detaily nebo je nahraďte zástupnými znaky či fiktivními příklady.

- Nahrajte pouze soubory, které neobsahují citlivé nebo důvěrné informace.

- K chatům s AI přistupujte jako k e-mailům nebo lístkům na podpoře, které by mohli vidět ostatní lidé.

- Zkontrolujte nastavení soukromí a deaktivujte nastavení jako je historie chatů, paměť nebo trénování umělé inteligence.

- Smažte konverzace, které již nepotřebujete, abyste omezili množství osobních informací, které zůstanou spojeny s Vaším účtem.

Přejděte na soukromého AI asistenta

Pokud máte obavy ze sdílení osobních nebo firemních informací s nástroji AI, vyzkoušejte Lumo. Naše soukromá alternativa k ChatGPT nikdy nezaznamenává Vaše konverzace ani je nepoužívá k trénování modelu. Vaše data jsou chráněna obousměrným asymetrickým šifrováním (formou koncového šifrování) a zpracovávána na evropských serverech pod kontrolou Proton.

Když používáte Lumo s účtem Proton, jsou Vaše konverzace chráněny šifrováním bez přístupu poskytovatele (zero-access encryption), což znamená, že si je můžete přečíst pouze Vy — a to ani Proton. Pro maximální soukromí Vám režim Ghost umožňuje používat Lumo bez jakéhokoli ukládání historie.

Lumo využívá modely s otevřeným zdrojovým kódem, takže kdokoli si může ověřit, že k žádnému skrytému sledování nebo shromažďování dat nedochází.

Vyzkoušejte Lumo hned teď a podívejte se, jak vypadá umělá inteligence, když na vašem soukromí záleží nejvíce. A až budete připraveni přinést stejnou úroveň soukromí i na své pracoviště, Lumo for Business pomůže vašemu týmu bezpečně spolupracovat a zůstat produktivní, aniž by byla kompromitována citlivá firemní data.

\n\nLumo si můžete také stáhnout z Google Play(nové okno) nebo App Store(nové okno).