ChatGPTは毎日何百万ものユーザーに使用されている強力なAIアシスタント(新しいウィンドウ)ですが、安全に使用できるのでしょうか?それは世界最大のテクノロジー企業の1つであるOpenAIによって所有および運営されています。そして、多くの巨大ITプラットフォームと同様に、OpenAIは大量のユーザーデータを収集します。そのデータはゼロアクセス暗号化で保護されていないため、同社はそれをビジネスパートナー(広告や分析会社を含む)、政府、およびデータ侵害の予定においてハッカーに漏らす可能性があります。

舞台裏では、OpenAIの大規模言語モデル(LLM)が、入力した内容から常に学習しています。健康上の症状、法的な問題、または知的財産に関する質問などの機密性の高い質問は、複雑なプロファイリングシステムに供給されたり、当初の意図をはるかに超えて使用されるAIモデルのトレーニングに役立つ可能性があります。

AI企業がユーザーデータをどのように扱うかについての懸念が高まっています。2026年3月、AIシステムがどのようにデプロイされ、ガバナンスされているかについて、米国政府との物議を醸すパートナーシップが疑問を投げかけた後、250万人を超えるユーザー(新しいウィンドウ)がChatGPTを離れることを誓いました。これは、強力なプライバシー保護なしにAIアシスタントとやり取りする場合、自分が認識している以上の情報を共有している可能性があることを思い出させるものです。

- ChatGPTは安全ですか?ChatGPTやその他の巨大IT企業のようなAIを使用するリスク

- ChatGPTと決して共有してはならないこと

- ChatGPTを安全に使用する方法

- プライベートAIアシスタントに切り替える

ChatGPTは安全ですか?ChatGPTやその他の巨大IT企業のようなAIを使用するリスク

ChatGPT、Gemini、Meta AI、Copilot、DeepSeekのようなAIツールを選ぶ前に、それらのセキュリティおよびプライバシーリスクを理解しておくことが重要です。

| リスク | 潜在的な影響 | それが重要である理由 |

| データ収集とロギング | プロンプト、ファイルのアップロード、および対話パターンが保管済みになる可能性があります | AIのトレーニング、行動プロファイリング、または人間によるレビューに使用できます |

| ゼロアクセス暗号化の欠如 | 会話はOpenAIとそのパートナーによってアクセスされる可能性があります | 機密データが暴露されるリスクが高まります |

| 規制およびIPの懸念 | GDPR/HIPAAの露出または専有データの漏洩防止 | 法的責任と財政的影響 |

| クローズドソースシステム | データ処理の透明性が限られている | OpenAIへの信頼が必要です |

| アプリ内広告 | 追跡とプロファイリングの増加 | チャットデータがパーソナライズされた広告にどのように影響するかは不明 |

個人のプライバシー

ChatGPTを使用することで生じるリスクは次のとおりです:

- ChatGPTは、質問、回答、ツールとの対話方法など、あなたが入力した情報を収集して、AIモデルをトレーニングする場合があります。個人データを含む履歴書、法的文書、医療報告書、またはその他のファイルをアップロードした場合、そのコンテンツも保管済みになり、処理される可能性があります。

- 名前やその他の個人データを入力しなくても、プロンプトによって、健康上の懸念、宗教上の疑念、政治的傾向、家族状況、感情状態などのパターンが時間の経過とともに明らかになる可能性があります。あなたのIPアドレス(新しいウィンドウ)やその他の技術的識別子と組み合わせることで、これらのパターンを使用して詳細な行動プロファイルを作成できます。

- AIのトレーニングをオプトアウトすることはできるかもしれませんが、会話は依然としてログに記録され、フィードバックを送信したときなど、フラグが立てられた場合は、機密性の高い詳細が人間のレビュー担当者に見られる可能性があります。

- チャットの履歴は送信および保管済みになっている間は保護されますが、ゼロアクセス暗号化で保護されていないため、OpenAIまたはサードパーティは過去の会話に引き続きアクセスできます。

- 2025年7月、何千もの共有されたChatGPTの会話がGoogleの検索結果に表示され(新しいウィンドウ)、ユーザーがプライベートであると思い込んでいたであろう、深く個人的なやり取りが暴露されました。OpenAIはすぐにこの機能を取り下げ、結果をインデックスから削除するためにGoogleと協力していると述べましたが、このインシデントは、自分が気付かないうちにAIとのやり取りがどれほど簡単にパブリックドメインに滑り込む可能性があるかを浮き彫りにしています。

- 2026年初頭、OpenAIは無料プランおよびChatGPT Goプランのユーザー向けにChatGPTの広告を導入しました。広告が回答に影響を与えたり、広告主と個人データを共有したりすることはないと保証されているにもかかわらず、この動きは、当初のプライバシーの懸念の後に広告が最終的に標準化されるという、巨大IT企業のよく確立されたパターンに従っています。

ビジネスリスク

OpenAIは米国企業であるため、ChatGPTの利用は、データ保護に関する懸念や、機密情報が漏洩するリスクを生じさせる可能性があります。お客様がヨーロッパまたはその他の地域に拠点を置いている場合でも、データは米国企業によって処理されるため、依然として米国の管轄下に置かれる可能性があります。これが意味することは次のとおりです。

- 強力なデータ保護の保証がない場合、組織は、GDPRやHIPAA(新しいウィンドウ)などの法律に基づく罰金や規制上の精査のリスクに直面します。

- 自社のデータでAIモデルをトレーニングすることにより、漏洩防止のリスクがあります。たとえば、従業員が専有のコード、機密の契約書、またはクライアント情報をChatGPTに入力し、知的財産、企業秘密、または顧客データを暴露する可能性があります。

- OpenAIは、パートナー、ベンダー、その他のサードパーティ、またはアプリの統合を通じてデータを共有する可能性があります。これらは、プライバシー保護が弱いか、データポリシーが異なる場合があります。2025年、OpenAIの分析ベンダーの1つが関与する侵害により、APIの顧客に関する識別情報が暴露されました。

- 愛国者法やFISA(外国情報監視法)などの米国の法律に基づき、企業は政府機関にデータを提供するよう強制される可能性があり、多くの場合、ユーザーへの通知を妨げる秘密保持命令が伴います。

透明性の欠如

上記は既知のリスクです。しかし、ChatGPT(およびその他のクローズドソースのソフトウェア)で特にリスクが高いのは、知ることが許可されていないことです。

- ChatGPTのアプリのコードはオープンソースではないため、それがどのように機能し、何をログに記録し、裏でデータをどのように処理するかに対するパブリックな監視はありません。OpenAIのポリシーに依存し、システムがデータを責任を持ってユーザー名すると信頼する必要があります。

- OpenAIは公開で検査できるオープンウェイトモデルをリリースしていますが、ChatGPTが使用するAIモデルはオープンソースではないため、データが大規模なデータセットでどのように事前トレーニングされたかを確認することはできません。

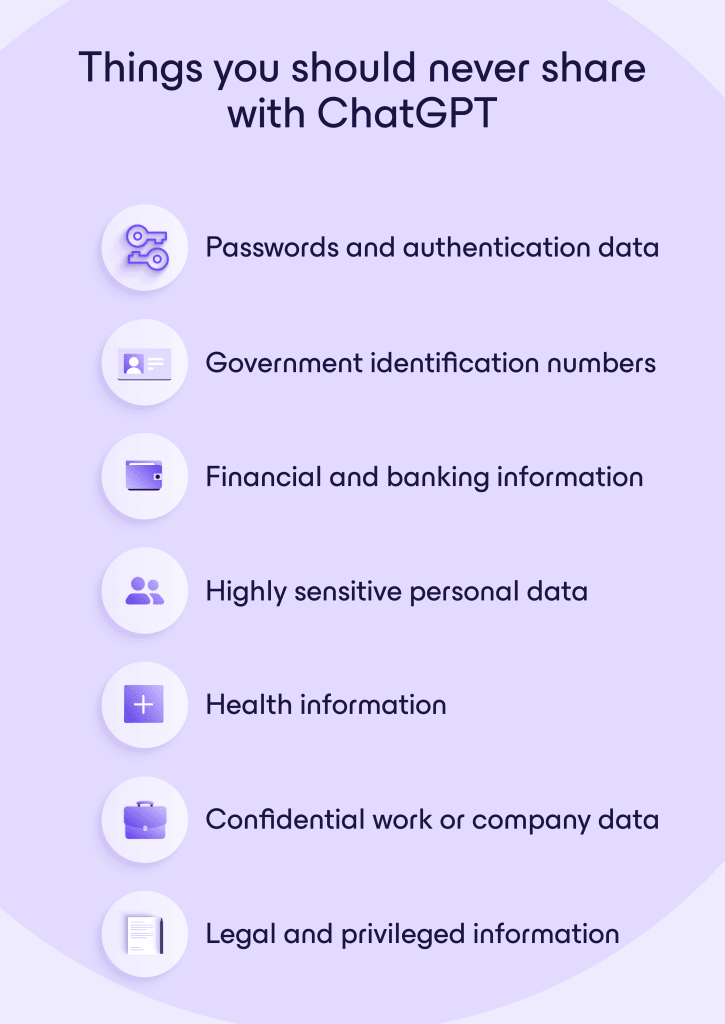

ChatGPTと決して共有してはならないこと

ChatGPTは役立つ可能性がありますが、機密情報のための安全な保管庫のように扱うべきではありません。保管済みになったり、レビューされたり、誤って暴露されたりした場合に、自分自身、会社、または他人に危害を及ぼす可能性のあるものは入力しないでください:

パスワードおよび認証データ:アカウントのパスワード、2要素認証(2FA)コード、バックアップ認証コード、またはプライベートAPIキーなど。

政府の識別番号:社会保障番号、国民ID、パスポート、運転免許証、納税者番号など。

財務および銀行情報:クレジットまたはデビットカード番号、IBAN、オンラインバンキングの認証情報、投資アカウントのログイン、またはBitcoinウォレットのプライベートキーなど。

極めて機密性の高い個人データ:自宅の住所や電話番号、生年月日、プライベートな写真やドキュメントなど、お客様やお客様の家族を特定または追跡するために使用される可能性のあるもの。

健康情報:医療報告書、診断記録、保険番号、患者ID、またはお客様のユーザー情報に紐付いた詳細な健康履歴など。

機密の業務または企業データ:専有のソースコード、社内戦略文書、機密の契約書、顧客データベース、クライアントの詳細、財務予測、未発表のレポート、またはNDAなど。

法的および特権情報:弁護士とクライアントの通信、訴訟戦略、証拠書類、または機密の和解の議論など。

ChatGPTを安全に使用する方法

AIツールを完全に避ける必要はありませんが、プライベートなワークスペースとしてではなく、一般向けのサービスとして扱う必要があります。いくつかの簡単な習慣でリスクを大幅に軽減できます:

- 保管済み、レビュー、または公開されることを望まない機密情報の共有は避けてください。

- 詳細な識別情報を削除するか、プレースホルダーまたは架空の例に置き換えます。

- 機密情報や極秘情報を含まないファイルのみをアップロードしてください。

- AIチャットは、他の人に見られる可能性のあるメールやサポートチケットのように扱ってください。

- プライバシー設定を確認し、チャット履歴、メモリ、またはAIトレーニングなどの設定を無効化します。

- アカウントに関連付けられたままになる個人情報を減らすために、不要になった会話を削除してください。

プライベートAIアシスタントに切り替える

AIツールとの個人情報やビジネス情報の共有に懸念がある場合は、Lumoをお試しください。当社のプライベートなChatGPTの代替品は、お客様の会話をログに記録したり、モデルのトレーニングに使用したりすることは決してありません。お客様のデータは双方向の非対称暗号化(エンドツーエンド暗号化の一種)で保護され、Protonが管理するヨーロッパのサーバーで処理されます。

ProtonアカウントでLumoを使用する場合、会話はゼロアクセス暗号化で保護されます。つまり、会話を既読できるのはお客様だけであり、Protonでさえも読めません。最大限のプライバシーを確保するために、ゴーストモードでは履歴を一切保存せずにLumoを使用できます。

Lumoはオープンソースモデルを使用しているため、隠れた追跡やデータ収集が発生していないことを誰でも検証できます。

お客様のプライバシーが最も重要視される場合のAIの姿を、今すぐLumoを試してご確認ください。そして、同じレベルのプライバシーを職場に導入する準備ができたら、Lumo for Businessがチームの安全なコラボレーションを支援し、機密の会社データを侵害することなく生産性を維持します。

また、Google Play(新しいウィンドウ)またはApp Store(新しいウィンドウ)からLumoをダウンロードすることもできます。