Windows 10のサポートが2025年10月に正式に終了することに伴い、多くのユーザーがセキュリティ更新プログラムによる保護を維持するためにWindows 11にアップグレードしています。しかし、新しいAIコンパニオン、Copilotが待ち受けていることに驚く人もいるかもしれません。

生成AIへのMicrosoftの最も野心的な取り組みとして位置付けられているCopilotは、現在、Windows 11、Edge、Bing、Microsoft 365スイート全体に深く統合されています。これは、Copilotのインテリジェンスを支えるGPTモデルの作成者であるOpenAI(ChatGPTおよびChatGPT Atlasの作成者)との数十億ドル規模のパートナーシップの中心的存在です。専用のCopilotキーを搭載したCopilot+ PCの発売と相まって、これらはすべて、MicrosoftがWindowsをAI主導の未来へと導くことにどれほど本気であるかを示しています。

しかし、Clippyを彷彿とさせつつも、はるかにしつこいこの常駐型ヘルパーを誰もが歓迎しているわけではありません。Copilotの緊密な統合は、Microsoft傘下のLinkedInが公開プロフィールとアクティビティデータを使用してAIをトレーニングし始めた時や、GoogleがAIアシスタントGeminiをAndroidに深く埋め込み、Googleアシスタントを置き換える計画を立てた時と同様に、プライバシーとセキュリティの懸念を引き起こしています。

Microsoft 365エンタープライズユーザーとIT管理者のみが、Windows 11からCopilotを完全に削除できます。その他の場合(個人またはファミリーサブスクリプションのユーザー、またはMicrosoft 365サブスクリプションを持っていないユーザーなど)は、その機能を制限し、表示を控えめにする方法しかありません。

- Copilot AIをオフにする方法

- Microsoft Copilotとは?

- Microsoft Copilotのプライバシーリスクとは?

- Microsoft Copilotのセキュリティリスクとは?

- CopilotとMicrosoftに代わるプライベートな選択肢

Copilot AIをオフにする方法

Copilotの使用方法に応じて、コンピューターから削除したり、設定を調整したり、存在感を弱めたりする方法は以下の通りです:

Microsoft 365 Copilotを削除する方法(エンタープライズサブスクリプション)

エンタープライズユーザーの場合は、設定 → アプリ → インストールされているアプリに移動し、Copilotを選択してアンインストールをクリックします。

IT管理者は、PowerShellで次のコマンドを使用してCopilotアプリを削除できます:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Microsoft 365 Copilotを無効にする方法(個人またはファミリーサブスクリプション)

- Microsoft 365アプリ(Word、Excel、PowerPoint、またはOneNote)を開きます。

- ファイル → オプション → Copilotに移動します。

- Copilotを有効にするのチェックボックスをクリア(オフに)します。

Copilotを無効にしたい各Microsoftアプリで、これらの手順を繰り返します。

どのMicrosoftアプリにも「Copilotを有効にする」設定が存在しない場合:

- Word、Excel、PowerPoint、またはOneNoteを開きます。

- ファイル → アカウント → アカウントのプライバシー → 設定の管理 → コネクテッドエクスペリエンスに移動します。

- コンテンツを分析するエクスペリエンスをオンにするのチェックボックスをクリア(オフに)します。

- アプリを再起動します。

新しいプライバシー設定は、アカウントにリンクされたすべてのMicrosoft 365アプリに自動的に適用されるため、これを行うのは一度だけで済みます。

Windows 11でCopilotアイコンを隠す方法

WindowsでCopilotアイコンをオフにすることはできますが、コンピューターからこの機能を完全に削除することはできません。これらの手順はCopilotの視覚的要素とパーソナライズ要素を無効にするだけであり、アプリへのアクセスは引き続き可能です。

タスクバーからCopilotボタンを隠すには:

- 設定 → 個人用設定 → タスクバーに移動します。

- Copilotを見つけてオフに切り替えます。

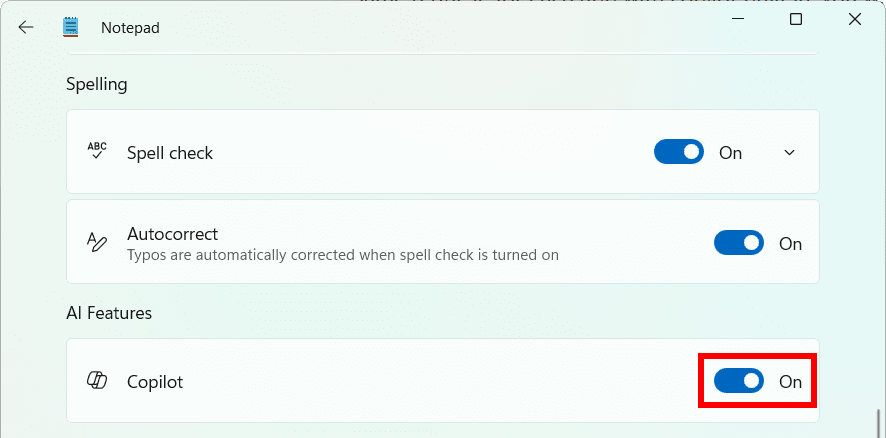

Copilotが組み込まれているアプリを使用する場合、各アプリで個別に無効にする必要があります。例えばメモ帳の場合、設定 → AI機能に移動し、Copilotをオフに切り替えます。

- 変更を有効にするためにコンピューターを再起動します。

Copilotウェブアプリでデータとパーソナライズ機能を無効にする方法

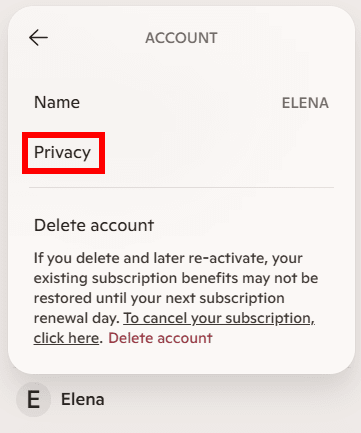

- プロフィール名または写真 → アカウント → プライバシーを選択します。

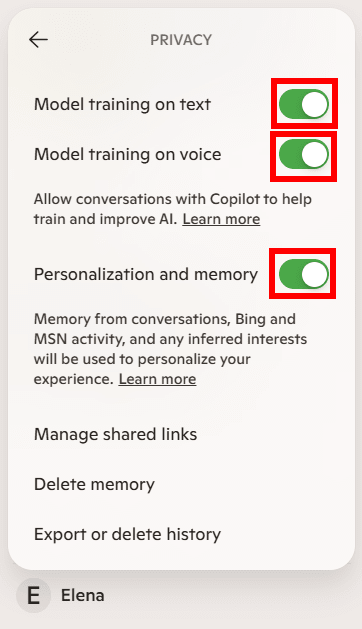

- 以下のオプションをオフに切り替えます:

- テキストでのモデルトレーニング

- 音声でのモデルトレーニング

- パーソナライズとメモリ

- メモリを削除を選択して、Copilotがお客様について記憶している内容を即座に削除します。

- 履歴のエクスポートまたは削除をクリックします。これによりブラウザページが開き、Copilotに使用しているMicrosoftアカウントでサインインする必要があります。

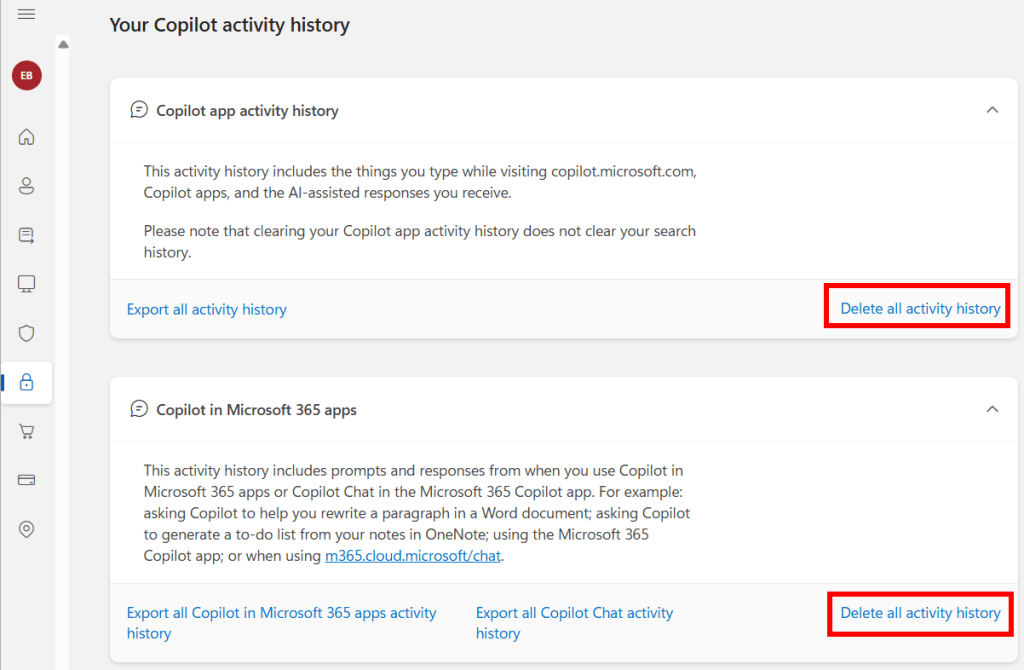

- これらの各カテゴリについてすべてのアクティビティ履歴を削除するを選択します:

- Copilotアプリのアクティビティ履歴

- Microsoft 365アプリ内のCopilot

- Windowsアプリ内のCopilot

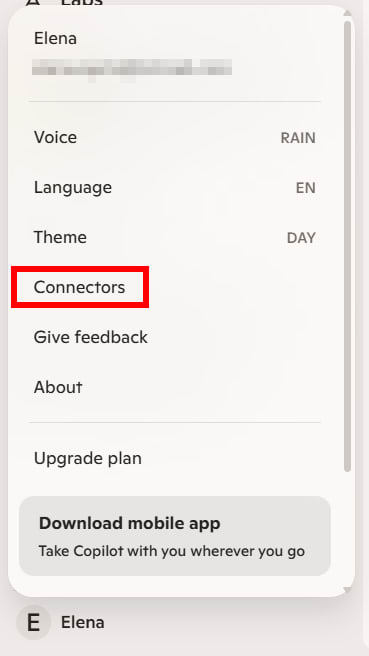

- プロフィール名または写真 → コネクタを選択します。

- OneDrive、Outlook、Gmail、Googleドライブ、Googleカレンダーを含むすべてをオフに切り替えます。

データがすでにモデルのトレーニングに使用されている場合、元に戻す方法はないことに注意してください。

Gaming Copilotのモデルトレーニングを無効にする方法

- Windowsで、Win + Gを押してゲームバーを開きます。

- 設定 → プライバシー設定 → Gaming Copilotに移動します。

- テキストでのモデルトレーニングをオフに切り替えます。

- Gaming Copilotウィジェットを隠すには、ゲームバーのウィジェットリストから削除します。

現在、Xbox Game BarからGaming Copilotを完全に削除する方法はありません。さらに、AIモデルのトレーニングを支援するためにお客様の音声インタラクションを使用することを防ぐこともできません。プライバシーを重視する場合は、Gaming Copilotと一切やり取りしないのが最も安全です。

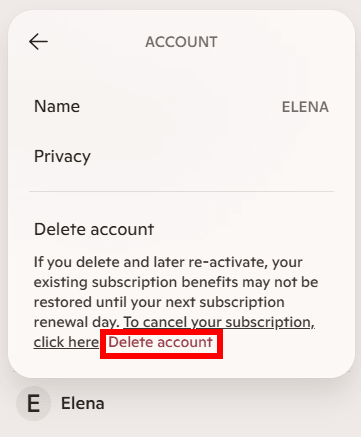

Copilotアカウントを削除する方法

Copilotウェブアプリで、プロフィール名または写真 → アカウント → アカウントを削除を選択します。

Copilotアカウントを削除してもMicrosoftアカウントは削除されず、サインインせずにCopilotを使用することは可能です。

Copilotに全く頼りたくない場合は、データをログに記録したり、モデルのトレーニングに使用したり、第三者と共有したりしないプライバシーAIアシスタント(新しいウィンドウ)への切り替えを検討してください。

Microsoft Copilotとは?

Copilotは、Word、Excel、PowerPoint、Outlook、Teams、Windowsなどの製品やサービスに統合されたMicrosoftのAIアシスタントシリーズです。Microsoft独自のAI技術と、ChatGPTを動かしているのと同じGPT-4oなどのOpenAIのGPTに基づく大規模言語モデル(LLM)を使用しています。

LLMと同様に、Copilotは自然言語のプロンプトを理解し、データを分析し、コンテンツを生成および要約し、文脈に基づいた提案を提供することで、生産性、創造性、効率性の向上を支援します。

Microsoftは、個人的に使用するか仕事で使用するかに応じて、いくつかのバージョンのCopilotを提供しています:

- Microsoft Copilot — 日常的なタスクのための無料の個人用AIアシスタント。Windows 11アプリ(デフォルトでインストール済み)、ウェブアプリ、macOSアプリとして利用可能です。

- Gaming Copilot — Windowsゲーミングのための無料の個人用AIアシスタント。Recallがデスクトップアクティビティのスナップショットを撮るのと同様に、スクリーンショットを撮ってゲーム内で何が起きているかを理解し、ヒントを提供します。

- Microsoft 365 Copilot — Word、Excel、PowerPoint、Outlook、Teamsに統合され、メール、カレンダー、ドキュメントなどのデータを接続するプラットフォームであるMicrosoft Graphを介してお客様のデータを使用します。

Microsoft Copilotのプライバシーリスクとは?

Microsoftは、Microsoft 365などのエンタープライズ設定ではCopilotに対して強力なプライバシー保護を維持していますが、消費者アカウントは全く異なる現実に直面しています(新しいウィンドウ):

データが広告やプロファイリングに使用される可能性がある

消費者向けMicrosoftアカウントのCopilotサービスは、Microsoftの広告エコシステムに接続されています。これは、お客様のやり取りが表示される広告やおすすめに影響を与える可能性があることを意味します。例えば、Copilotに旅行のお得情報について尋ねると、後でフライトやホテルの広告が表示される可能性があります。

Microsoftアカウントのプライバシー設定でパーソナライズされた広告をオフにすることはできますが、同社はそのインタラクションデータを保持し、お客様と似たプロフィールを持つ他のCopilotユーザーへの広告ターゲティングを改善するなど、他の目的のために匿名化された形式で使用する可能性があります。

所有権は保持されるが、Microsoftは依然としてデータを使用できる

Microsoftはコンテンツの所有権はお客様にあるとしていますが、Copilotを使用することは、データの「複製、配布、送信、公的な表示、公的な実演、編集、翻訳、再フォーマット」を行い、それらの権利を第三者に譲渡することを含め、同社に広範な権利を付与することを意味します。

例えば、作家であるお客様が未発表の物語からの抜粋をCopilotに入力し、校正や文体的なフィードバックを求めた場合、そのテキストは技術的には、サービス規約の下でMicrosoftが処理および使用することを許可された資料の一部となります。お客様の未発表の知的財産は、たとえ公表されなくても、直接の管理を超えて使用される可能性があります。

データが処理され、AIトレーニングに使用される可能性がある

Copilotのプロンプトと応答からのデータは、AIトレーニングのためにMicrosoftによって収集、ログ記録、分析される可能性があります。機密データや個人データがトレーニングデータセットから除外されるという保証はありません。

ほとんどのAIアシスタントと同様に、Copilotは回答の学習と改善を続けるために膨大な量の情報を必要とします。たとえそのプロセスが知的財産のグレーゾーンに踏み込む可能性があるとしてもです。最近の例として、作家や主要な報道機関が起こした一連の米国での訴訟(新しいウィンドウ)があります。彼らは、MicrosoftとそのパートナーであるOpenAIが、CopilotやChatGPTなどのAIモデルをトレーニングするために、許可なく著作物を使用したと主張しています。OpenAI自身も、「著作物を使用せずに今日の主要なAIシステムをトレーニングすることは不可能である」と公に認めています(新しいウィンドウ)。

第三者がお客様の機密データを閲覧する可能性があります

Microsoftの従業員は、サービスの改善、有害なコンテンツのモデレート、またはフィードバックの送信時などに、お客様のCopilotへの入力や出力(ファイルとして添付されアップロードまたは入力されたものを含む)を確認する場合があります。もしこのことで不安を感じるなら、個人を特定できるデータや企業秘密などの機密情報の入力は避けるべきです。

コネクタにより、お客様のデータがサードパーティにさらされます

コネクタを使用すると、CopilotをMicrosoft製品(OneDriveやOutlookなど)やサードパーティのサービス(Googleドライブなど)とリンクさせ、複数のソースから情報を引き出すことができます。たとえば、Googleドライブに保存されているすべての会議メモを要約するようにCopilotに依頼すると、ドライブ内のファイルを検索して要約を返します。

しかし、コネクタを有効にすると、Copilotがその外部サービスと情報を交換することも許可することになります。Googleドライブの場合、Copilotがドライブのファイル構造、名前、タイムスタンプ、コンテンツへのアクセス権を取得する一方で、Googleもお客様のプロフィール写真、名前、メールアドレスなど、Microsoftアカウントに関連する特定の詳細情報を受け取ります。お客様の貴重なデータは両方のエコシステム(MicrosoftとGoogle)に存在することになり、プラットフォームを超えてお客様のより明確で完全なプロフィールが作成されます。

お客様のデータは、米国の管轄下で国境を越える可能性があります

居住地によっては、Microsoftはお客様のCopilotデータややり取りをお客様の地域に保管する場合があります。たとえば、ヨーロッパのユーザーのデータはEU内に保管される可能性があります。しかし、データが常にそこに留まるとは限りません。同社のEUデータ境界のコミットメント(新しいウィンドウ)にもかかわらず、技術的または容量的な理由により、一部の処理はお客様の地域外で行われる可能性があります。また、Microsoftは米国企業であるため、CLOUD法などの米国法の対象となります。つまり、米国当局はお客様のデータへのアクセスを要求することができ(保管場所に関わらず)、場合によっては令状なしで行われることもあります。

MicrosoftはCopilotのチャットデータを厳重に監視しています

Microsoftは、人々が長期にわたってアシスタントをどのように使用しているかを理解するために、Copilotのやり取りを大規模に分析しています。Copilot Usage Report 2025(新しいウィンドウ)では、AI研究者が3,750万件のCopilotの会話を調査して使用パターンを特定しており、より多くのデータが利用可能になるにつれて、さらなるレポートが公開されると述べています。これを行っているのはMicrosoftだけではありません。パートナーであるOpenAIも、ChatGPTの消費者利用データ(新しいウィンドウ)を公開しています。

Microsoftはこのデータが非識別化され、高レベルの要約に縮小されたと述べていますが、それでプライバシーのリスクが完全になくなるわけではありません。研究(新しいウィンドウ)により、匿名化されたとされるデータでも、タイムスタンプ、デバイスの特性、位置信号などの他の要素と組み合わせることで、再識別が可能になることが多いと繰り返し示されています。また、CopilotはWindows、Microsoft 365、Bing、Edge、広告サービスにまたがるアカウントベースのエコシステムに紐付いているため、これらのサービス間の接続により、時間の経過とともに再関連付けが容易になります。

さらに、元の識別可能なCopilotの会話データが非識別化される前にどれくらいの期間保管されるのか、またどのように保護されているのかも不明です。生データがMicrosoftのサーバーにある場合、不正アクセス、内部の脅威、またはデータ侵害などのリスクにさらされる可能性があります。

Microsoft Copilotのセキュリティリスクとは?

Microsoftは組織ごとに平均300万件の機密データレコード(新しいウィンドウ)にアクセスできるため、それがもたらすセキュリティリスクを理解することは重要です。特にビジネスでの利用を計画している場合はなおさらです。

- 2025年6月、研究者たちはEchoLeak(CVE-2025-32711(新しいウィンドウ))を発見しました。これはMicrosoft 365 Copilotにおけるゼロクリックの脆弱性で、攻撃者がユーザーの操作なしにデータを盗むことを可能にするものでした。攻撃者は通常のメールの中に悪意のある指示やリンクを隠すことで、Copilotを騙してそれらのコマンドに従わせ、リンクにアクセスさせ、ユーザーのデータの一部を外部サーバーに送信させることができました。この脆弱性は修正されましたが、CopilotのようなAIアシスタントをコアシステムに統合し、メール、ドキュメント、内部データへの広範なアクセス権を与えることが、操作されたり設定ミスがあったりした場合に、いかにして内部の脅威となり得るかを示す一例です。

- 2024年8月、あるサイバーセキュリティ企業(新しいウィンドウ)がMicrosoft Copilot Studioに重大な情報開示の欠陥を発見しました。これにより、カスタムCopilotが弱い保護を悪用し、機密情報(サービストークンやデータベースキーなど)を取得して内部システムのさらに深部へと侵入することが可能になっていました。Microsoftはこの問題を修正しました。

- 2025年10月、セキュリティ研究者(新しいウィンドウ)はCoPhishと呼ばれるフィッシング手法を発見しました。これはMicrosoft Copilot Studioを悪用して、悪意のあるログインページを完全に正規のものに見せかけるものです。攻撃者は、ログインボタンが被害者を偽のOAuth同意ページにリダイレクトするCopilot Studioエージェントを作成し、そのエージェントのリンク(信頼できるMicrosoftドメインでホストされている)を共有して、ユーザーにアクセス権を付与させることができます。同意が得られると、攻撃者はトークンを取得し、メール、チャット、カレンダー、メモなどのデータを読み取ったり、書き込んだり、送信したりできるようになります。Microsoftはこの問題に現在も対応中です。

CopilotとMicrosoftに代わるプライベートな選択肢

CopilotがWindowsにどれほど深く統合されているか、MicrosoftがAIサービスを通じてどれほどのデータを収集しているかに不安を感じつつも、AIチャットボットの利便性は捨てがたいとお考えなら、私たちのプライベートAIアシスタント(新しいウィンドウ)であるLumoに切り替えてください。ヨーロッパに拠点を置くLumoは、お客様のデータを収集したりトレーニングに使用したりすることは決してなく、広告を表示したり、ログを保持したり、お客様の情報を誰かと共有したりすることもありません。

そして、Microsoftのエコシステムから完全に抜け出す準備ができているなら、私たちの暗号化されたエコシステムを使って、独自のプライベートなデジタルワークスペースを構築できます。以下のサービスが利用可能です:

- 安全な無料メールとプライベートなスケジュール管理のためのProton MailとProton Calendar

- 安全なパスワード管理のためのProton Pass

- 暗号化されたクラウドストレージとファイル共有のためのProton Drive

- インターネットトラフィックを保護(新しいウィンドウ)するためのProton VPN

すべてのProtonサービスは、エンドツーエンド暗号化を使用し、デフォルトでお客様のプライバシーを守るように構築されています。そのため、お客様以外の誰も(私たちでさえも)データにアクセスすることはできません。