Wraz z oficjalnym zakończeniem wsparcia dla Windows 10 w październiku 2025 roku, wielu użytkowników aktualizuje system do Windows 11, aby zachować ochronę dzięki aktualizacjom bezpieczeństwa. Niektórzy mogą być jednak zaskoczeni, znajdując nowego towarzysza AI czekającego na nich: Copilot.

Pozycjonowany jako najbardziej ambitny wysiłek Microsoftu w dziedzinie generatywnej AI, Copilot jest teraz głęboko zintegrowany z Windows 11, Edge, Bing i pakietem Microsoft 365. Jest centralnym elementem wielomiliardowego partnerstwa Microsoftu z OpenAI (twórcą ChatGPT i ChatGPT Atlas), którego modele GPT napędzają inteligencję Copilot. W połączeniu z wprowadzeniem komputerów Copilot+ PC — wyposażonych w dedykowany klawisz Copilot — wszystko to pokazuje, jak poważnie Microsoft podchodzi do kierowania Windows w stronę przyszłości napędzanej przez AI.

Jednak nie każdy wita tego zawsze obecnego pomocnika, przypominającego Pana Spinacza, ale znacznie bardziej natrętnego. Ścisła integracja Copilot budzi obawy o prywatność i bezpieczeństwo, podobnie jak wtedy, gdy należący do Microsoftu LinkedIn zaczął trenować AI przy użyciu publicznych profili i danych o aktywności, lub gdy Google planuje głęboko osadzić swojego asystenta AI Gemini w systemie Android, aby zastąpić Asystenta Google.

Tylko użytkownicy Microsoft 365 w wersji dla przedsiębiorstw i administratorzy IT mogą całkowicie usunąć Copilot z Windows 11. We wszystkich innych przypadkach — takich jak użytkownicy z subskrypcjami osobistymi lub rodzinnymi, lub bez subskrypcji Microsoft 365 w ogóle — istnieją tylko sposoby na ograniczenie jego funkcji i zmniejszenie jego widoczności.

- Jak wyłączyć Copilot AI

- Jak usunąć Microsoft 365 Copilot (subskrypcja dla przedsiębiorstw)

- Jak wyłączyć Microsoft 365 Copilot (subskrypcja osobista lub rodzinna)

- Jak ukryć ikony Copilot w Windows 11

- Jak wyłączyć funkcje danych i personalizacji w aplikacji webowej Copilot

- Jak wyłączyć trenowanie modelu Gaming Copilot

- Jak usunąć swoje konto Copilot

- Czym jest Microsoft Copilot?

- Jakie są zagrożenia dla prywatności związane z Microsoft Copilot?

- Jakie są zagrożenia bezpieczeństwa związane z Microsoft Copilot?

- Prywatna alternatywa dla Copilot i Microsoft

Jak wyłączyć Copilot AI

W zależności od tego, jak korzystasz z Copilot, oto jak możesz usunąć go ze swojego komputera, dostosować jego ustawienia lub ograniczyć jego obecność:

Jak usunąć Microsoft 365 Copilot (subskrypcja dla przedsiębiorstw)

Jeśli jesteś użytkownikiem korporacyjnym, przejdź do Ustawienia → Aplikacje → Zainstalowane aplikacje, wybierz Copilot i kliknij Odinstaluj.

Administratorzy IT mogą usunąć aplikację Copilot za pomocą następującego polecenia w PowerShell:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Jak wyłączyć Microsoft 365 Copilot (subskrypcja osobista lub rodzinna)

- Otwórz dowolną aplikację Microsoft 365 (Word, Excel, PowerPoint lub OneNote).

- Przejdź do Plik → Opcje → Copilot.

- Odznacz pole Włącz Copilot.

Powtórz te kroki dla każdej aplikacji Microsoft, w której chcesz wyłączyć Copilot.

Jeśli ustawienie Włącz Copilot nie istnieje w żadnej z aplikacji Microsoft:

- Otwórz Word, Excel, PowerPoint lub OneNote.

- Przejdź do Plik → Konto → Prywatność konta → Zarządzaj ustawieniami → Połączone doświadczenia.

- Odznacz pole Włącz doświadczenia analizujące Twoją zawartość.

- Uruchom ponownie aplikację.

Musisz to zrobić tylko raz, ponieważ nowe ustawienie prywatności automatycznie zastosuje się do wszystkich aplikacji Microsoft 365 powiązanych z Twoim kontem.

Jak ukryć ikony Copilot w Windows 11

Możesz wyłączyć ikony Copilot w Windows, ale nie możesz całkowicie usunąć tej funkcji ze swojego komputera. Te kroki wyłączają tylko elementy wizualne i personalizacyjne Copilot, więc nadal będziesz mógł uzyskać dostęp do aplikacji.

Aby ukryć przycisk Copilot na pasku zadań:

- Przejdź do Ustawienia → Personalizacja → Pasek zadań.

- Znajdź i wyłącz Copilot.

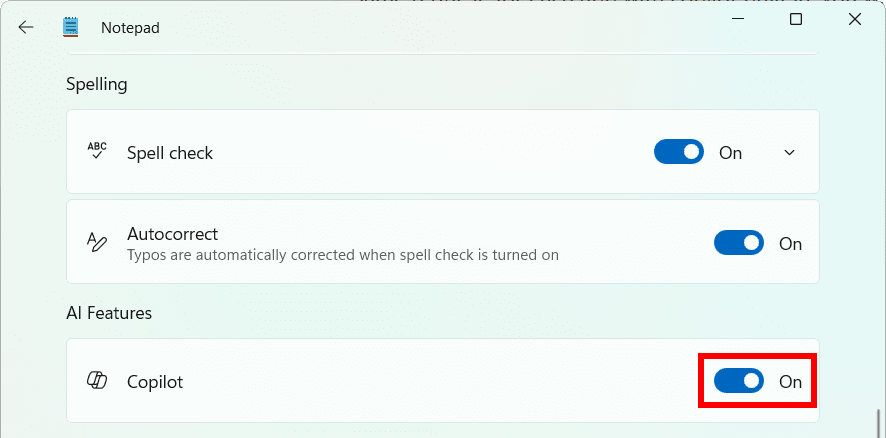

Jeśli używasz aplikacji, które mają wbudowany Copilot, będziesz musiał wyłączyć go oddzielnie w każdej aplikacji. Na przykład w Notatniku przejdź do Ustawienia → Funkcje AI i wyłącz Copilot.

- Uruchom ponownie komputer, aby zmiany weszły w życie.

Jak wyłączyć funkcje danych i personalizacji w aplikacji webowej Copilot

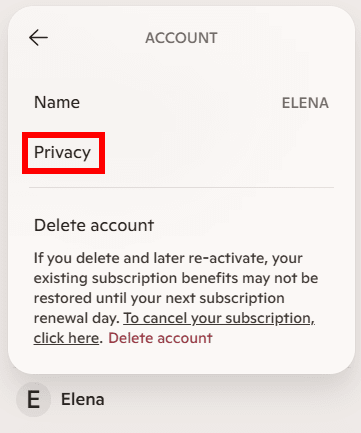

- Wybierz nazwę swojego profilu lub zdjęcie → Twoje konto → Prywatność.

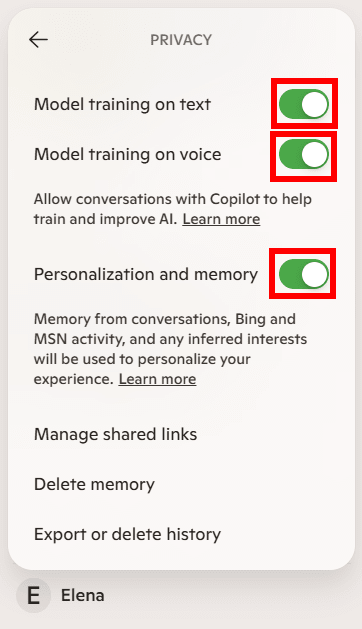

- Wyłącz następujące opcje:

- Trenowanie modelu na tekście

- Trenowanie modelu na głosie

- Personalizacja i pamięć

- Wybierz Usuń pamięć, aby natychmiast usunąć to, co Copilot pamięta o Tobie.

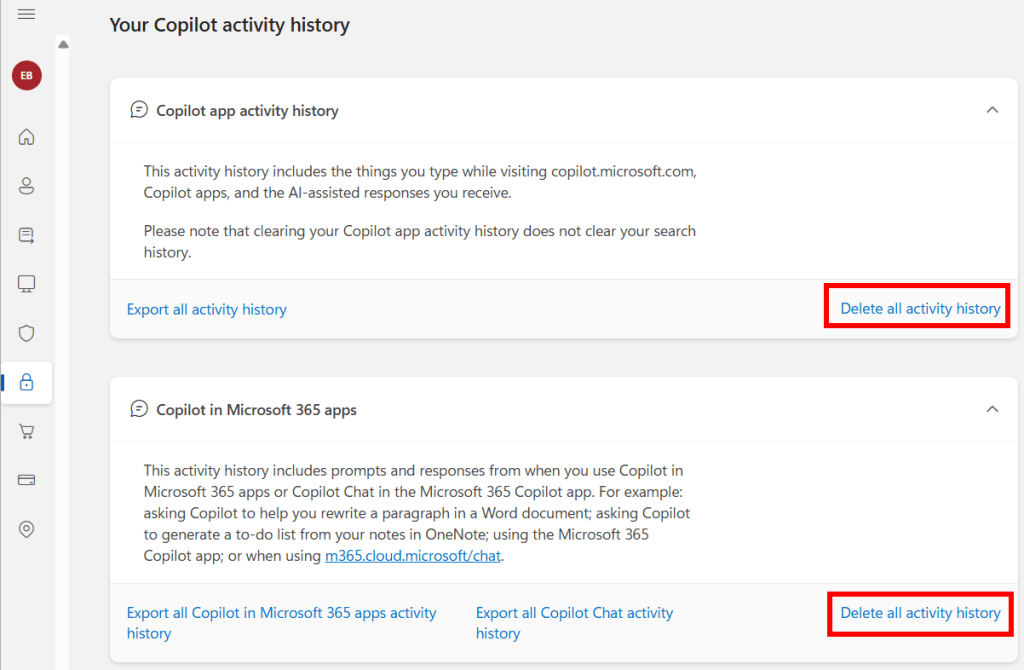

- Kliknij Eksportuj lub usuń historię. Otworzy to stronę przeglądarki, gdzie będziesz musiał zalogować się za pomocą konta Microsoft, którego używasz do Copilot.

- Wybierz Usuń całą historię aktywności dla każdej z tych kategorii:

- Historia aktywności aplikacji Copilot

- Copilot w aplikacjach Microsoft 365

- Copilot w aplikacjach Windows

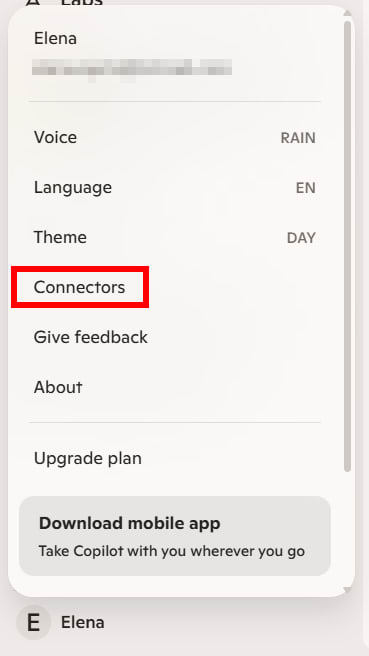

- Wybierz nazwę swojego profilu lub zdjęcie → Łączniki (Connectors).

- Wyłącz wszystko, w tym OneDrive, Outlook, Gmail, Dysk Google i Kalendarz Google.

Pamiętaj, że jeśli Twoje dane zostały już wykorzystane do trenowania modelu, nie ma sposobu, aby to cofnąć.

Jak wyłączyć trenowanie modelu Gaming Copilot

- W systemie Windows naciśnij Win + G, aby otworzyć Game Bar.

- Przejdź do Ustawienia → Ustawienia prywatności → Gaming Copilot.

- Wyłącz Trenowanie modelu na tekście.

- Aby ukryć widżet Gaming Copilot, usuń go z listy widżetów Game Bar.

Obecnie nie ma sposobu na całkowite usunięcie Gaming Copilot z Xbox Game Bar. Ponadto nie możesz zapobiec wykorzystywaniu Twoich interakcji głosowych do pomocy w trenowaniu jego modeli AI. Jeśli zależy Ci na prywatności, najbezpieczniej jest w ogóle nie wchodzić w interakcje z Gaming Copilot.

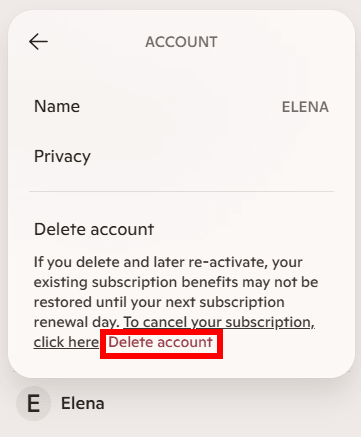

Jak usunąć swoje konto Copilot

W aplikacji webowej Copilot wybierz nazwę swojego profilu lub zdjęcie → Twoje konto → Usuń konto.

Usunięcie konta Copilot nie usuwa Twojego konta Microsoft i nadal możesz korzystać z Copilot bez logowania.

Jeśli wolisz w ogóle nie polegać na Copilot, rozważ przejście na prywatnego asystenta AI(nowe okno), który nigdy nie loguje Twoich danych, nie wykorzystuje ich do trenowania modelu ani nie udostępnia ich stronom trzecim.

Czym jest Microsoft Copilot?

Copilot to linia asystentów AI Microsoftu zintegrowana z jego produktami i usługami, takimi jak Word, Excel, PowerPoint, Outlook, Teams i Windows. Wykorzystuje duże modele językowe (LLM) oparte na własnych technologiach AI Microsoftu i GPT od OpenAI — takich jak GPT-4o, ten sam, który napędza ChatGPT.

Podobnie jak LLM, Copilot może pomóc Ci być bardziej produktywnym, kreatywnym i wydajnym, rozumiejąc monity w języku naturalnym, analizując dane, generując i podsumowując treści oraz dostarczając sugestie oparte na kontekście.

Microsoft udostępnia Copilot w kilku wersjach, w zależności od tego, czy używasz go osobiście, czy zawodowo, w tym:

- Microsoft Copilot — darmowy osobisty asystent AI do codziennych zadań. Jest dostępny jako aplikacja Windows 11 (zainstalowana domyślnie), aplikacja webowa i aplikacja macOS.

- Gaming Copilot — darmowy osobisty asystent AI do gier na Windows, który wykonuje zrzuty ekranu, aby zrozumieć, co dzieje się w grze, i oferować wskazówki, podobnie jak Recall robi zrzuty aktywności na pulpicie.

- Microsoft 365 Copilot — integruje się z Word, Excel, PowerPoint, Outlook i Teams, aby wykorzystywać Twoje dane za pośrednictwem Microsoft Graph, platformy, która łączy Twoje dane, takie jak e-maile, kalendarz i dokumenty.

Jakie są zagrożenia dla prywatności związane z Microsoft Copilot?

Microsoft utrzymuje silne zabezpieczenia prywatności dla Copilot w ustawieniach korporacyjnych, takich jak Microsoft 365, ale konta konsumenckie stoją w obliczu zupełnie innej rzeczywistości(nowe okno):

Twoje dane mogą być wykorzystywane do reklam i profilowania

Usługi Copilot w konsumenckich kontach Microsoft są połączone z ekosystemem reklamowym Microsoftu. Oznacza to, że Twoje interakcje mogą wpływać na reklamy i rekomendacje, które widzisz. Na przykład, jeśli zapytasz Copilot o oferty turystyczne, możesz później zobaczyć reklamy lotów lub hoteli.

Chociaż możesz wyłączyć spersonalizowane reklamy w ustawieniach prywatności konta Microsoft, firma nadal przechowuje te dane interakcji i może wykorzystywać je w zanonimizowanej formie do innych celów, takich jak ulepszanie targetowania reklam dla innych użytkowników Copilot o profilach podobnych do Twojego.

Zachowujesz własność, ale Microsoft nadal może wykorzystywać Twoje dane

Chociaż Microsoft twierdzi, że zachowujesz własność swoich treści, korzystanie z Copilot oznacza, że przyznajesz firmie szerokie prawa do nich, w tym do „kopiowania, dystrybuowania, przesyłania, publicznego wyświetlania, publicznego wykonywania, edytowania, tłumaczenia i reformatowania” Twoich danych oraz do przekazywania tych praw stronom trzecim.

Na przykład, jeśli jesteś pisarzem, który dodaje fragmenty niepublikowanej historii do Copilot, aby poprosić o korektę lub opinię stylistyczną, ten tekst technicznie staje się częścią materiału, który Microsoft ma prawo przetwarzać i wykorzystywać zgodnie z warunkami usługi. Twoja nieopublikowana własność intelektualna może być nadal wykorzystywana poza Twoją bezpośrednią kontrolą, nawet jeśli nigdy nie stanie się publiczna.

Twoje dane mogą być przetwarzane i wykorzystywane do trenowania AI

Dane z Twoich monitów i odpowiedzi Copilot mogą być zbierane, logowane i analizowane przez Microsoft w celu trenowania AI. Nie ma gwarancji, że Twoje wrażliwe lub osobiste dane zostaną wykluczone ze zbiorów treningowych.

Podobnie jak w przypadku większości asystentów AI, Copilot potrzebuje ogromnych ilości informacji, aby się uczyć i ulepszać swoje odpowiedzi — nawet jeśli proces ten wkracza w szarą strefę własności intelektualnej. Aktualnym przykładem jest seria pozwów w USA(nowe okno) złożonych przez autorów i główne serwisy informacyjne, którzy twierdzą, że Microsoft i jego partner OpenAI wykorzystali ich dzieła chronione prawem autorskim bez pozwolenia do trenowania modeli AI, takich jak Copilot i ChatGPT. OpenAI samo publicznie przyznało(nowe okno), że „niemożliwe jest trenowanie dzisiejszych wiodących systemów AI bez użycia materiałów chronionych prawem autorskim”.

Ludzie mogą zobaczyć Twoje wrażliwe dane

Pracownicy Microsoftu mogą przeglądać Twoje dane wejściowe i wyjściowe w usłudze Copilot — w tym wszystko, co wpiszesz lub prześlesz jako załączniki plików — w celu ulepszania usługi, moderowania szkodliwych treści lub gdy zdecydujesz się przesłać opinię. Jeśli ta myśl sprawia, że czujesz się niekomfortowo, unikaj wprowadzania jakichkolwiek wrażliwych informacji, takich jak dane umożliwiające identyfikację osoby lub tajemnice handlowe.

Łączniki (Connectors) ujawniają Twoje dane stronom trzecim

Łączniki (Connectors) pozwalają usłudze Copilot łączyć się z produktami Microsoftu (takimi jak OneDrive lub Outlook) oraz usługami stron trzecich (takimi jak Google Drive), dzięki czemu może ona pobierać informacje z wielu źródeł. Na przykład, jeśli poprosisz Copilota o podsumowanie wszystkich notatek ze spotkań przechowywanych na Google Drive, przeszuka on pliki na Twoim dysku i zwróci podsumowanie.

Ale kiedy włączysz łącznik, pozwalasz również usłudze Copilot na wymianę informacji z tą inną usługą. W przypadku Google Drive, podczas gdy Copilot uzyskuje dostęp do struktury plików na Twoim dysku, nazw, sygnatur czasowych i treści, Google również otrzymuje pewne szczegóły powiązane z Twoim kontem Microsoft, takie jak zdjęcie profilowe, nazwa czy adres e-mail. Twoje cenne dane żyją teraz w obu ekosystemach (Microsoft i Google), tworząc wyraźniejszy, pełniejszy profil Twojej osoby na różnych platformach.

Twoje dane mogą przekraczać granice pod jurysdykcją USA

W zależności od miejsca zamieszkania, Microsoft może przechowywać Twoje dane i interakcje z Copilotem w Twoim regionie. Na przykład Europejczycy mogą mieć swoje dane przechowywane w UE. Ale Twoje dane nie zawsze tam pozostaną. Pomimo zobowiązań firmy dotyczących granicy danych UE(nowe okno), pewne przetwarzanie może nadal odbywać się poza Twoim regionem ze względów technicznych lub wydajnościowych. A ponieważ Microsoft jest firmą z USA, podlega prawu amerykańskiemu, takiemu jak CLOUD Act, co oznacza, że władze USA mogą zażądać dostępu do Twoich danych (niezależnie od tego, gdzie są przechowywane), czasami bez konieczności posiadania nakazu.

Microsoft ściśle monitoruje dane z czatu Copilot

Microsoft analizuje interakcje z Copilotem na dużą skalę, aby zrozumieć, jak ludzie korzystają z asystenta w czasie. W raporcie Copilot Usage Report 2025(nowe okno), badacze AI przyjrzeli się 37,5 miliona wątków Copilot, aby zidentyfikować wzorce użytkowania, zauważając, że więcej raportów zostanie opublikowanych w miarę dostępności kolejnych danych. Microsoft nie jest jedyną firmą, która to robi, ponieważ jej partner OpenAI również publikuje dane o użytkowaniu konsumenckim(nowe okno) dla ChatGPT.

Microsoft twierdzi, że te dane zostały pozbawione elementów identyfikacyjnych i zredukowane do ogólnych podsumowań, ale to nie usuwa całkowicie ryzyka dla prywatności. Badania(nowe okno) wielokrotnie pokazały, że rzekomo anonimowe dane często można ponownie zidentyfikować po połączeniu z innymi elementami, takimi jak sygnatury czasowe, charakterystyka urządzenia czy sygnały lokalizacji. A ponieważ Copilot jest powiązany z ekosystemem opartym na kontach, obejmującym Windows, Microsoft 365, Bing, Edge i usługi reklamowe, te połączenia między usługami z czasem ułatwiają ponowne powiązanie danych.

Dodatkowo nie jest jasne, jak długo oryginalne, możliwe do zidentyfikowania dane wątków Copilot pozostają przechowywane przed anonimizacją, ani jak są chronione. Jeśli surowe dane znajdują się na serwerach Microsoftu, mogą być narażone na ryzyka, takie jak nieautoryzowany dostęp, zagrożenia wewnętrzne lub naruszenia danych.

Jakie są zagrożenia bezpieczeństwa związane z Microsoft Copilot?

Ponieważ Microsoft może uzyskać dostęp średnio do trzech milionów rekordów wrażliwych danych(nowe okno) dla każdej organizacji, ważne jest zrozumienie zagrożeń bezpieczeństwa, jakie może to wprowadzić, zwłaszcza jeśli planujesz używać go w swojej firmie:

- W czerwcu 2025 r. badacze odkryli EchoLeak (CVE-2025-32711(nowe okno)), podatność typu zero-click w Microsoft 365 Copilot, która pozwalała atakującym kraść dane bez żadnej akcji ze strony użytkownika. Ukrywając złośliwe instrukcje i linki wewnątrz normalnej wiadomości e-mail, atakujący mogli oszukać Copilota, aby wykonał te polecenia, uzyskał dostęp do tych linków i wysłał części danych użytkownika na zewnętrzny serwer. Podatność została załatana, ale jest to przykład na to, jak integracja asystentów AI, takich jak Copilot, z kluczowymi systemami — i dawanie im szerokiego dostępu do wiadomości e-mail, dokumentów i danych wewnętrznych — może zmienić ich w zagrożenie wewnętrzne, jeśli zostaną zmanipulowane lub źle skonfigurowane.

- W sierpniu 2024 r. firma ds. cyberbezpieczeństwa(nowe okno) odkryła krytyczną lukę ujawniającą informacje w Microsoft Copilot Studio, która pozwalała niestandardowym copilotom na wykorzystanie słabych zabezpieczeń i uzyskanie wrażliwych informacji (takich jak tokeny usług i klucze bazy danych) w celu dalszego przemieszczania się wewnątrz systemu wewnętrznego. Microsoft załatał ten problem.

- W październiku 2025 r. badacze bezpieczeństwa(nowe okno) odkryli technikę phishingu o nazwie CoPhish, która wykorzystuje Microsoft Copilot Studio, aby złośliwe strony logowania wyglądały na całkowicie legalne. Atakujący mogą stworzyć agenta Copilot Studio, którego przycisk logowania przekierowuje ofiary na fałszywą stronę zgody OAuth, a następnie udostępnić link do agenta (hostowany na zaufanej domenie Microsoft), aby zwabić użytkowników do przyznania dostępu. Po wyrażeniu zgody atakujący może uzyskać tokeny, które pozwalają mu czytać, zapisywać lub wysyłać dane, takie jak wiadomości e-mail, czaty, kalendarze i notatki. Microsoft wciąż pracuje nad tym problemem.

Prywatna alternatywa dla Copilot i Microsoftu

Jeśli niepokoi Cię, jak głęboko Copilot jest zintegrowany z systemem Windows i jak dużo danych Microsoft zbiera za pośrednictwem swoich usług AI — ale nadal chcesz wygody, jaką daje chatbot AI — przełącz się na Lumo, naszego prywatnego asystenta AI(nowe okno). Lumo ma siedzibę w Europie i nigdy nie zbiera ani nie trenuje na Twoich danych, nie pokazuje Ci reklam, nie trzyma logów ani nie udostępnia Twoich informacji nikomu.

A jeśli jesteś gotowy całkowicie wyjść z ekosystemu Microsoftu, możesz zbudować własną prywatną cyfrową przestrzeń roboczą dzięki naszemu zaszyfrowanemu ekosystemowi. Możesz użyć:

- Proton Mail i Calendar dla bezpiecznej, bezpłatnej poczty e-mail i prywatnego planowania

- Proton Pass do bezpiecznego zarządzania hasłami

- Proton Drive dla zaszyfrowanej przestrzeni dyskowej w chmurze i udostępniania plików

- Proton VPN do ochrony Twojego ruchu sieciowego(nowe okno)

Każda usługa Proton jest zbudowana tak, aby domyślnie chronić Twoją prywatność, używając szyfrowania end-to-end, dzięki czemu nikt poza Tobą nie ma dostępu do Twoich danych — nawet my.