Поскольку поддержка Windows 10 официально заканчивается в октябре 2025 года, многие пользователи улучшают систему до Windows 11, чтобы оставаться защищенными обновлениями безопасности. Однако некоторые могут удивиться, обнаружив, что их ждет новый ИИ-компаньон: Copilot.

Позиционируемый как самая амбициозная попытка Microsoft в области генеративного ИИ, Copilot теперь глубоко интегрирован в Windows 11, Edge, Bing и пакет Microsoft 365. Это центральный элемент многомиллиардного партнерства Microsoft с OpenAI (создателем ChatGPT и ChatGPT Atlas), чьи модели GPT обеспечивают интеллект Copilot. В сочетании с запуском ПК Copilot+, оснащенных специальной клавишей Copilot, все это показывает, насколько серьезно Microsoft относится к направлению Windows в будущее на базе ИИ.

Однако не все приветствуют этого всегда присутствующего помощника, напоминающего Скрепыша, но гораздо более настойчивого. Тесная интеграция Copilot вызывает опасения по поводу конфиденциальности и безопасности, подобно тому как принадлежащая Microsoft LinkedIn начала обучать ИИ, используя публичные профили и данные об активности, или когда Google планировал глубоко встроить своего ИИ-ассистента Gemini в Android, чтобы заменить Google Ассистента.

Только корпоративные пользователи Microsoft 365 и ИТ-администраторы могут полностью удалить Copilot из Windows 11. Во всех остальных случаях — например, пользователи с личными или семейными подписками, или вообще без подписки Microsoft 365 — есть способы только ограничить его функции и уменьшить его видимость.

- Как отключить ИИ Copilot

- Как удалить Microsoft 365 Copilot (корпоративная подписка)

- Как отключить Microsoft 365 Copilot (личная или семейная подписка)

- Как скрыть значки Copilot в Windows 11

- Как отключить данные и функции персонализации в веб-приложении Copilot

- Как отключить обучение модели Gaming Copilot

- Как удалить ваш аккаунт Copilot

- Что такое Microsoft Copilot?

- Каковы риски для конфиденциальности Microsoft Copilot?

- Каковы риски безопасности Microsoft Copilot?

- Конфиденциальная альтернатива Copilot и Microsoft

Как отключить ИИ Copilot

В зависимости от того, как вы используете Copilot, вот как вы можете удалить его с вашего компьютера, изменить его настройки или уменьшить его присутствие:

Как удалить Microsoft 365 Copilot (корпоративная подписка)

Если вы корпоративный пользователь, перейдите в Настройки → Приложения → Установленные приложения, выберите Copilot и нажмите Удалить.

ИТ-администраторы могут удалить приложение Copilot, используя следующую команду в PowerShell:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Как отключить Microsoft 365 Copilot (личная или семейная подписка)

- Откройте любое приложение Microsoft 365 (Word, Excel, PowerPoint или OneNote).

- Перейдите в Файл → Параметры → Copilot.

- Снимите флажок Включить Copilot.

Повторите эти шаги для каждого приложения Microsoft, в котором вы хотите отключить Copilot.

Если настройки «Включить Copilot» нет ни в одном из приложений Microsoft:

- Откройте Word, Excel, PowerPoint или OneNote.

- Перейдите в Файл → Учетная запись → Конфиденциальность учетной записи → Управление параметрами → Подключаемые возможности.

- Снимите флажок Включить возможности, анализирующие содержимое.

- Перезапустите приложение.

Вам нужно сделать это только один раз, так как новая настройка конфиденциальности автоматически применится ко всем приложениям Microsoft 365, связанным с вашим аккаунтом.

Как скрыть значки Copilot в Windows 11

Вы можете отключить значки Copilot в Windows, но вы не можете полностью удалить функцию с вашего компьютера. Эти шаги отключают только визуальные элементы и элементы персонализации Copilot, поэтому вы все равно сможете получить доступ к приложению.

Чтобы скрыть кнопку Copilot на панели задач:

- Перейдите в Настройки → Персонализация → Панель задач.

- Найдите и выключите Copilot.

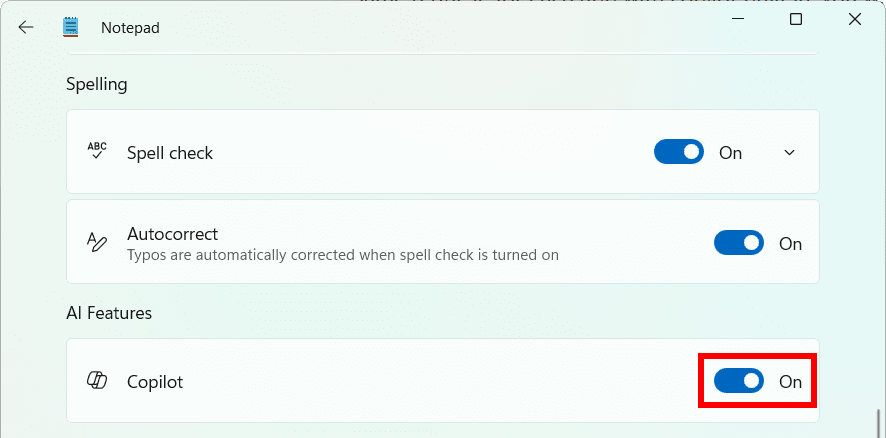

Если вы используете приложения, в которые встроен Copilot, вам нужно будет отключить его отдельно в каждом приложении. Например, в Блокноте перейдите в Настройки → Функции ИИ и выключите Copilot.

- Перезагрузите компьютер, чтобы изменения вступили в силу.

Как отключить данные и функции персонализации в веб-приложении Copilot

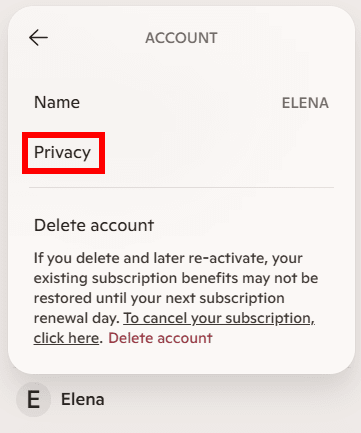

- Выберите имя или фото вашего профиля → ваш аккаунт → Конфиденциальность.

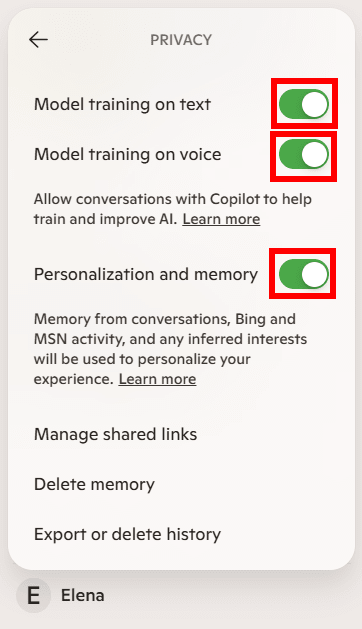

- Выключите следующие опции:

- Обучение модели на тексте

- Обучение модели на голосе

- Персонализация и память

- Выберите Удалить память, чтобы немедленно удалить то, что Copilot помнит о вас.

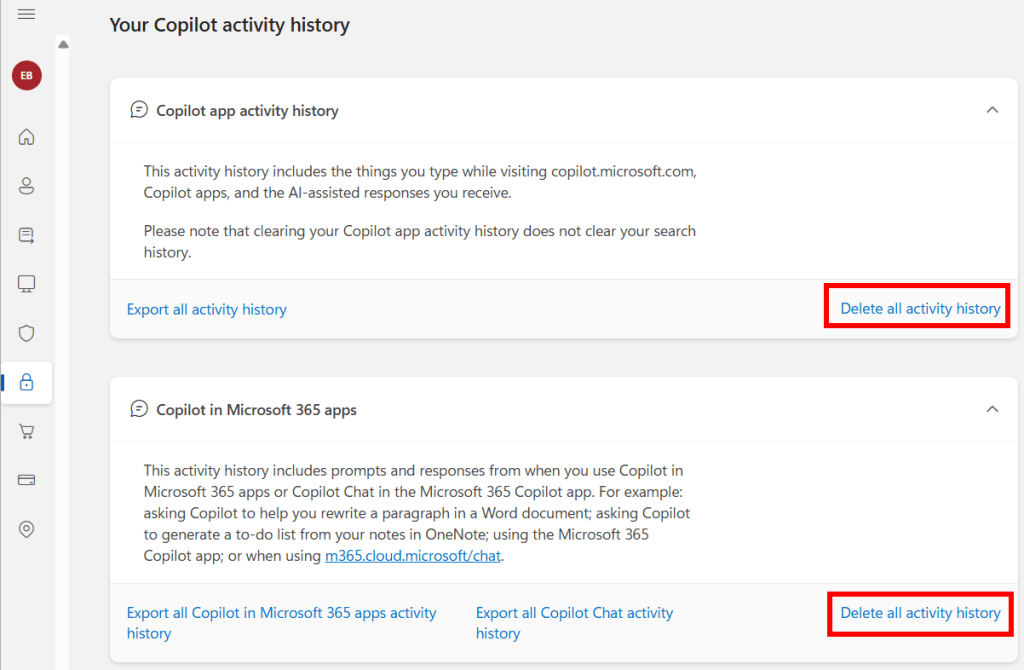

- Нажмите Экспортировать или удалить историю. Это откроет страницу браузера, где вам нужно будет войти с аккаунтом Microsoft, который вы используете для Copilot.

- Выберите Удалить всю историю действий для каждой из этих категорий:

- История активности приложения Copilot

- Copilot в приложениях Microsoft 365

- Copilot в приложениях Windows

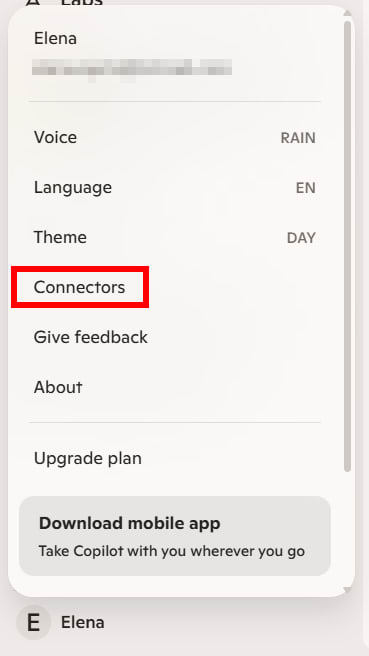

- Выберите имя или фото вашего профиля → Соединители.

- Выключите все, включая OneDrive, Outlook, Gmail, Google Drive и Google Календарь.

Обратите внимание, что если ваши данные уже были использованы для обучения модели, отменить это невозможно.

Как отключить обучение модели Gaming Copilot

- В Windows нажмите Win + G, чтобы открыть Game Bar.

- Перейдите в Настройки → Настройки конфиденциальности → Gaming Copilot.

- Выключите Обучение модели на тексте.

- Чтобы скрыть виджет Gaming Copilot, удалите его из списка виджетов Game Bar.

В настоящее время невозможно полностью удалить Gaming Copilot из Xbox Game Bar. Кроме того, вы не можете запретить ему использовать ваши голосовые взаимодействия для обучения своих моделей ИИ. Если вас заботит конфиденциальность, безопаснее всего вообще не взаимодействовать с Gaming Copilot.

Как удалить ваш аккаунт Copilot

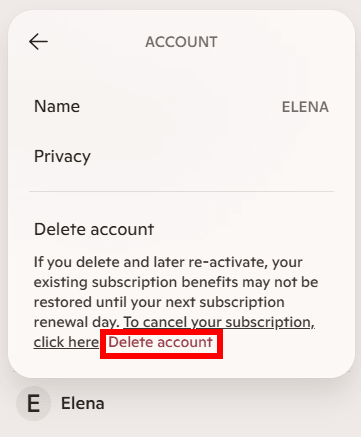

В веб-приложении Copilot выберите имя или фото вашего профиля → ваш аккаунт → Удалить аккаунт.

Удаление вашего аккаунта Copilot не удаляет ваш аккаунт Microsoft, и вы по-прежнему можете использовать Copilot без входа в систему.

Если вы предпочитаете вообще не полагаться на Copilot, рассмотрите возможность перехода на конфиденциального ИИ-ассистента(новое окно), который никогда не ведет журналы ваших данных, не использует их для обучения моделей и не делится ими с третьими лицами.

Что такое Microsoft Copilot?

Copilot — это линейка ИИ-ассистентов Microsoft, интегрированных в ее продукты и сервисы, такие как Word, Excel, PowerPoint, Outlook, Teams и Windows. Он использует большие языковые модели (LLM), основанные на собственных технологиях ИИ Microsoft и GPT от OpenAI — например, GPT-4o, ту же, что и ChatGPT.

Как и LLM, Copilot может помочь вам быть более продуктивным, креативным и эффективным, понимая подсказки на естественном языке, анализируя данные, генерируя и резюмируя контент и предоставляя предложения на основе контекста.

Microsoft предоставляет Copilot в нескольких версиях, в зависимости от того, используете ли вы его лично или профессионально, включая:

- Microsoft Copilot — бесплатный личный ИИ-ассистент для повседневных задач. Он доступен как приложение для Windows 11 (установлено по умолчанию), веб-приложение и приложение для macOS.

- Gaming Copilot — бесплатный личный ИИ-ассистент для игр на Windows, который делает снимки экрана, чтобы понять, что происходит в игре, и предложить советы, подобно тому как Recall делает снимки активности вашего рабочего стола.

- Microsoft 365 Copilot — интегрируется в Word, Excel, PowerPoint, Outlook и Teams для использования ваших данных через Microsoft Graph, платформу, которая соединяет ваши данные, такие как электронные письма, календарь и документы.

Каковы риски для конфиденциальности Microsoft Copilot?

Microsoft поддерживает надежную защиту конфиденциальности для Copilot в корпоративных средах, таких как Microsoft 365, но потребительские аккаунты сталкиваются с совершенно другой реальностью(новое окно):

Ваши данные могут использоваться для рекламы и профилирования

Сервисы Copilot в потребительских аккаунтах Microsoft подключены к рекламной экосистеме Microsoft. Это означает, что ваши взаимодействия могут влиять на рекламу и рекомендации, которые вы видите. Например, если вы спросите Copilot о туристических предложениях, позже вы можете увидеть рекламу авиабилетов или отелей.

Хотя вы можете отключить персонализированную рекламу в настройках конфиденциальности вашего аккаунта Microsoft, компания по-прежнему сохраняет эти данные о взаимодействии и может использовать их в анонимизированной форме для других целей, таких как улучшение таргетинга рекламы для других пользователей Copilot с профилями, похожими на ваш.

Вы сохраняете право собственности, но Microsoft все равно может использовать ваши данные

Хотя Microsoft заявляет, что вы сохраняете право собственности на свой контент, использование Copilot означает, что вы предоставляете компании широкие права на него, в том числе «копировать, распространять, передавать, публично демонстрировать, публично исполнять, изменять, переводить и переформатировать» ваши данные, а также передавать эти права третьим лицам.

Например, если вы писатель, который добавляет отрывки из неопубликованного рассказа в Copilot, чтобы попросить о вычитке или стилистической обратной связи, этот текст технически становится частью материала, который Microsoft имеет лицензию на обработку и использование в соответствии с условиями обслуживания. Ваша невыпущенная интеллектуальная собственность все еще может использоваться вне вашего прямого контроля, даже если она никогда не станет публичной.

Ваши данные могут обрабатываться и использоваться для обучения ИИ

Данные из ваших подсказок и ответов Copilot могут собираться, записываться в журнал и анализироваться Microsoft для обучения ИИ. Нет гарантии, что ваши конфиденциальные или личные данные будут исключены из наборов данных для обучения.

Как и большинству ИИ-ассистентов, Copilot требуются огромные объемы информации для непрерывного обучения и улучшения ответов — даже если этот процесс заходит в серые зоны интеллектуальной собственности. Актуальный пример — серия судебных исков в США(новое окно), поданных авторами и крупными новостными агентствами, которые утверждают, что Microsoft и её партнер OpenAI использовали их защищенные авторским правом работы без разрешения для обучения моделей ИИ, таких как Copilot и ChatGPT. Сама OpenAI публично признала(новое окно), что «невозможно обучать современные ведущие системы ИИ без использования материалов, защищенных авторским правом».

Люди могут увидеть ваши конфиденциальные данные

Сотрудники Microsoft могут просматривать вводимые данные и ответы Copilot — включая всё, что вы печатаете или загружаете как вложения, — для улучшения сервиса, модерации вредоносного контента или когда вы решаете отправить обратную связь. Если эта мысль вызывает у вас дискомфорт, вам следует избегать ввода любой конфиденциальной информации, такой как персональные данные или коммерческие тайны.

Коннекторы открывают доступ к вашим данным третьим сторонам

Коннекторы позволяют Copilot связываться с продуктами Microsoft (такими как OneDrive или Outlook) и сторонними сервисами (такими как Google Drive), чтобы он мог подтягивать информацию из нескольких источников. Например, если вы попросите Copilot обобщить все заметки о встречах, хранящиеся в Google Drive, он будет искать файлы в вашем хранилище и выдаст сводку.

Но когда вы включаете коннектор, вы также разрешаете Copilot обмениваться информацией с этим сторонним сервисом. В случае с Google Drive, хотя Copilot получает доступ к структуре файлов, именам, временным меткам и содержимому вашего хранилища, Google также получает определенную информацию, связанную с вашим аккаунтом Microsoft, такую как фото профиля, имя или адрес электронной почты. Ваши ценные данные теперь живут в обеих экосистемах (Microsoft и Google), создавая более четкий и полный профиль вашей личности на разных платформах.

Ваши данные могут пересекать границы под юрисдикцией США

В зависимости от того, где вы живете, Microsoft может хранить ваши данные Copilot и взаимодействия в вашем регионе. Например, данные европейцев могут храниться в пределах ЕС. Но ваши данные не всегда остаются там. Несмотря на обязательства по границам данных в ЕС(новое окно) компании, некоторая обработка всё же может происходить за пределами вашего региона по техническим причинам или из-за нехватки мощностей. А поскольку Microsoft является компанией из США, она подчиняется законам США, таким как CLOUD Act, что означает, что власти США могут запросить доступ к вашим данным (независимо от того, где они хранятся), иногда даже без ордера.

Microsoft внимательно следит за данными чатов Copilot

Microsoft анализирует взаимодействия с Copilot в больших масштабах, чтобы понять, как люди используют ассистента с течением времени. В отчете об использовании Copilot за 2025 год(новое окно) исследователи ИИ изучили 37,5 миллиона диалогов Copilot для выявления шаблонов использования, отметив, что по мере поступления новых данных будет публиковаться больше отчетов. Microsoft — не единственная компания, которая это делает, так как её партнер OpenAI также публикует данные о потребительском использовании(новое окно) для ChatGPT.

Microsoft утверждает, что эти данные были обезличены и сведены к общим сводкам, но это не устраняет риски для конфиденциальности полностью. Исследования(новое окно) неоднократно показывали, что якобы анонимные данные часто могут быть повторно идентифицированы при объединении с другими сведениями, такими как временные метки, характеристики устройства или сигналы о местоположении. А поскольку Copilot привязан к экосистеме, основанной на аккаунтах, которая охватывает Windows, Microsoft 365, Bing, Edge и рекламные сервисы, эти связи между сервисами упрощают повторную ассоциацию с течением времени.

Кроме того, неясно, как долго исходные, идентифицируемые данные диалогов Copilot остаются сохраненными до обезличивания, и как они защищены. Если необработанные данные находятся на серверах Microsoft, они могут подвергаться таким рискам, как несанкционированный доступ, внутренние угрозы или утечки данных.

Каковы риски безопасности Microsoft Copilot?

Поскольку Microsoft может получить доступ в среднем к трем миллионам записей конфиденциальных данных(новое окно) для каждой организации, важно понимать риски безопасности, которые это может создать, особенно если вы планируете использовать его для своего бизнеса:

- В июне 2025 года исследователи обнаружили EchoLeak (CVE-2025-32711(новое окно)), уязвимость «нулевого клика» в Microsoft 365 Copilot, которая позволяла злоумышленникам красть данные без каких-либо действий пользователя. Скрыв вредоносные инструкции и ссылки внутри обычного электронного письма, злоумышленники могли обманом заставить Copilot выполнить эти команды, перейти по ссылкам и отправить части данных пользователя на внешний сервер. Уязвимость была исправлена, но это пример того, как интеграция ИИ-ассистентов, таких как Copilot, в основные системы — и предоставление им широкого доступа к электронным письмам, документам и внутренним данным — может превратить их во внутренние угрозы в случае манипуляций или неправильной настройки.

- В августе 2024 года фирма по кибербезопасности(новое окно) обнаружила критическую уязвимость раскрытия информации в Microsoft Copilot Studio, которая позволяла пользовательским вторым пилотам эксплуатировать слабые средства защиты и получать конфиденциальную информацию (такую как сервисные токены и ключи баз данных) для дальнейшего продвижения внутри внутренней системы. Microsoft исправила эту проблему.

- В октябре 2025 года исследователи безопасности(новое окно) раскрыли технику фишинга под названием CoPhish, которая злоупотребляет Microsoft Copilot Studio, чтобы заставить вредоносные страницы входа выглядеть полностью легитимными. Злоумышленники могут создать агента Copilot Studio, чья кнопка входа перенаправляет жертв на поддельную страницу согласия OAuth, а затем поделиться ссылкой на агента (размещенной на доверенном домене Microsoft), чтобы заманить пользователей и получить доступ. После получения согласия злоумышленник может получить токены, которые позволяют ему читать, писать или отправлять данные, такие как электронные письма, чаты, календари и заметки. Microsoft всё ещё работает над этой проблемой.

Конфиденциальная альтернатива Copilot и Microsoft

Если вас беспокоит, насколько глубоко Copilot интегрирован в Windows и сколько данных Microsoft собирает через свои ИИ-сервисы, но вы всё же хотите удобства чат-бота с ИИ, переключитесь на Lumo, нашего конфиденциального ИИ-ассистента(новое окно). Размещенный в Европе, Lumo никогда не собирает ваши данные и не обучается на них, не показывает вам рекламу, не ведет журналы и не делится вашей информацией ни с кем.

А если вы готовы полностью выйти за пределы экосистемы Microsoft, вы можете построить свое собственное конфиденциальное цифровое рабочее пространство с нашей зашифрованной экосистемой. Вы можете использовать:

- Proton Mail и Calendar для безопасной бесплатной почты и конфиденциального планирования

- Proton Pass для безопасного управления паролями

- Proton Drive для зашифрованного облачного хранилища и обмена файлами

- Proton VPN для защиты вашего интернет-трафика(новое окно)

Каждый сервис Proton создан для защиты вашей конфиденциальности по умолчанию, используя сквозное шифрование, поэтому никто, кроме вас, не может получить доступ к вашим данным — даже мы.