Med stödet för Windows 10 som officiellt upphör i oktober 2025 uppgraderar många användare till Windows 11 för att förbli skyddade med säkerhetsuppdateringar. Vissa kan dock bli förvånade över att hitta en ny AI-följeslagare som väntar på dem: Copilot.

Positionerad som Microsofts mest ambitiösa satsning på generativ AI är Copilot nu djupt integrerad över Windows 11, Edge, Bing och Microsoft 365-sviten. Det är mittpunkten i Microsofts mångmiljardpartnerskap med OpenAI (skaparen av ChatGPT och ChatGPT Atlas), vars GPT-modeller driver Copilots intelligens. Kombinerat med lanseringen av Copilot+ PCs – utrustade med en dedikerad Copilot-tangent – visar detta precis hur allvarliga Microsoft är med att styra Windows mot en AI-driven framtid.

Men inte alla välkomnar denna ständigt närvarande hjälpare, som påminner om Clippy men är betydligt mer ihärdig. Copilots täta integration väcker integritets- och säkerhetsproblem, precis som när Microsoft-ägda LinkedIn började träna AI med hjälp av offentliga profiler och aktivitetsdata, eller när Googles plan att djupt bädda in sin AI-assistent Gemini i Android för att ersätta Google Assistant.

Endast företagsanvändare av Microsoft 365 och IT-administratörer kan ta bort Copilot helt från Windows 11. I alla andra fall – till exempel användare med personliga prenumerationer eller familjeprenumerationer, eller ingen Microsoft 365-prenumeration alls – finns det bara sätt att begränsa dess funktioner och tona ner dess synlighet.

- Hur man stänger av Copilot AI

- Hur man tar bort Microsoft 365 Copilot (företagsprenumeration)

- Hur man inaktiverar Microsoft 365 Copilot (personlig prenumeration eller familjeprenumeration)

- Hur man döljer Copilot-ikoner i Windows 11

- Hur man inaktiverar data- och personaliseringsfunktioner i Copilot-webbappen

- Hur man inaktiverar modellträning för Gaming Copilot

- Hur du tar bort ditt Copilot-konto

- Vad är Microsoft Copilot?

- Vilka är integritetsriskerna med Microsoft Copilot?

- Vilka är säkerhetsriskerna med Microsoft Copilot?

- Ett privat alternativ till Copilot och Microsoft

Hur man stänger av Copilot AI

Beroende på hur du använder Copilot, så här kan du ta bort det från din dator, justera dess inställningar eller dra tillbaka dess närvaro:

Hur man tar bort Microsoft 365 Copilot (företagsprenumeration)

Om du är en företagsanvändare, gå till Inställningar → Appar → Installerade appar, välj Copilot och klicka på Avinstallera.

IT-administratörer kan ta bort Copilot-appen med följande kommando i PowerShell:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Hur man inaktiverar Microsoft 365 Copilot (personlig prenumeration eller familjeprenumeration)

- Öppna valfri Microsoft 365-app (Word, Excel, PowerPoint eller OneNote).

- Gå till Arkiv → Alternativ → Copilot.

- Rensa kryssrutan Aktivera Copilot.

Upprepa dessa steg för varje Microsoft-app du vill inaktivera Copilot i.

Om inställningen Aktivera Copilot inte finns i någon av Microsofts appar:

- Öppna Word, Excel, PowerPoint eller OneNote.

- Gå till Arkiv → Konto → Kontointegritet → Hantera inställningar → Anslutna upplevelser.

- Rensa kryssrutan Aktivera upplevelser som analyserar ditt innehåll.

- Starta om appen.

Du behöver bara göra detta en gång, eftersom den nya integritetsinställningen automatiskt kommer att tillämpas på alla Microsoft 365-appar som är länkade till ditt konto.

Hur man döljer Copilot-ikoner i Windows 11

Du kan stänga av Copilot-ikoner i Windows, men du kan inte ta bort funktionen helt från din dator. Dessa steg inaktiverar bara Copilots visuella element och personaliseringselement, så du kommer fortfarande att kunna få åtkomst till appen.

För att dölja Copilot-knappen från aktivitetsfältet:

- Gå till Inställningar → Anpassning → Aktivitetsfältet.

- Hitta och stäng av Copilot.

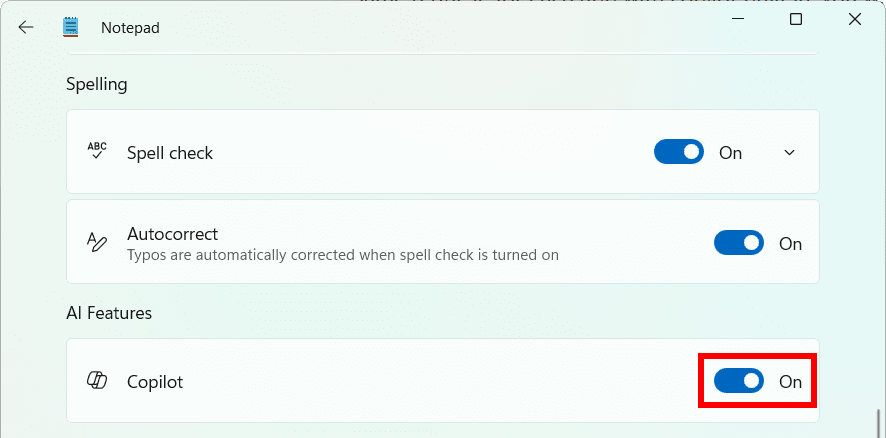

Om du använder appar som har Copilot inbyggt måste du inaktivera det separat i varje app. Till exempel i Anteckningar, gå till Inställningar → AI-funktioner och stäng av Copilot.

- Starta om din dator för att ändringarna ska träda i kraft.

Hur man inaktiverar data- och personaliseringsfunktioner i Copilot-webbappen

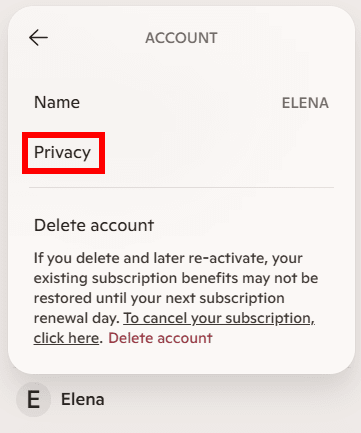

- Välj ditt profilnamn eller foto → ditt konto → Integritet.

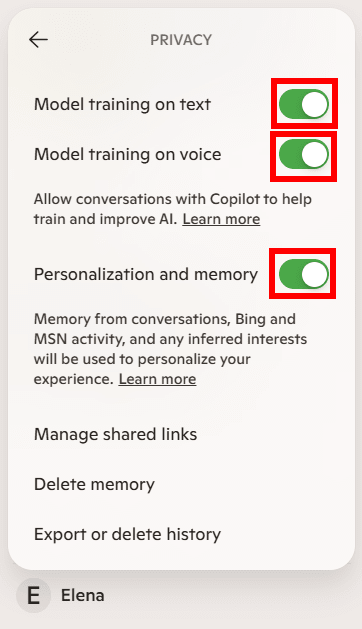

- Stäng av följande alternativ:

- Modellträning på text

- Modellträning på röst

- Personalisering och minne

- Välj Ta bort minne för att omedelbart ta bort vad Copilot kommer ihåg om dig.

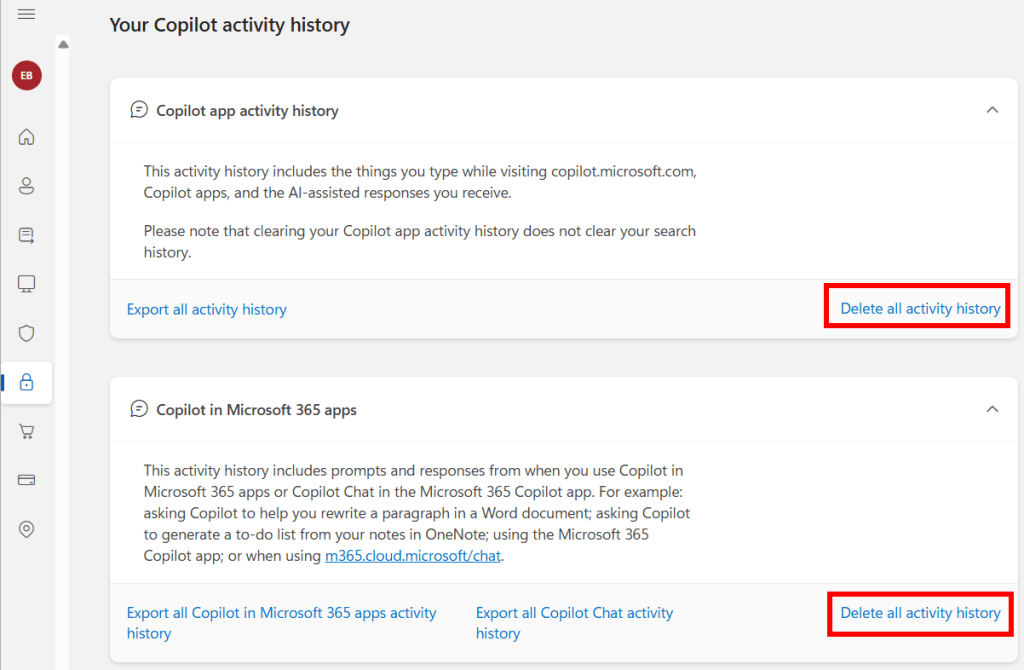

- Klicka på Exportera eller ta bort historik. Detta öppnar en webbläsarsida där du måste logga in med det Microsoft-konto du använder för Copilot.

- Välj Ta bort all aktivitetshistorik för var och en av dessa kategorier:

- Copilot-appens aktivitetshistorik

- Copilot i Microsoft 365-appar

- Copilot i Windows-appar

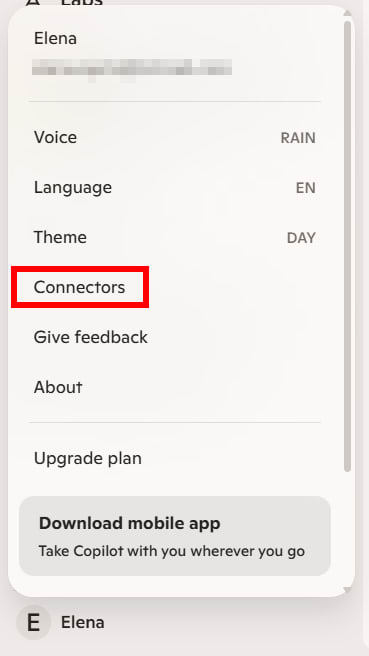

- Välj ditt profilnamn eller foto → Anslutningar.

- Stäng av allt, inklusive OneDrive, Outlook, Gmail, Google Drive och Google Kalender.

Observera att om dina data redan har använts för modellträning finns det inget sätt att ångra det.

Hur man inaktiverar modellträning för Gaming Copilot

- På Windows trycker du på Win + G för att öppna Game Bar.

- Gå till Inställningar → Integritetsinställningar → Gaming Copilot.

- Stäng av Modellträning på text.

- För att dölja Gaming Copilot-widgeten tar du bort den från widgetlistan i Game Bar.

För närvarande finns det inget sätt att helt ta bort Gaming Copilot från Xbox Game Bar. Dessutom kan du inte förhindra att den använder dina röstinteraktioner för att hjälpa till att träna sina AI-modeller. Om du bryr dig om integritet är det säkrast att inte interagera med Gaming Copilot alls.

Hur du tar bort ditt Copilot-konto

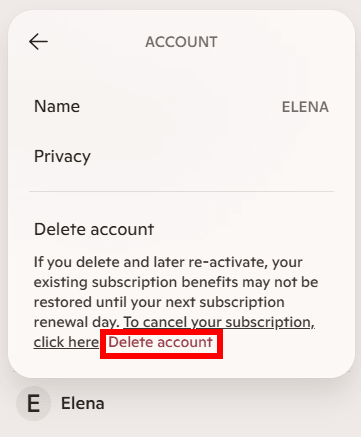

I Copilot-webbappen väljer du ditt profilnamn eller foto → ditt konto → Ta bort konto.

Att ta bort ditt Copilot-konto tar inte bort ditt Microsoft-konto, och du kan fortfarande använda Copilot utan att logga in.

Om du hellre inte vill förlita dig på Copilot alls, överväg att byta till en integritets-AI-assistent(nytt fönster) som aldrig loggar dina data, använder dem för modellträning eller delar dem med tredje part.

Vad är Microsoft Copilot?

Copilot är Microsofts linje av AI-assistenter integrerade över dess produkter och tjänster, såsom Word, Excel, PowerPoint, Outlook, Teams och Windows. Det använder stora språkmodeller (LLM) baserade på Microsofts egna AI-teknologier och OpenAI:s GPT:er – som GPT-4o, samma som driver ChatGPT.

Precis som LLM:er kan Copilot hjälpa dig att bli mer produktiv, kreativ och effektiv genom att förstå naturliga språkuppmaningar, analysera data, generera och sammanfatta innehåll och ge förslag baserat på sammanhang.

Microsoft tillhandahåller Copilot i flera versioner, beroende på om du använder det personligen eller professionellt, inklusive:

- Microsoft Copilot – en gratis personlig AI-assistent för vardagliga uppgifter. Den är tillgänglig som en Windows 11-app (installerad som standard), en webbapp och en macOS-app.

- Gaming Copilot – en gratis personlig AI-assistent för Windows-spel, som tar skärmdumpar för att förstå vad som händer i ett spel och ge tips, liknande hur Recall tar ögonblicksbilder av din skrivbordsaktivitet.

- Microsoft 365 Copilot – integreras i Word, Excel, PowerPoint, Outlook och Teams för att använda dina data via Microsoft Graph, en plattform som ansluter dina data som e-post, kalender och dokument.

Vilka är integritetsriskerna med Microsoft Copilot?

Microsoft upprätthåller starka integritetsskydd för Copilot i företagsinställningar som Microsoft 365, men konsumentkonton står inför en helt annan verklighet(nytt fönster):

Dina data kan användas för annonser och profilering

Copilot-tjänster i Microsoft-konsumentkonton är anslutna till Microsofts annonsekosystem. Detta innebär att dina interaktioner kan påverka annonserna och rekommendationerna du ser. Till exempel, om du frågar Copilot om reseerbjudanden kan du senare se flyg- eller hotellannonser.

Även om du kan stänga av personliga annonser i dina integritetsinställningar för ditt Microsoft-konto, behåller företaget fortfarande den interaktionsdatan och kan använda den i anonymiserad form för andra syften, som att förbättra annonsinriktning för andra Copilot-användare med profiler som liknar din.

Du behåller äganderätten, men Microsoft kan fortfarande använda dina data

Även om Microsoft säger att du behåller äganderätten till ditt innehåll, innebär användning av Copilot att du ger företaget breda rättigheter över det, inklusive att ”kopiera, distribuera, överföra, offentligt visa, offentligt framföra, redigera, översätta och omformatera” dina data, och att överföra dessa rättigheter till tredje part.

Till exempel, om du är en författare som lägger till utdrag från en opublicerad berättelse i Copilot för att be om korrekturläsning eller stilistisk feedback, blir den texten tekniskt sett en del av det material som Microsoft har licens att behandla och använda enligt sina tjänstevillkor. Din outgivna immateriella egendom kan fortfarande användas utanför din direkta kontroll, även om den aldrig blir offentlig.

Dina data kan behandlas och användas för AI-träning

Data från dina Copilot-uppmaningar och svar kan samlas in, loggas och analyseras av Microsoft för AI-träning. Det finns ingen garanti för att dina känsliga eller personliga data kommer att uteslutas från träningsdatauppsättningar.

Precis som de flesta AI-assistenter behöver Copilot stora mängder information för att fortsätta lära sig och förfina sina svar – även när den processen kan glida in i gråzoner för immateriella rättigheter. Ett aktuellt exempel är en serie amerikanska stämningar(nytt fönster) som lämnats in av författare och stora nyhetsmedier som hävdar att Microsoft och deras partner OpenAI använde deras upphovsrättsskyddade verk utan tillstånd för att träna AI-modeller som Copilot och ChatGPT. OpenAI själva har offentligt erkänt(nytt fönster) att det är ”omöjligt att träna dagens ledande AI-system utan att använda upphovsrättsskyddat material.”

Personer kan se dina känsliga data

Microsoft-anställda kan granska dina Copilot-inmatningar och utdata – inklusive allt du skriver eller laddar upp som bilagor – för att förbättra tjänsten, moderera skadligt innehåll eller när du väljer att skicka feedback. Om tanken på detta gör dig obekväm bör du undvika att ange känslig information, såsom personligt identifierbara data eller företagshemligheter.

Anslutningar exponerar dina data för tredje part

Anslutningar låter Copilot kopplas samman med Microsoft-produkter (som OneDrive eller Outlook) och tredjepartstjänster (som Google Drive), så att den kan hämta information från flera källor. Om du till exempel ber Copilot att sammanfatta alla mötesanteckningar som lagras i Google Drive, kommer den att söka igenom dina Drive-filer och returnera en sammanfattning.

Men när du aktiverar en anslutning tillåter du också Copilot att utbyta information med den andra tjänsten. I fallet med Google Drive får Copilot tillgång till din Drives filstruktur, namn, tidsstämplar och innehåll, men Google tar också emot vissa detaljer kopplade till ditt Microsoft-konto, såsom ditt profilfoto, namn eller e-postadress. Dina värdefulla data lever nu i båda ekosystemen (Microsoft och Google), vilket skapar en tydligare och mer komplett profil av dig över plattformarna.

Dina data kan korsa gränser under amerikansk jurisdiktion

Beroende på var du bor kan Microsoft lagra dina Copilot-data och interaktioner i din region. Till exempel kan européer få sina data lagrade inom EU. Men dina data stannar kanske inte alltid där. Trots företagets åtaganden gällande EU-datagränsen(nytt fönster) kan viss behandling fortfarande ske utanför din region på grund av tekniska skäl eller kapacitetsskäl. Och eftersom Microsoft är ett amerikanskt företag omfattas det av amerikanska lagar som CLOUD Act, vilket innebär att amerikanska myndigheter kan begära åtkomst till dina data (oavsett var de lagras), ibland utan att det krävs ett domstolsbeslut.

Microsoft övervakar Copilot-chattdata noga

Microsoft analyserar Copilot-interaktioner i stor skala för att förstå hur människor använder assistenten över tid. I användningsrapporten för Copilot 2025(nytt fönster) tittade AI-forskare på 37,5 miljoner Copilot-konversationer för att identifiera användningsmönster, och noterade att fler rapporter kommer att publiceras i takt med att mer data blir tillgängliga. Microsoft är inte det enda företaget som gör detta, då deras partner OpenAI också publicerar användardata för konsumenter(nytt fönster) för ChatGPT.

Microsoft säger att dessa data avidentifierades och reducerades till sammanfattningar på hög nivå, men det tar inte bort integritetsriskerna helt. Forskning(nytt fönster) har upprepade gånger visat att förment anonyma data ofta kan återidentifieras när de kombineras med andra saker, såsom tidsstämplar, enhetsegenskaper eller platssignaler. Och eftersom Copilot är knutet till ett kontobaserat ekosystem som spänner över Windows, Microsoft 365, Bing, Edge och annonstjänster, gör dessa kopplingar mellan tjänster återkoppling enklare över tid.

Dessutom är det oklart hur länge de ursprungliga, identifierbara Copilot-konversationsdata lagras innan avidentifiering, eller hur de skyddas. Om rådata finns på Microsofts servrar kan de exponeras för risker som obehörig åtkomst, interna hot eller dataintrång.

Vilka är säkerhetsriskerna med Microsoft Copilot?

Eftersom Microsoft kan få åtkomst till i genomsnitt tre miljoner känsliga dataposter(nytt fönster) för varje organisation, är det viktigt att förstå säkerhetsriskerna det kan medföra, särskilt om du planerar att använda det för ditt företag:

- I juni 2025 upptäckte forskare EchoLeak (CVE-2025-32711(nytt fönster)), en zero-click-sårbarhet i Microsoft 365 Copilot som lät angripare stjäla data utan någon åtgärd från användaren. Genom att dölja skadliga instruktioner och länkar i ett vanligt e-postmeddelande kunde angripare lura Copilot att följa dessa kommandon, komma åt länkarna och skicka delar av användarens data till en extern server. Sårbarheten åtgärdades, men det är ett exempel på hur integrering av AI-assistenter som Copilot i kärnsystem – och att ge dem bred tillgång till e-post, dokument och interna data – kan förvandla dem till interna hot om de manipuleras eller felkonfigureras.

- I augusti 2024 upptäckte ett cybersäkerhetsföretag(nytt fönster) en kritisk informationsläckagebrist i Microsoft Copilot Studio, som tillät anpassade copilots att utnyttja svaga skydd och komma över känslig information (som tjänstetokens och databasnycklar) för att röra sig vidare in i ett internt system. Microsoft åtgärdade problemet.

- I oktober 2025 avslöjade säkerhetsforskare(nytt fönster) en nätfisketeknik kallad CoPhish som missbrukar Microsoft Copilot Studio för att få skadliga inloggningssidor att se helt legitima ut. Angripare kan skapa en Copilot Studio-agent vars inloggningsknapp omdirigerar offer till en falsk OAuth-samtyckessida, och sedan dela agentlänken (som hostas på en betrodd Microsoft-domän) för att locka användare att bevilja åtkomst. När samtycke har getts kan angriparen få tokens som låter dem läsa, skriva eller skicka data, såsom e-post, chattar, kalendrar och anteckningar. Microsoft arbetar fortfarande med detta problem.

Ett privat alternativ till Copilot och Microsoft

Om du är orolig över hur djupt Copilot är integrerat i Windows och hur mycket data Microsoft samlar in via sina AI-tjänster – men ändå vill ha bekvämligheten av en AI-chattbot – byt till Lumo, vår privata AI-assistent(nytt fönster). Lumo är baserad i Europa och skördar aldrig eller tränar på dina data, visar dig annonser, sparar loggar eller delar din information med någon.

Och om du är redo att lämna Microsofts ekosystem helt kan du bygga din egen privata digitala arbetsyta med vårt krypterade ekosystem. Du kan använda:

- Proton Mail och Calendar för säker gratis e-post och privat schemaläggning

- Proton Pass för säker lösenordshantering

- Proton Drive för krypterad molnlagring och fildelning

- Proton VPN för att skydda din internettrafik(nytt fönster)

Varje Proton-tjänst är byggd för att skydda din integritet som standard, med end-to-end-kryptering, så att ingen utom du kan få åtkomst till dina data – inte ens vi.