Nu de ondersteuning voor Windows 10 officieel eindigt in oktober 2025, upgraden veel gebruikers naar Windows 11 om beschermd te blijven met beveiligingsupdates. Sommigen zullen echter verrast zijn om een nieuwe AI-metgezel aan te treffen: Copilot.

Gepositioneerd als Microsofts meest ambitieuze inspanning op het gebied van generatieve AI, is Copilot nu diep geïntegreerd in Windows 11, Edge, Bing en de Microsoft 365-suite. Het is het middelpunt van Microsofts miljardenpartnerschap met OpenAI (de maker van ChatGPT en ChatGPT Atlas), wiens GPT-modellen de intelligentie van Copilot aandrijven. In combinatie met de lancering van Copilot+ pc’s — uitgerust met een speciale Copilot-toets — laat dit alles zien hoe serieus Microsoft is om Windows naar een AI-gestuurde toekomst te sturen.

Niet iedereen verwelkomt echter deze altijd aanwezige helper, die doet denken aan Clippy maar veel hardnekkiger is. De nauwe integratie van Copilot roept privacy- en beveiligingszorgen op, net zoals toen het eigendom van Microsoft zijnde LinkedIn AI begon te trainen met openbare profielen en activiteitsgegevens, of toen Google plande om zijn AI-assistent Gemini diep in Android in te sluiten ter vervanging van Google Assistant.

Alleen Microsoft 365 enterprise-gebruikers en IT-beheerders kunnen Copilot volledig verwijderen van Windows 11. In alle andere gevallen — zoals gebruikers met persoonlijke of gezinsabonnementen, of helemaal geen Microsoft 365-abonnement — zijn er alleen manieren om de functies ervan te beperken en de zichtbaarheid ervan te verminderen.

- Hoe Copilot AI uit te schakelen

- Hoe Microsoft 365 Copilot te verwijderen (enterprise-abonnement)

- Hoe Microsoft 365 Copilot uit te schakelen (persoonlijk of gezinsabonnement)

- Hoe Copilot-pictogrammen te verbergen in Windows 11

- Hoe gegevens- en personalisatiefuncties uit te schakelen in de Copilot webapp

- Hoe Gaming Copilot-modeltraining uit te schakelen

- Hoe uw Copilot-account te verwijderen

- Wat is Microsoft Copilot?

- Wat zijn de privacyrisico’s van Microsoft Copilot?

- Wat zijn de beveiligingsrisico’s van Microsoft Copilot?

- Een privéalternatief voor Copilot en Microsoft

Hoe Copilot AI uit te schakelen

Afhankelijk van hoe u Copilot gebruikt, kunt u het als volgt van uw computer verwijderen, de instellingen aanpassen of de aanwezigheid ervan terugschroeven:

Hoe Microsoft 365 Copilot te verwijderen (enterprise-abonnement)

Als u een enterprise-gebruiker bent, ga dan naar Instellingen → Apps → Geïnstalleerde apps, selecteer Copilot en klik op Deïnstalleren.

IT-beheerders kunnen de Copilot-app verwijderen met de volgende opdracht in PowerShell:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Hoe Microsoft 365 Copilot uit te schakelen (persoonlijk of gezinsabonnement)

- Open een Microsoft 365-app (Word, Excel, PowerPoint of OneNote).

- Ga naar Bestand → Opties → Copilot.

- Vink het selectievakje Copilot inschakelen uit.

Herhaal deze stappen voor elke Microsoft-app waarin u Copilot wilt uitschakelen.

Als de instelling Copilot inschakelen niet bestaat in een van de apps van Microsoft:

- Open Word, Excel, PowerPoint of OneNote.

- Ga naar Bestand → Account → Accountprivacy → Instellingen beheren → Verbonden ervaringen.

- Vink het selectievakje Ervaringen inschakelen die uw inhoud analyseren uit.

- Herstart de app.

U hoeft dit maar één keer te doen, aangezien de nieuwe privacyinstelling automatisch wordt toegepast op alle Microsoft 365-apps die aan uw account zijn gekoppeld.

Hoe Copilot-pictogrammen te verbergen in Windows 11

U kunt Copilot-pictogrammen in Windows uitschakelen, maar u kunt de functie niet volledig van uw computer verwijderen. Deze stappen schakelen alleen de visuele en personalisatie-elementen van Copilot uit, dus u hebt nog steeds toegang tot de app.

Om de Copilot-knop van uw taakbalk te verbergen:

- Ga naar Instellingen → Persoonlijke instellingen → Taakbalk.

- Zoek Copilot en schakel dit uit.

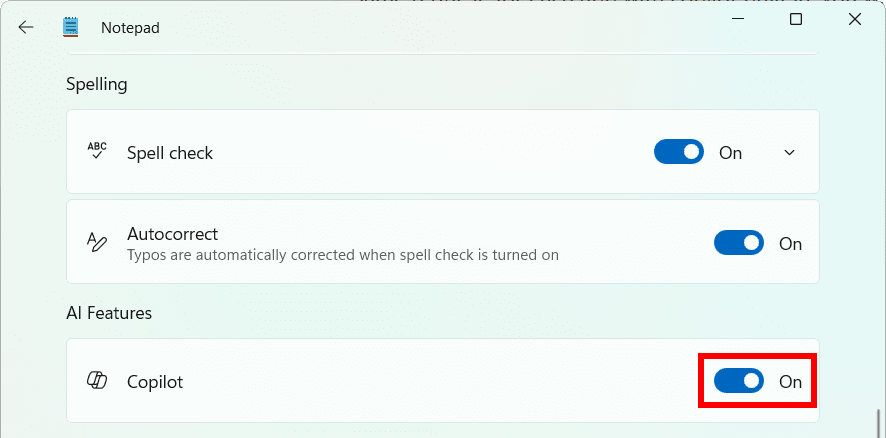

Als u apps gebruikt waarin Copilot is ingebouwd, moet u dit in elke app afzonderlijk uitschakelen. Ga bijvoorbeeld in Kladblok naar Instellingen → AI-functies en schakel Copilot uit.

- Herstart uw computer om de wijzigingen door te voeren.

Hoe gegevens- en personalisatiefuncties uit te schakelen in de Copilot webapp

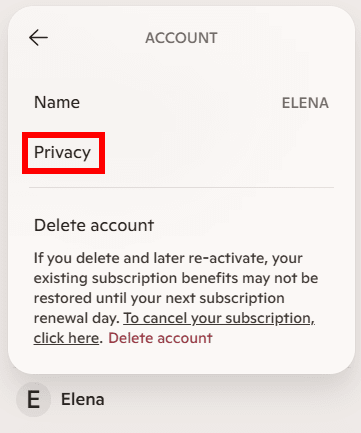

- Selecteer uw profielnaam of foto → uw account → Privacy.

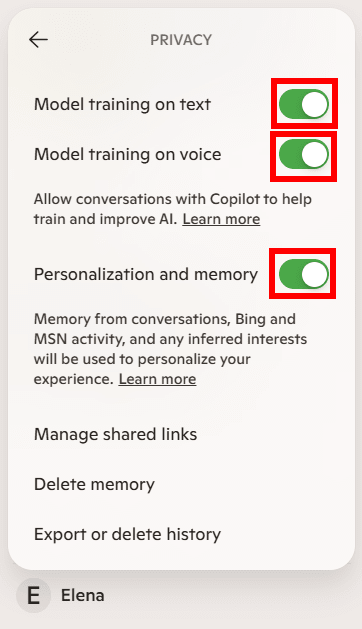

- Schakel de volgende opties uit:

- Modeltraining op tekst

- Modeltraining op stem

- Personalisatie en geheugen

- Selecteer Geheugen verwijderen om direct te verwijderen wat Copilot over u onthoudt.

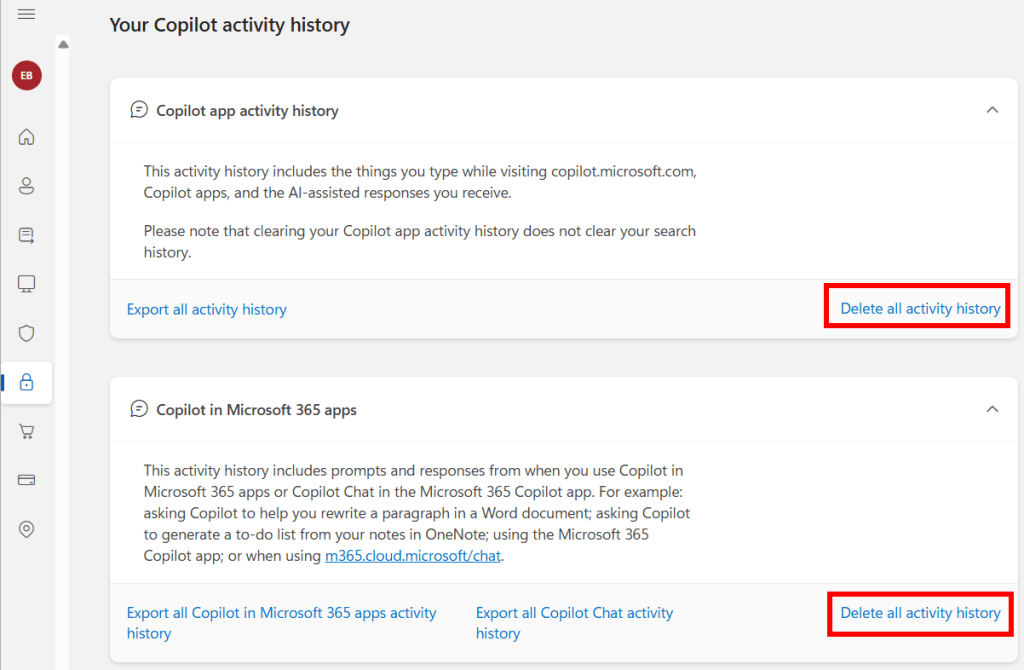

- Klik op Geschiedenis exporteren of verwijderen. Dit opent een browserpagina waar u zich moet aanmelden met het Microsoft-account dat u voor Copilot gebruikt.

- Selecteer Alle activiteitengeschiedenis verwijderen voor elk van deze categorieën:

- Activiteitengeschiedenis van Copilot-app

- Copilot in Microsoft 365-apps

- Copilot in Windows-apps

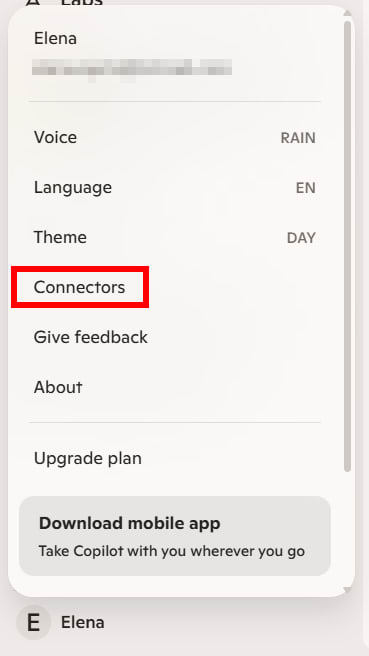

- Selecteer uw profielnaam of foto → Connectors.

- Schakel alles uit, inclusief OneDrive, Outlook, Gmail, Google Drive en Google Agenda.

Merk op dat als uw gegevens al zijn gebruikt voor modeltraining, er geen manier is om dit ongedaan te maken.

Hoe Gaming Copilot-modeltraining uit te schakelen

- Druk in Windows op Win + G om de Game Bar te openen.

- Ga naar Instellingen → Privacyinstellingen → Gaming Copilot.

- Schakel Modeltraining op tekst uit.

- Om de Gaming Copilot-widget te verbergen, verwijdert u deze uit de widgetslijst van de Game Bar.

Momenteel is er geen manier om Gaming Copilot volledig te verwijderen van de Xbox Game Bar. Bovendien kunt u niet voorkomen dat het uw spraakinteracties gebruikt om zijn AI-modellen te trainen. Als u om privacy geeft, is het het veiligst om helemaal niet met Gaming Copilot te communiceren.

Hoe uw Copilot-account te verwijderen

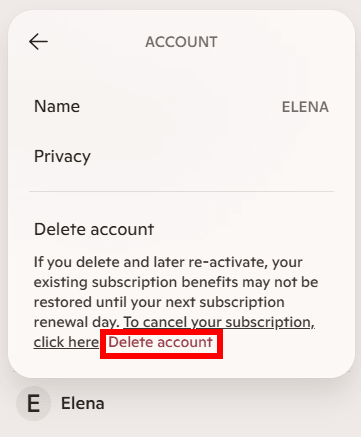

In de Copilot webapp, selecteer uw profielnaam of foto → uw account → Account verwijderen.

Het verwijderen van uw Copilot-account verwijdert niet uw Microsoft-account, en u kunt Copilot nog steeds gebruiken zonder aan te melden.

Als u liever helemaal niet op Copilot vertrouwt, overweeg dan over te stappen naar een privacy AI-assistent(nieuw venster) die uw gegevens nooit logt, gebruikt voor modeltraining of deelt met derden.

Wat is Microsoft Copilot?

Copilot is Microsofts lijn van AI-assistenten die zijn geïntegreerd in zijn producten en diensten, zoals Word, Excel, PowerPoint, Outlook, Teams en Windows. Het gebruikt grote taalmodellen (LLM’s) gebaseerd op Microsofts eigen AI-technologieën en OpenAI’s GPT’s — zoals GPT-4o, hetzelfde model dat ChatGPT aandrijft.

Net als LLM’s kan Copilot u helpen productiever, creatiever en efficiënter te zijn door prompts in natuurlijke taal te begrijpen, gegevens te analyseren, content te genereren en samen te vatten, en suggesties te doen op basis van de context.

Microsoft biedt Copilot in verschillende versies aan, afhankelijk van of u het persoonlijk of professioneel gebruikt, waaronder:

- Microsoft Copilot — een gratis persoonlijke AI-assistent voor alledaagse taken. Het is beschikbaar als een Windows 11-app (standaard geïnstalleerd), een webapp en een macOS-app.

- Gaming Copilot — een gratis persoonlijke AI-assistent voor Windows-gaming, die screenshots maakt om te begrijpen wat er in een game gebeurt en om tips te geven, vergelijkbaar met hoe Recall snapshots maakt van uw desktopactiviteit.

- Microsoft 365 Copilot — integreert in Word, Excel, PowerPoint, Outlook en Teams om uw gegevens te gebruiken via Microsoft Graph, een platform dat uw gegevens zoals e-mails, agenda en documenten verbindt.

Wat zijn de privacyrisico’s van Microsoft Copilot?

Microsoft handhaaft sterke privacybeschermingen voor Copilot in bedrijfsomgevingen zoals Microsoft 365, maar consumentenaccounts worden geconfronteerd met een heel andere realiteit(nieuw venster):

Uw gegevens kunnen worden gebruikt voor advertenties en profilering

Copilot-diensten in consumenten-Microsoft-accounts zijn verbonden met het advertentie-ecosysteem van Microsoft. Dit betekent dat uw interacties de advertenties en aanbevelingen die u ziet, kunnen beïnvloeden. Als u Copilot bijvoorbeeld vraagt naar reisaanbiedingen, ziet u later mogelijk vlucht- of hoteladvertenties.

Hoewel u gepersonaliseerde advertenties kunt uitschakelen in de privacyinstellingen van uw Microsoft-account, bewaart het bedrijf die interactiegegevens nog steeds en kan het deze in geanonimiseerde vorm gebruiken voor andere doeleinden, zoals het verbeteren van advertentietargeting voor andere Copilot-gebruikers met profielen die lijken op het uwe.

U behoudt het eigendom, maar Microsoft kan uw gegevens nog steeds gebruiken

Hoewel Microsoft zegt dat u eigenaar blijft van uw content, betekent het gebruik van Copilot dat u het bedrijf brede rechten daarover verleent, waaronder het recht om uw gegevens te “kopiëren, distribueren, verzenden, openbaar weer te geven, openbaar uit te voeren, te bewerken, te vertalen en opnieuw op te maken”, en om die rechten door te geven aan derden.

Bijvoorbeeld, als u een schrijver bent die fragmenten uit een ongepubliceerd verhaal toevoegt aan Copilot om te vragen om proeflezen of stilistische feedback, wordt die tekst technisch gezien onderdeel van het materiaal dat Microsoft mag verwerken en gebruiken onder zijn servicevoorwaarden. Uw niet-uitgebrachte intellectuele eigendom kan nog steeds worden gebruikt buiten uw directe controle, zelfs als het nooit openbaar wordt.

Uw gegevens kunnen worden verwerkt en gebruikt voor AI-training

Gegevens uit uw Copilot-prompts en -reacties kunnen worden verzameld, gelogd en geanalyseerd door Microsoft voor AI-training. Er is geen garantie dat uw gevoelige of persoonlijke gegevens worden uitgesloten van trainingsdatasets.

Net als de meeste AI-assistenten heeft Copilot enorme hoeveelheden informatie nodig om te blijven leren en zijn antwoorden te verfijnen — zelfs wanneer dat proces in een grijs gebied van intellectueel eigendom belandt. Een actueel voorbeeld is een reeks Amerikaanse rechtszaken(nieuw venster) aangespannen door auteurs en grote nieuwsorganisaties die beweren dat Microsoft en zijn partner OpenAI hun auteursrechtelijk beschermde werken zonder toestemming hebben gebruikt om AI-modellen zoals Copilot en ChatGPT te trainen. OpenAI zelf heeft openlijk erkend(nieuw venster) dat het “onmogelijk is om de toonaangevende AI-systemen van vandaag te trainen zonder gebruik te maken van auteursrechtelijk beschermd materiaal”.

Mensen kunnen uw gevoelige gegevens zien

Medewerkers van Microsoft kunnen uw Copilot-invoer en -uitvoer beoordelen — inclusief alles wat u typt of uploadt als bestandsbijlagen — om de dienst te verbeteren, schadelijke inhoud te modereren of wanneer u ervoor kiest om feedback in te dienen. Als het idee hiervan u ongemakkelijk maakt, moet u vermijden gevoelige informatie in te voeren, zoals persoonlijk identificeerbare gegevens of bedrijfsgeheimen.

Connectors stellen uw gegevens bloot aan derden

Connectors stellen Copilot in staat om te koppelen met Microsoft-producten (zoals OneDrive of Outlook) en diensten van derden (zoals Google Drive), zodat het informatie uit meerdere bronnen kan ophalen. Als u Copilot bijvoorbeeld vraagt om alle vergadernotities die in Google Drive zijn opgeslagen samen te vatten, zoekt het in uw Drive-bestanden en retourneert het een samenvatting.

Maar wanneer u een connector inschakelt, staat u Copilot ook toe informatie uit te wisselen met die andere dienst. In het geval van Google Drive krijgt Copilot toegang tot de bestandsstructuur, namen, tijdstempels en inhoud van uw Drive, maar ontvangt Google ook bepaalde gegevens die aan uw Microsoft-account zijn gekoppeld, zoals uw profielfoto, naam of e-mailadres. Uw waardevolle gegevens bevinden zich nu in beide ecosystemen (Microsoft en Google), waardoor een duidelijker, completer profiel van u over verschillende platforms ontstaat.

Uw gegevens kunnen grenzen overschrijden onder Amerikaanse jurisdictie

Afhankelijk van waar u woont, kan Microsoft uw Copilot-gegevens en interacties in uw regio opslaan. Europeanen kunnen bijvoorbeeld hun gegevens binnen de EU laten opslaan. Maar uw gegevens blijven daar mogelijk niet altijd. Ondanks de EU Data Boundary-toezeggingen(nieuw venster) van het bedrijf, kan er om technische of capaciteitsredenen nog steeds verwerking plaatsvinden buiten uw regio. En omdat Microsoft een Amerikaans bedrijf is, is het onderworpen aan Amerikaanse wetten zoals de CLOUD Act, wat betekent dat Amerikaanse autoriteiten toegang tot uw gegevens kunnen vragen (ongeacht waar deze zijn opgeslagen), soms zonder dat er een bevelschrift nodig is.

Microsoft controleert Copilot-chatgegevens nauwlettend

Microsoft analyseert Copilot-interacties op grote schaal om te begrijpen hoe mensen de assistent in de loop van de tijd gebruiken. In het Copilot Usage Report 2025(nieuw venster) keken AI-onderzoekers naar 37,5 miljoen Copilot-gesprekken om gebruikspatronen te identificeren, waarbij werd opgemerkt dat er meer rapporten zullen worden gepubliceerd naarmate er meer gegevens beschikbaar komen. Microsoft is niet het enige bedrijf dat dit doet, aangezien partner OpenAI ook gegevens over consumentengebruik(nieuw venster) publiceert voor ChatGPT.

Microsoft zegt dat deze gegevens zijn geanonimiseerd en teruggebracht tot samenvattingen op hoog niveau, maar dat neemt de privacyrisico’s niet volledig weg. Onderzoek(nieuw venster) heeft herhaaldelijk aangetoond dat zogenaamd anonieme gegevens vaak opnieuw kunnen worden geïdentificeerd wanneer ze worden gecombineerd met andere zaken, zoals tijdstempels, apparaatkenmerken of locatiesignalen. En omdat Copilot is gekoppeld aan een accountgebaseerd ecosysteem dat Windows, Microsoft 365, Bing, Edge en advertentiediensten omvat, maken die verbindingen tussen diensten herkoppeling in de loop van de tijd eenvoudiger.

Bovendien is het onduidelijk hoe lang de oorspronkelijke, identificeerbare Copilot-gespreksgegevens worden bewaard voordat ze worden geanonimiseerd, of hoe ze worden beschermd. Als onbewerkte gegevens op de servers van Microsoft staan, kunnen ze worden blootgesteld aan risico’s zoals ongeautoriseerde toegang, bedreigingen van binnenuit of datalekken.

Wat zijn de beveiligingsrisico’s van Microsoft Copilot?

Aangezien Microsoft toegang heeft tot gemiddeld drie miljoen gevoelige gegevensrecords(nieuw venster) voor elke organisatie, is het belangrijk om de beveiligingsrisico’s te begrijpen die dit met zich mee kan brengen, vooral als u van plan bent het voor uw bedrijf te gebruiken:

- In juni 2025 ontdekten onderzoekers EchoLeak (CVE-2025-32711(nieuw venster)), een zero-click kwetsbaarheid in Microsoft 365 Copilot waarmee aanvallers gegevens konden stelen zonder enige gebruikersactie. Door kwaadaardige instructies en koppelingen in een normale e-mail te verbergen, konden aanvallers Copilot misleiden om die opdrachten uit te voeren, toegang te krijgen tot die koppelingen en delen van de gegevens van de gebruiker naar een externe server te verzenden. De kwetsbaarheid is gepatcht, maar het is een voorbeeld van hoe de integratie van AI-assistenten zoals Copilot in kernsystemen — en het geven van brede toegang tot e-mails, documenten en interne gegevens — hen kan veranderen in bedreigingen van binnenuit als ze worden gemanipuleerd of verkeerd worden geconfigureerd.

- In augustus 2024 ontdekte een cyberbeveiligingsbedrijf(nieuw venster) een kritiek lek voor openbaarmaking van informatie in Microsoft Copilot Studio, waardoor aangepaste copilots zwakke beveiligingen konden misbruiken en gevoelige informatie (zoals servicetokens en databasesleutels) konden verkrijgen om verder binnen te dringen in een intern systeem. Microsoft heeft het probleem gepatcht.

- In oktober 2025 ontdekten beveiligingsonderzoekers (nieuw venster)een phishingtechniek genaamd CoPhish die Microsoft Copilot Studio misbruikt om kwaadaardige inlogpagina’s er volledig legitiem uit te laten zien. Aanvallers kunnen een Copilot Studio-agent maken wiens Inlogknop slachtoffers omleidt naar een nep OAuth-toestemmingspagina, en vervolgens de agentkoppeling delen (gehost op een vertrouwd Microsoft-domein) om gebruikers te lokken toegang te verlenen. Zodra toestemming is gegeven, kan de aanvaller tokens verkrijgen waarmee ze gegevens kunnen lezen, schrijven of verzenden, zoals e-mails, chats, agenda’s en notities. Microsoft werkt nog aan dit probleem.

Een privé-alternatief voor Copilot en Microsoft

Als u zich ongemakkelijk voelt over hoe diep Copilot is geïntegreerd in Windows en hoeveel gegevens Microsoft verzamelt via zijn AI-diensten — maar toch het gemak van een AI-chatbot wilt — stap dan over naar Lumo, onze privé AI-assistent(nieuw venster). Lumo is gehuisvest in Europa en verzamelt nooit uw gegevens, traint er niet op, toont u geen advertenties, houdt geen logboeken bij en deelt uw informatie met niemand.

En als u klaar bent om volledig uit het Microsoft-ecosysteem te stappen, kunt u uw eigen privé digitale werkruimte bouwen met ons versleutelde ecosysteem. U kunt gebruikmaken van:

- Proton Mail en Agenda voor een veilige gratis e-mail en privé planning

- Proton Pass voor veilig wachtwoordbeheer

- Proton Drive voor versleutelde cloudopslag en het delen van bestanden

- Proton VPN voor het beschermen van uw internetverkeer(nieuw venster)

Elke Proton-dienst is gebouwd om standaard uw privacy te bewaken, met behulp van end-to-end versleuteling, zodat niemand behalve u toegang heeft tot uw gegevens — zelfs wij niet.