Con il supporto per Windows 10 che termina ufficialmente nell’ottobre 2025, molti utenti stanno effettuando l’upgrade a Windows 11 per rimanere protetti con gli aggiornamenti di sicurezza. Alcuni potrebbero essere sorpresi, tuttavia, di trovare un nuovo compagno IA ad attenderli: Copilot.

Posizionato come lo sforzo più ambizioso di Microsoft nell’IA generativa, Copilot è ora profondamente integrato in Windows 11, Edge, Bing e nella suite Microsoft 365. È il fulcro della partnership multimiliardaria di Microsoft con OpenAI (il creatore di ChatGPT e ChatGPT Atlas), i cui modelli GPT alimentano l’intelligenza di Copilot. Combinato con il lancio dei PC Copilot+, dotati di un tasto Copilot dedicato, tutto ciò mostra quanto seriamente Microsoft stia indirizzando Windows verso un futuro basato sull’IA.

Tuttavia, non tutti accolgono con favore questo aiutante sempre presente, che ricorda Clippy ma è molto più persistente. La stretta integrazione di Copilot solleva preoccupazioni per la privacy e la sicurezza, proprio come quando LinkedIn, di proprietà di Microsoft, ha iniziato ad addestrare l’IA utilizzando profili pubblici e dati di attività, o quando Google ha pianificato di incorporare profondamente il suo assistente IA Gemini in Android per sostituire Google Assistant.

Solo gli utenti aziendali di Microsoft 365 e gli amministratori IT possono rimuovere completamente Copilot da Windows 11. In tutti gli altri casi, come per gli utenti con abbonamenti personali o familiari, o nessun abbonamento Microsoft 365, ci sono solo modi per limitare le sue funzionalità e attenuare la sua visibilità.

- Come disattivare l’IA di Copilot

- Come rimuovere Microsoft 365 Copilot (abbonamento aziendale)

- Come disattivare Microsoft 365 Copilot (abbonamento personale o familiare)

- Come nascondere le icone di Copilot in Windows 11

- Come disattivare le funzionalità di dati e personalizzazione nell’app web di Copilot

- Come disattivare l’addestramento del modello di Gaming Copilot

- Come eliminare il tuo account Copilot

- Cos’è Microsoft Copilot?

- Quali sono i rischi per la privacy di Microsoft Copilot?

- Quali sono i rischi per la sicurezza di Microsoft Copilot?

- Un’alternativa privata a Copilot e Microsoft

Come disattivare l’IA di Copilot

A seconda di come utilizzi Copilot, ecco come puoi rimuoverlo dal tuo computer, regolare le sue impostazioni o ridurne la presenza:

Come rimuovere Microsoft 365 Copilot (abbonamento aziendale)

Se sei un utente aziendale, vai su Impostazioni → App → App installate, seleziona Copilot e clicca su Disinstalla.

Gli amministratori IT possono rimuovere l’app Copilot utilizzando il seguente comando in PowerShell:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Come disattivare Microsoft 365 Copilot (abbonamento personale o familiare)

- Apri qualsiasi app di Microsoft 365 (Word, Excel, PowerPoint o OneNote).

- Vai su File → Opzioni → Copilot.

- Deseleziona la casella di controllo Abilita Copilot.

Ripeti questi passaggi per ogni app Microsoft in cui desideri disattivare Copilot.

Se l’impostazione Abilita Copilot non esiste in nessuna delle app Microsoft:

- Apri Word, Excel, PowerPoint o OneNote.

- Vai su File → Account → Privacy account → Gestisci impostazioni → Esperienze connesse.

- Deseleziona la casella di controllo Attiva esperienze che analizzano i contenuti.

- Riavvia l’app.

Devi farlo solo una volta, poiché la nuova impostazione privacy si applicherà automaticamente a tutte le app di Microsoft 365 collegate al tuo account.

Come nascondere le icone di Copilot in Windows 11

Puoi disattivare le icone di Copilot in Windows, ma non puoi rimuovere completamente la funzionalità dal tuo computer. Questi passaggi disattivano solo gli elementi visivi e di personalizzazione di Copilot, quindi sarai ancora in grado di accedere all’app.

Per nascondere il pulsante Copilot dalla barra delle applicazioni:

- Vai su Impostazioni → Personalizzazione → Barra delle applicazioni.

- Trova e disattiva Copilot.

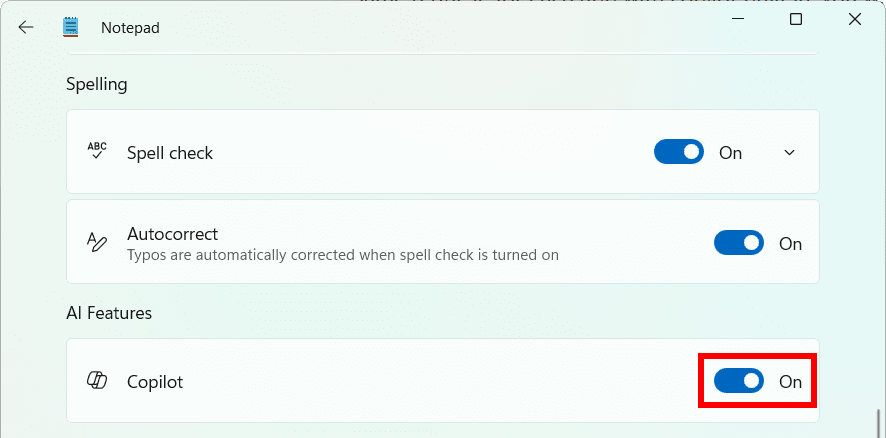

Se utilizzi app che hanno Copilot integrato, dovrai disattivarlo separatamente in ogni app. Ad esempio, nel Blocco note, vai su Impostazioni → Funzionalità IA e disattiva Copilot.

- Riavvia il computer affinché le modifiche abbiano effetto.

Come disattivare le funzionalità di dati e personalizzazione nell’app web di Copilot

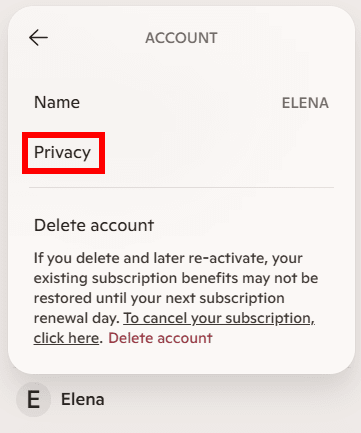

- Seleziona il nome del tuo profilo o la foto → il tuo account → Privacy.

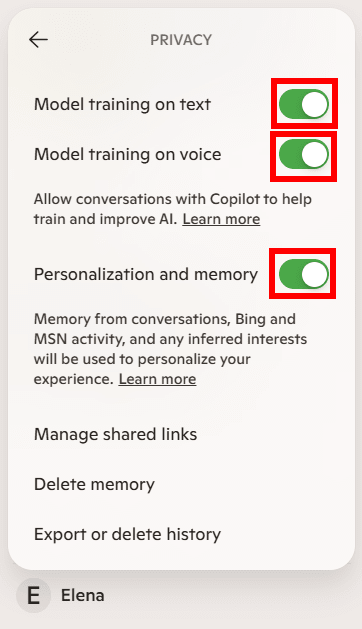

- Disattiva le seguenti opzioni:

- Addestramento del modello sul testo

- Addestramento del modello sulla voce

- Personalizzazione e memoria

- Seleziona Elimina memoria per rimuovere immediatamente ciò che Copilot ricorda di te.

- Clicca su Esporta o elimina cronologia. Questo aprirà una pagina del browser in cui dovrai accedere con l’account Microsoft che usi per Copilot.

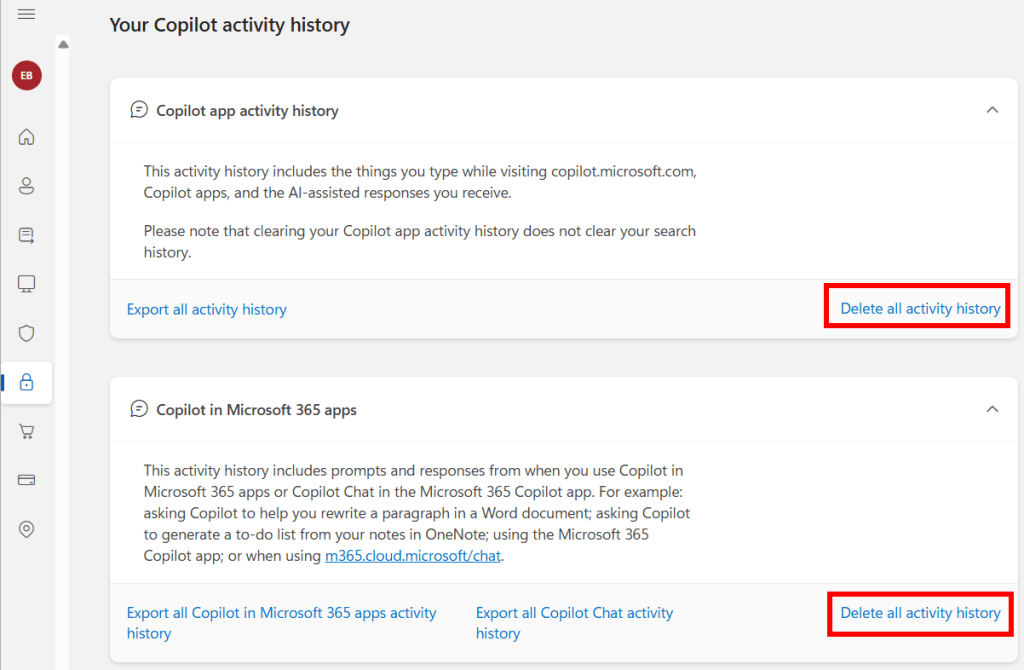

- Seleziona Elimina tutta la cronologia delle attività per ciascuna di queste categorie:

- Cronologia delle attività dell’app Copilot

- Copilot nelle app di Microsoft 365

- Copilot nelle app di Windows

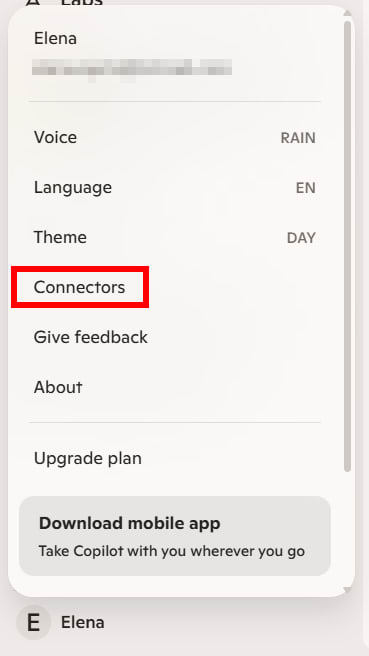

- Seleziona il nome del tuo profilo o la foto → Connettori.

- Disattiva tutto, inclusi OneDrive, Outlook, Gmail, Google Drive e Google Calendar.

Nota che se i tuoi dati sono già stati utilizzati per l’addestramento del modello, non c’è modo di annullare l’operazione.

Come disattivare l’addestramento del modello di Gaming Copilot

- Su Windows, premi Win + G per aprire la Xbox Game Bar.

- Vai su Impostazioni → Impostazioni privacy → Gaming Copilot.

- Disattiva Addestramento del modello sul testo.

- Per nascondere il widget di Gaming Copilot, rimuovilo dall’elenco dei widget della Game Bar.

Al momento, non c’è modo di rimuovere completamente Gaming Copilot dalla Xbox Game Bar. Inoltre, non puoi impedire che utilizzi le tue interazioni vocali per aiutare ad addestrare i suoi modelli di IA. Se tieni alla privacy, è più sicuro non interagire affatto con Gaming Copilot.

Come eliminare il tuo account Copilot

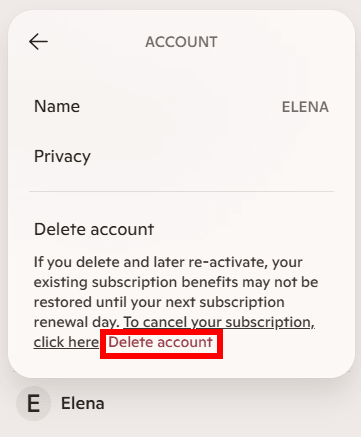

Nell’app web di Copilot, seleziona il nome del tuo profilo o la foto → il tuo account → Elimina account.

Eliminare il tuo account Copilot non elimina il tuo account Microsoft e puoi comunque utilizzare Copilot senza effettuare l’accesso.

Se preferisci non affidarti affatto a Copilot, valuta la possibilità di passare a un assistente IA per la privacy(nuova finestra) che non registra mai i tuoi dati, non li utilizza per l’addestramento del modello e non li condivide con terze parti.

Cos’è Microsoft Copilot?

Copilot è la linea di assistenti IA di Microsoft integrata nei suoi prodotti e servizi, come Word, Excel, PowerPoint, Outlook, Teams e Windows. Utilizza modelli linguistici di grandi dimensioni (LLM) basati sulle tecnologie di IA proprietarie di Microsoft e sui GPT di OpenAI, come GPT-4o, lo stesso che alimenta ChatGPT.

Come gli LLM, Copilot può aiutarti a essere più produttivo, creativo ed efficiente comprendendo i prompt in linguaggio naturale, analizzando i dati, generando e riassumendo contenuti e fornendo suggerimenti basati sul contesto.

Microsoft fornisce Copilot in diverse versioni, a seconda che tu lo stia utilizzando personalmente o professionalmente, tra cui:

- Microsoft Copilot: un assistente IA personale gratuito per le attività quotidiane. È disponibile come app per Windows 11 (installata per impostazione predefinita), app web e app per macOS.

- Gaming Copilot: un assistente IA personale gratuito per il gaming su Windows, che acquisisce screenshot per capire cosa sta succedendo in un gioco e offrire suggerimenti, in modo simile a come Recall acquisisce istantanee della tua attività desktop.

- Microsoft 365 Copilot: si integra in Word, Excel, PowerPoint, Outlook e Teams per utilizzare i tuoi dati tramite Microsoft Graph, una piattaforma che connette i tuoi dati come email, calendario e documenti.

Quali sono i rischi per la privacy di Microsoft Copilot?

Microsoft mantiene forti protezioni per la privacy per Copilot in contesti aziendali come Microsoft 365, ma gli account consumer affrontano una realtà molto diversa(nuova finestra):

I tuoi dati potrebbero essere utilizzati per annunci e profilazione

I servizi Copilot negli account consumer Microsoft sono connessi all’ecosistema pubblicitario di Microsoft. Ciò significa che le tue interazioni possono influenzare gli annunci e i consigli che vedi. Ad esempio, se chiedi a Copilot offerte di viaggio, potresti vedere in seguito annunci di voli o hotel.

Sebbene tu possa disattivare gli annunci personalizzati nelle impostazioni privacy del tuo account Microsoft, l’azienda conserva comunque quei dati di interazione e potrebbe utilizzarli in forma anonima per altri scopi, come migliorare il targeting degli annunci per altri utenti Copilot con profili simili al tuo.

Mantieni la proprietà, ma Microsoft può comunque utilizzare i tuoi dati

Sebbene Microsoft affermi che tu mantieni la proprietà dei tuoi contenuti, l’utilizzo di Copilot implica che concedi all’azienda ampi diritti su di essi, inclusi quelli di “copiare, distribuire, trasmettere, visualizzare pubblicamente, eseguire pubblicamente, modificare, tradurre e riformattare” i tuoi dati e di trasferire tali diritti a terze parti.

Ad esempio, se sei uno scrittore che aggiunge estratti di una storia inedita in Copilot per chiedere una correzione di bozze o un feedback stilistico, quel testo diventa tecnicamente parte del materiale che Microsoft è autorizzata a elaborare e utilizzare secondo i suoi termini di servizio. La tua proprietà intellettuale non rilasciata potrebbe essere ancora utilizzata al di fuori del tuo controllo diretto, anche se non diventa mai pubblica.

I tuoi dati potrebbero essere elaborati e utilizzati per l’addestramento dell’IA

I dati dei tuoi prompt e risposte di Copilot potrebbero essere raccolti, registrati nei log e analizzati da Microsoft per l’addestramento dell’IA. Non c’è garanzia che i tuoi dati sensibili o personali vengano esclusi dai set di dati di addestramento.

Come per la maggior parte degli assistenti IA, Copilot ha bisogno di grandi quantità di informazioni per continuare a imparare e perfezionare le sue risposte — anche quando tale processo può scivolare in zone grigie della proprietà intellettuale. Un esempio attuale è una serie di cause legali negli USA(nuova finestra) intentate da autori e importanti testate giornalistiche che sostengono che Microsoft e il suo partner OpenAI hanno utilizzato le loro opere protette da copyright senza permesso per addestrare modelli di IA come Copilot e ChatGPT. OpenAI stessa ha pubblicamente riconosciuto(nuova finestra) che è “impossibile addestrare i principali sistemi di IA di oggi senza utilizzare materiali protetti da copyright”.

Le persone potrebbero vedere i tuoi dati sensibili

I dipendenti Microsoft potrebbero esaminare i tuoi input e output di Copilot — incluso tutto ciò che digiti o carichi come allegati di file — per migliorare il servizio, moderare contenuti dannosi o quando scegli di inviare feedback. Se il pensiero ti mette a disagio, dovresti evitare di inserire informazioni sensibili, come dati personali identificabili o segreti commerciali.

I connettori espongono i tuoi dati a terze parti

I connettori consentono a Copilot di collegarsi con i prodotti Microsoft (come OneDrive o Outlook) e servizi di terze parti (come Google Drive), in modo da poter estrarre informazioni da più fonti. Ad esempio, se chiedi a Copilot di riassumere tutte le note delle riunioni archiviate in Google Drive, cercherà nei tuoi file di Drive e restituirà un riepilogo.

Ma quando attivi un connettore, consenti anche a Copilot di scambiare informazioni con quell’altro servizio. Nel caso di Google Drive, mentre Copilot ottiene l’accesso alla struttura dei file, ai nomi, ai timestamp e ai contenuti del tuo Drive, Google riceve anche alcuni dettagli associati al tuo account Microsoft, come la tua foto del profilo, il nome o l’indirizzo email. I tuoi dati preziosi ora vivono in entrambi gli ecosistemi (Microsoft e Google), creando un profilo più chiaro e completo di te attraverso le piattaforme.

I tuoi dati potrebbero attraversare i confini sotto la giurisdizione degli USA

A seconda di dove vivi, Microsoft potrebbe archiviare i tuoi dati e le tue interazioni con Copilot nella tua regione. Ad esempio, gli europei potrebbero avere i loro dati archiviati all’interno dell’UE. Ma i tuoi dati potrebbero non rimanere sempre lì. Nonostante gli impegni sui confini dei dati UE(nuova finestra) dell’azienda, alcune elaborazioni potrebbero comunque avvenire al di fuori della tua regione per motivi tecnici o di capacità. E poiché Microsoft è un’azienda statunitense, è soggetta alle leggi degli USA come il CLOUD Act, il che significa che le autorità statunitensi potrebbero richiedere l’accesso ai tuoi dati (indipendentemente da dove sono archiviati), a volte senza richiedere un mandato.

Microsoft monitora attentamente i dati della chat di Copilot

Microsoft analizza le interazioni di Copilot su larga scala per capire come le persone usano l’assistente nel tempo. Nel Copilot Usage Report 2025(nuova finestra), i ricercatori di IA hanno esaminato 37,5 milioni di conversazioni di Copilot per identificare modelli di utilizzo, notando che verranno pubblicati più report man mano che saranno disponibili più dati. Microsoft non è l’unica azienda a farlo, poiché il suo partner OpenAI pubblica anche dati sull’utilizzo dei consumatori(nuova finestra) per ChatGPT.

Microsoft afferma che questi dati sono stati de-identificati e ridotti a riepiloghi di alto livello, ma ciò non rimuove completamente i rischi per la privacy. La ricerca(nuova finestra) ha ripetutamente mostrato che i dati presumibilmente anonimi possono spesso essere ri-identificati se combinati con altre cose, come timestamp, caratteristiche del dispositivo o segnali di posizione. E poiché Copilot è legato a un ecosistema basato su account che abbraccia Windows, Microsoft 365, Bing, Edge e servizi pubblicitari, quelle connessioni tra servizi rendono la ri-associazione più facile nel tempo.

Inoltre, non è chiaro per quanto tempo i dati originali e identificabili delle conversazioni di Copilot rimangano archiviati prima della de-identificazione, o come siano protetti. Se i dati grezzi risiedono sui server di Microsoft, potrebbero essere esposti a rischi come accesso non autorizzato, minacce interne o violazioni dei dati.

Quali sono i rischi di sicurezza di Microsoft Copilot?

Poiché Microsoft può accedere a una media di tre milioni di record di dati sensibili(nuova finestra) per ogni organizzazione, è importante comprendere i rischi di sicurezza che potrebbe introdurre, specialmente se pianifichi di usarlo per la tua azienda:

- A giugno 2025, i ricercatori hanno scoperto EchoLeak (CVE-2025-32711(nuova finestra)), una vulnerabilità zero-click in Microsoft 365 Copilot che permetteva agli aggressori di rubare dati senza alcuna azione dell’utente. Nascondendo istruzioni e link dannosi all’interno di una normale email, gli aggressori potevano ingannare Copilot facendogli seguire quei comandi, accedendo a quei link e inviando parti dei dati dell’utente a un server esterno. La vulnerabilità è stata corretta, ma è un esempio di come l’integrazione di assistenti IA come Copilot nei sistemi centrali — e il dare loro ampio accesso a email, documenti e dati interni — possa trasformarli in minacce interne se manipolati o configurati male.

- Nell’agosto 2024, una società di sicurezza informatica(nuova finestra) ha scoperto una falla critica di divulgazione delle informazioni in Microsoft Copilot Studio, che consentiva ai copilot personalizzati di sfruttare protezioni deboli e ottenere informazioni sensibili (come token di servizio e chiavi di database) per muoversi ulteriormente all’interno di un sistema interno. Microsoft ha corretto il problema.

- Nell’ottobre 2025, ricercatori di sicurezza(nuova finestra) hanno scoperto una tecnica di phishing chiamata CoPhish che abusa di Microsoft Copilot Studio per far sembrare le pagine di login dannose completamente legittime. Gli aggressori possono creare un agente di Copilot Studio il cui pulsante di Login reindirizza le vittime a una falsa pagina di consenso OAuth, quindi condividere il link dell’agente (ospitato su un dominio Microsoft attendibile) per attirare gli utenti a concedere l’accesso. Una volta dato il consenso, l’aggressore può ottenere token che gli permettono di leggere, scrivere o inviare dati, come email, chat, calendari e note. Microsoft sta ancora lavorando su questo problema.

Un’alternativa privata a Copilot e Microsoft

Se sei a disagio per quanto profondamente Copilot sia integrato in Windows e quanti dati Microsoft raccolga attraverso i suoi servizi di IA — ma vuoi comunque la comodità di un chatbot IA — passa a Lumo, il nostro assistente IA privato(nuova finestra). Ospitato in Europa, Lumo non raccoglie mai né si addestra sui tuoi dati, non ti mostra annunci, non tiene log né condivide le tue informazioni con nessuno.

E se sei pronto a uscire completamente dall’ecosistema Microsoft, puoi costruire il tuo spazio di lavoro digitale privato con il nostro ecosistema crittografato. Puoi usare:

- Proton Mail e Calendar per un’email gratuita sicura e una pianificazione privata

- Proton Pass per una gestione delle password sicura

- Proton Drive per archiviazione cloud crittografata e condivisione dei file

- Proton VPN per proteggere il tuo traffico internet(nuova finestra)

Ogni servizio Proton è costruito per proteggere la tua privacy per impostazione predefinita, utilizzando la crittografia end-to-end, in modo che nessuno tranne te possa accedere ai tuoi dati — nemmeno noi.