隨著 Windows 10 支援於 2025 年 10 月正式結束,許多使用者正在升級到 Windows 11 以保持受安全更新保護。然而,有些人可能會驚訝地發現一個新的 AI 伴侶正在等待他們:Copilot。

Copilot 定位為 Microsoft 在生成式 AI 方面最雄心勃勃的努力,現在已深度整合到 Windows 11、Edge、Bing 和 Microsoft 365 套件中。它是 Microsoft 與 OpenAI(ChatGPT 和 ChatGPT Atlas 的建立者)數十億美元合作夥伴關係的核心,OpenAI 的 GPT 模型為 Copilot 的智慧提供動力。再加上配備專用 Copilot 鍵的 Copilot+ PC 的推出,這一切都表明 Microsoft 對引導 Windows 走向 AI 驅動的未來是多麼認真。

然而,並非每個人都歡迎這位無所不在的助手,它讓人聯想到 Clippy,但更加堅持不懈。Copilot 的緊密整合引發了隱私和安全疑慮,就像 Microsoft 旗下的 LinkedIn 開始使用公開個人檔案和活動資料來訓練 AI,或是 Google 將 Gemini 內崁至 Android 以取代 Google Assistant 的方案。

只有 Microsoft 365 企業使用者和 IT 管理員才能從 Windows 11 中完全移除 Copilot。在所有其他情況下——例如擁有個人或家庭訂閱的使用者,或根本沒有 Microsoft 365 訂閱的使用者——只能限制其功能並降低其可見度。

- 如何關閉 Copilot AI

- 什麼是 Microsoft Copilot?

- Microsoft Copilot 的隱私風險是什麼?

- Microsoft Copilot 的安全風險是什麼?

- Copilot 和 Microsoft 的私有替代方案

如何關閉 Copilot AI

根據您使用 Copilot 的方式,以下是如何將其從您的電腦中移除、調整其設定或減少其存在:

如何移除 Microsoft 365 Copilot(企業訂閱)

如果您是企業使用者,請前往 設定 → 應用程式 → 安裝的應用程式,選取 Copilot,然後點擊 解除安裝。

IT 管理員可以使用 PowerShell 中的以下命令移除 Copilot 應用程式:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

如何停用 Microsoft 365 Copilot(個人或家庭訂閱)

- 開啟任何 Microsoft 365 應用程式(Word、Excel、PowerPoint 或 OneNote)。

- 前往 檔案 → 選項 → Copilot。

- 清除 啟用 Copilot 核取方塊。

對您想要停用 Copilot 的每個 Microsoft 應用程式重複這些步驟。

如果任何 Microsoft 應用程式中不存在「啟用 Copilot」設定:

- 開啟 Word、Excel、PowerPoint 或 OneNote。

- 前往 檔案 → 帳號 → 帳號隱私 → 管理設定 → 連結的體驗。

- 清除 開啟分析內容的體驗 核取方塊。

- 重新啟動應用程式。

您只需要做一次,因為新的隱私設定將自動套用到連結到您帳號的所有 Microsoft 365 應用程式。

如何在 Windows 11 中隱藏 Copilot 圖示

您可以在 Windows 中關閉 Copilot 圖示,但無法從電腦中完全移除該功能。這些步驟僅停用 Copilot 的視覺和個人化元素,因此您仍然可以存取該應用程式。

要從工作列隱藏 Copilot 按鈕:

- 前往 設定 → 個人化 → 工作列。

- 找到並切換關閉 Copilot。

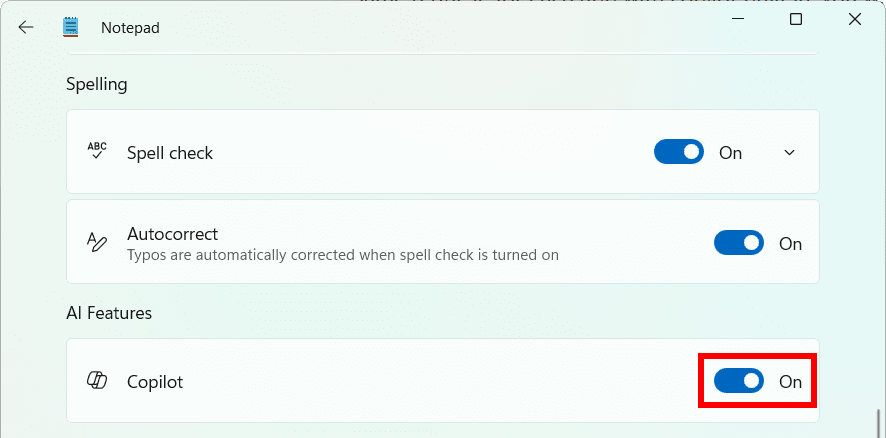

如果您使用的應用程式內建了 Copilot,您需要在每個應用程式中分別停用它。例如,在記事本中,前往 設定 → AI 功能 並切換關閉 Copilot。

- 重新啟動您的電腦以使變更生效。

如何停用 Copilot 網頁應用程式中的資料和個人化功能

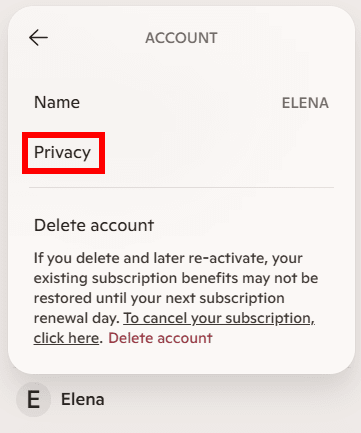

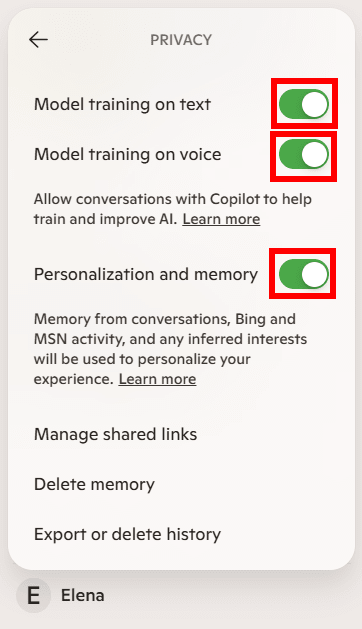

- 選取您的個人檔案名稱或相片 → 您的帳號 → 隱私。

- 切換關閉以下選項:

- 文字模型訓練

- 語音模型訓練

- 個人化和記憶

- 選取 刪除記憶 以立即移除 Copilot 記住的關於您的內容。

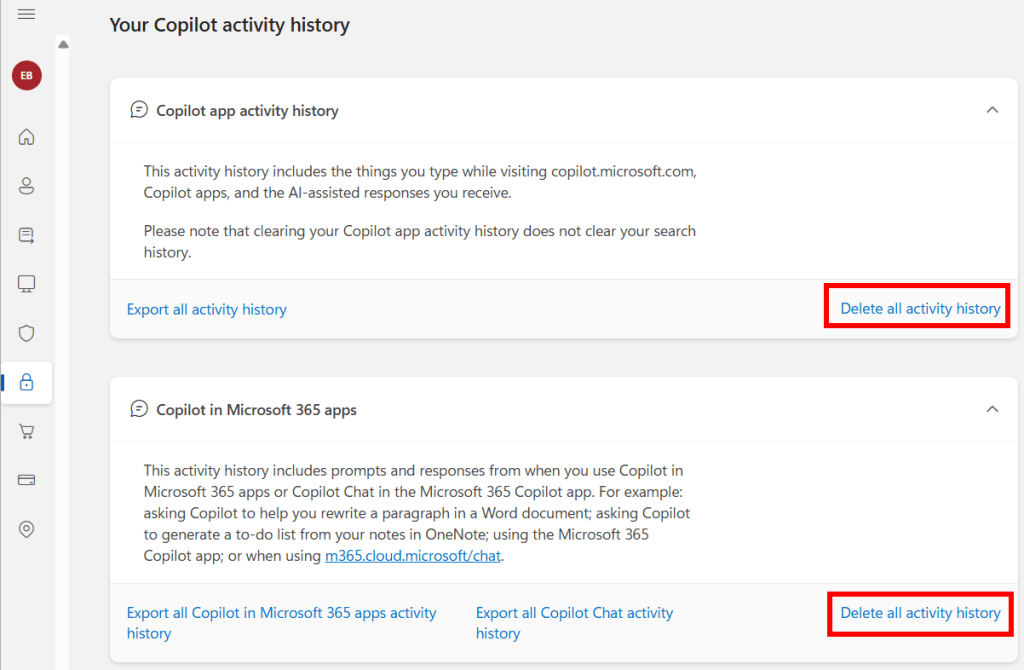

- 點擊 匯出或刪除紀錄。這將開啟一個瀏覽器頁面,您需要在該頁面使用您用於 Copilot 的 Microsoft 帳號登入。

- 為這些類別中的每一個選取 刪除所有活動紀錄:

- Copilot 應用程式活動紀錄

- Microsoft 365 應用程式中的 Copilot

- Windows 應用程式中的 Copilot

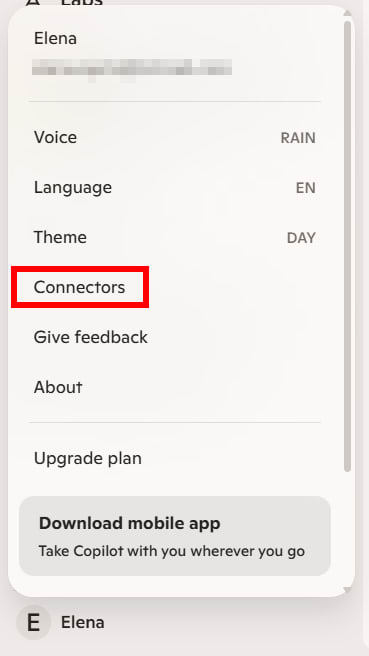

- 選取您的個人檔案名稱或相片 → 連接器。

- 切換關閉所有內容,包括 OneDrive、Outlook、Gmail、Google Drive 和 Google 日曆。

請注意,如果您的資料已被用於模型訓練,則無法復原。

如何停用 Gaming Copilot 模型訓練

- 在 Windows 上,按 Win + G 開啟 Game Bar。

- 前往 設定 → 隱私設定 → Gaming Copilot。

- 切換關閉 文字模型訓練。

- 要隱藏 Gaming Copilot 小工具,請將其從 Game Bar 小工具清單中移除。

目前,無法從 Xbox Game Bar 中完全移除 Gaming Copilot。此外,您無法阻止它使用您的語音互動來幫助訓練其 AI 模型。如果您關心隱私,最安全的方法是根本不要與 Gaming Copilot 互動。

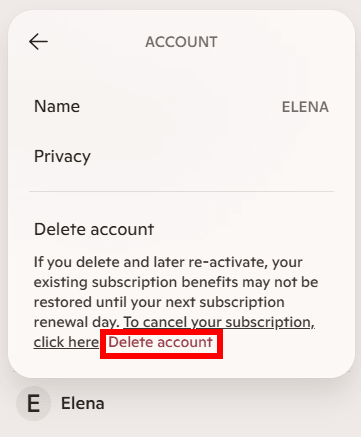

如何刪除您的 Copilot 帳號

在 Copilot 網頁應用程式中,選取您的個人檔案名稱或相片 → 您的帳號 → 刪除帳號。

刪除您的 Copilot 帳號不會刪除您的 Microsoft 帳號,您仍然可以在不登入的情況下使用 Copilot。

如果您不想完全依賴 Copilot,請考慮切換到一個從不記錄您的資料、不將其用於模型訓練或與第三方分享的隱私 AI 助理(新視窗)。

什麼是 Microsoft Copilot?

Copilot 是 Microsoft 整合在其產品和服務(例如 Word、Excel、PowerPoint、Outlook、Teams 和 Windows)中的 AI 助理系列。它使用基於 Microsoft 自己的 AI 技術和 OpenAI 的 GPT(如 GPT-4o,與驅動 ChatGPT 的技術相同)的大型語言模型 (LLM)。

與 LLM 一樣,Copilot 可以透過理解自然語言提示、分析資料、生成和總結內容以及根據上下文提供建議,幫助您提高生產力、創造力和效率。

Microsoft 提供多個版本的 Copilot,具體取決於您是個人使用還是專業使用,包括:

- Microsoft Copilot — 用於日常任務的免費個人 AI 助理。它可作為 Windows 11 應用程式(預設安裝)、網頁應用程式和 macOS 應用程式使用。

- Gaming Copilot — 用於 Windows 遊戲的免費個人 AI 助理,它會截取螢幕畫面以了解遊戲中發生的事情並提供提示,類似於 Recall 擷取桌面活動快照的方式。

- Microsoft 365 Copilot — 整合到 Word、Excel、PowerPoint、Outlook 和 Teams 中,透過 Microsoft Graph 使用您的資料,Microsoft Graph 是一個連結您的資料(如電子郵件、行事曆和文件)的平台。

Microsoft Copilot 的隱私風險是什麼?

Microsoft 在 Microsoft 365 等企業設定中為 Copilot 維持強大的隱私保護,但消費者帳號面臨著截然不同的現實(新視窗):

您的資料可能用於廣告和剖析

消費者 Microsoft 帳號中的 Copilot 服務已連線到 Microsoft 的廣告生態系統。這意味著您的互動可能會影響您看到的廣告和推薦。例如,如果您詢問 Copilot 有關旅遊優惠的資訊,您稍後可能會看到航班或飯店廣告。

雖然您可以在 Microsoft 帳號隱私設定中關閉個人化廣告,但該公司仍會保留該互動資料,並可能以匿名形式將其用於其他目的,例如為具有與您相似個人檔案的其他 Copilot 使用者改善廣告目標投放。

您保留所有權,但 Microsoft 仍然可以使用您的資料

雖然 Microsoft 表示您保留內容的所有權,但使用 Copilot 意味著您授予該公司對其的廣泛權利,包括「複製、散佈、傳輸、公開展示、公開表演、編輯、翻譯和重新格式化」您的資料,並將這些權利轉讓給第三方的權利。

例如,如果您是一位作家,將未發表故事的摘錄加入 Copilot 以請求校對或風格意見回饋,那麼該文字在技術上就成為 Microsoft 根據其服務條款獲得授權處理和使用的素材的一部分。您未發布的智慧財產權仍可能在您的直接控制之外被使用,即使它從未公開。

您的資料可能被處理並用於 AI 訓練

來自您的 Copilot 提示和回應的資料可能會被 Microsoft 收集、記錄並分析以進行 AI 訓練。不能保證您的敏感或個人資料將被排除在訓練資料集之外。

與大多數 AI 助理一樣,Copilot 需要大量資訊來持續學習並改進其回應 — 即使這個過程可能會涉及智慧財產權的模糊地帶。目前的一個例子是作者和主要新聞媒體提出的一系列美國訴訟(新視窗),他們指控 Microsoft 及其合作夥伴 OpenAI 未經許可使用其受版權保護的作品來訓練 Copilot 和 ChatGPT 等 AI 模型。OpenAI 自身也公開承認(新視窗),「不使用受版權保護的材料就不可能訓練當今領先的 AI 系統。」

人們可能會看到您的機敏資料

Microsoft 員工可能會審閱您的 Copilot 輸入和輸出 — 包括您鍵入或作為檔案附件上載的任何內容 — 以改善服務、管控有害內容,或當您選擇提交意見回饋時。如果這讓您感到不舒服,您應避免輸入任何敏感資訊,例如個人身分資料或商業機密。

連接器會將您的資料暴露給第三方

連接器允許 Copilot 連結 Microsoft 產品(如 OneDrive 或 Outlook)和第三方服務(如 Google Drive),以便它可以從多個來源提取資訊。例如,如果您要求 Copilot 摘要儲存在 Google Drive 中的所有會議記錄,它將搜尋您的 Drive 檔案並傳回摘要。

但是當您啟用連接器時,您也允許 Copilot 與該其他服務交換資訊。以 Google Drive 為例,雖然 Copilot 獲得了對您的 Drive 檔案結構、名稱、時間戳記和內容的存取權,但 Google 也會收到與您的 Microsoft 帳號相關的某些詳細資料,例如您的個人檔案相片、姓名或電子郵件地址。您的寶貴資料現在存在於兩個生態系統(Microsoft 和 Google)中,從而在各平台上建立更清晰、更完整的個人檔案。

您的資料可能會在美國管轄下跨境傳輸

取決於您居住的地方,Microsoft 可能會將您的 Copilot 資料和互動儲存在您所在的地區。例如,歐洲人的資料可能儲存在歐盟境內。但您的資料可能不會一直留在那裡。儘管該公司有 EU Data Boundary 承諾(新視窗),但由於技術或容量原因,某些處理仍可能在您所在地區之外進行。而且因為 Microsoft 是一家美國公司,它受美國法律(如 CLOUD 法案)的約束,這意味著美國當局可以要求存取您的資料(無論其儲存在何處),有時甚至不需要搜索令。

Microsoft 密切監控 Copilot 聊天資料

Microsoft 大規模分析 Copilot 互動,以了解人們隨著時間推移如何使用該助理。在 2025 年 Copilot 使用報告(新視窗)中,AI 研究人員查看了 3,750 萬次 Copilot 對話以識別使用模式,並指出隨著更多資料的可用,將發布更多報告。Microsoft 並不是唯一這樣做的公司,其合作夥伴 OpenAI 也發布了 ChatGPT 的消費者使用資料(新視窗)。

Microsoft 表示這些資料已經過去識別化並簡化為高層次摘要,但這並不能完全移除隱私風險。研究(新視窗)一再顯示,所謂的匿名資料在與時間戳記、裝置特徵或位置訊號等其他事物結合時,通常可以被重新識別。而且因為 Copilot 綁定到一個跨越 Windows、Microsoft 365、Bing、Edge 和廣告服務的帳號生態系統,這些跨服務連線使得隨著時間推移重新關聯變得更加容易。

此外,目前尚不清楚原始、可識別的 Copilot 對話資料在去識別化之前會保留多久,或者它是如何受到保護的。如果原始資料駐留在 Microsoft 的伺服器上,它可能會面臨諸如未經授權存取、內部威脅或資料外洩等風險。

Microsoft Copilot 的安全風險是什麼?

由於 Microsoft 平均可以為每個組織存取 300 萬筆敏感資料記錄(新視窗),因此了解它可能帶來的安全風險非常重要,特別是如果您計劃將其用於您的業務:

- 2025 年 6 月,研究人員發現了 EchoLeak (CVE-2025-32711(新視窗)),這是一個 Microsoft 365 Copilot 中的零點擊弱點,讓攻擊者無需任何使用者動作即可竊取資料。透過將惡意指令和連結隱藏在正常的電子郵件中,攻擊者可以誘騙 Copilot 執行這些命令、存取這些連結,並將部分使用者資料傳送到外部伺服器。該弱點已修補,但這是一個例子,說明將像 Copilot 這樣的 AI 助理整合到核心系統中 — 並給予它們對電子郵件、文件和內部資料的廣泛存取權 — 如果它們受到操縱或設定錯誤,可能會將它們變成內部威脅。

- 2024 年 8 月,一家網路安全公司(新視窗)發現 Microsoft Copilot Studio 中存在嚴重的資訊洩露缺陷,該缺陷允許自訂 copilot 利用薄弱的保護措施獲取敏感資訊(如服務權杖和資料庫金鑰),以進一步深入內部系統。Microsoft 已修補該問題。

- 2025 年 10 月,安全研究人員(新視窗)發現了一種名為 CoPhish 的網路釣魚技術,該技術濫用 Microsoft Copilot Studio 使惡意登入頁面看起來完全合法。攻擊者可以建立一個 Copilot Studio 代理程式,其登入按鈕會將受害者重新導向到假的 OAuth 同意頁面,然後共享該代理程式連結(託管在受信任的 Microsoft 網域上)以引誘使用者授予存取權。一旦給予同意,攻擊者就可以獲得權杖,讓他們已讀、寫入或傳送資料,例如電子郵件、聊天、行事曆和筆記。Microsoft 仍在致力於解決此問題。

Copilot 和 Microsoft 的私有替代方案

如果您對 Copilot 整合到 Windows 的深度以及 Microsoft 透過其 AI 服務收集多少資料感到不安 — 但仍然想要 AI 聊天機器人的便利性 — 請切換到 Lumo,我們的私有 AI 助理(新視窗)。Lumo 位於歐洲,從不收集或使用您的資料進行訓練、顯示廣告、保留日誌或與任何人共享您的資訊。

如果您準備好完全踏出 Microsoft 生態系統,您可以使用我們的已加密生態系統建立自己的私有數位工作區。您可以使用:

- Proton Mail 和行事曆,用於安全的免費電子郵件和私有排程

- Proton Pass,用於安全的密碼管理

- Proton Drive,用於已加密的雲端儲存空間和檔案共享

- Proton VPN,用於保護您的網際網路流量(新視窗)

每個 Proton 服務預設都是為了保護您的隱私而建構的,使用端對端加密,因此除了您之外沒有人可以存取您的資料 — 即使是我們也不行。