Avec la fin officielle du support de Windows 10 en octobre 2025, de nombreux utilisateurs passent à Windows 11 pour rester protégés avec les mises à jour de sécurité. Certains pourraient être surpris, cependant, de trouver un nouveau compagnon IA qui les attend : Copilot.

Positionné comme l’effort le plus ambitieux de Microsoft dans l’IA générative, Copilot est désormais profondément intégré dans Windows 11, Edge, Bing et la suite Microsoft 365. C’est la pièce maîtresse du partenariat de plusieurs milliards de dollars de Microsoft avec OpenAI (le créateur de ChatGPT et ChatGPT Atlas), dont les modèles GPT alimentent l’intelligence de Copilot. Combiné au lancement des PC Copilot+ — équipés d’une touche Copilot dédiée — tout cela montre à quel point Microsoft est sérieux quant à l’orientation de Windows vers un avenir propulsé par l’IA.

Cependant, tout le monde n’accueille pas favorablement cette aide toujours présente, qui rappelle Clippy mais en beaucoup plus persistant. L’intégration étroite de Copilot soulève des préoccupations en matière de respect de la vie privée et de sécurité, tout comme lorsque LinkedIn, propriété de Microsoft, a commencé à entraîner l’IA en utilisant des profils publics et des données d’activité, ou lorsque l’abonnement de Google d’intégrer profondément son assistant IA Gemini dans Android pour remplacer Google Assistant.

Seuls les utilisateurs d’entreprise de Microsoft 365 et les administrateurs informatiques peuvent retirer complètement Copilot de Windows 11. Dans tous les autres cas — comme les utilisateurs avec des abonnements personnels ou familiaux, ou pas d’abonnement Microsoft 365 du tout — il n’existe que des moyens de limiter ses fonctionnalités et d’atténuer sa visibilité.

- Comment désactiver l’IA Copilot

- Comment retirer Microsoft 365 Copilot (abonnement d’entreprise)

- Comment désactiver Microsoft 365 Copilot (abonnement personnel ou familial)

- Comment masquer les icônes Copilot dans Windows 11

- Comment désactiver les données et les fonctionnalités de personnalisation dans l’application web Copilot

- Comment désactiver l’entraînement du modèle Gaming Copilot

- Comment supprimer votre compte Copilot

- Qu’est-ce que Microsoft Copilot ?

- Quels sont les risques pour le respect de la vie privée de Microsoft Copilot ?

- Quels sont les risques de sécurité de Microsoft Copilot ?

- Une alternative privée à Copilot et Microsoft

Comment désactiver l’IA Copilot

Selon la façon dont vous utilisez Copilot, voici comment vous pouvez le retirer de votre ordinateur, ajuster ses paramètres ou réduire sa présence :

Comment retirer Microsoft 365 Copilot (abonnement d’entreprise)

Si vous êtes un utilisateur d’entreprise, allez dans Paramètres → Applications → Applications installées, sélectionnez Copilot, et cliquez sur Désinstaller.

Les administrateurs informatiques peuvent retirer l’application Copilot en utilisant la commande suivante dans PowerShell :

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Comment désactiver Microsoft 365 Copilot (abonnement personnel ou familial)

- Ouvrez n’importe quelle application Microsoft 365 (Word, Excel, PowerPoint ou OneNote).

- Allez dans Fichier → Options → Copilot.

- Effacez la case à cocher Activer Copilot.

Répétez ces étapes pour chaque application Microsoft dans laquelle vous souhaitez désactiver Copilot.

Si le paramètre Activer Copilot n’existe dans aucune des applications de Microsoft :

- Ouvrez Word, Excel, PowerPoint ou OneNote.

- Allez dans Fichier → Compte → Confidentialité du compte → Gérer les paramètres → Expériences connectées.

- Effacez la case à cocher Activer les expériences qui analysent votre contenu.

- Redémarrez l’application.

Vous ne devez faire cela qu’une seule fois, car le nouveau paramètre de confidentialité s’appliquera automatiquement à toutes les applications Microsoft 365 liées à votre compte.

Comment masquer les icônes Copilot dans Windows 11

Vous pouvez désactiver les icônes Copilot dans Windows, mais vous ne pouvez pas retirer complètement la fonctionnalité de votre ordinateur. Ces étapes ne font que désactiver les éléments visuels et de personnalisation de Copilot, vous pourrez donc toujours accéder à l’application.

Pour masquer le bouton Copilot de votre barre des tâches :

- Allez dans Paramètres → Personnalisation → Barre des tâches.

- Trouvez et désactivez Copilot.

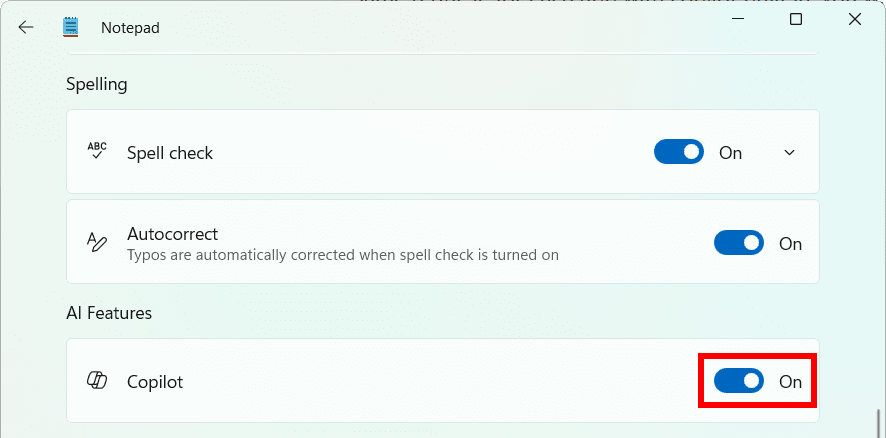

Si vous utilisez des applications qui intègrent Copilot, vous devrez le désactiver séparément dans chaque application. Par exemple, dans le Bloc-notes, allez dans Paramètres → Fonctionnalités IA et désactivez Copilot.

- Redémarrez votre ordinateur pour que les modifications prennent effet.

Comment désactiver les données et les fonctionnalités de personnalisation dans l’application web Copilot

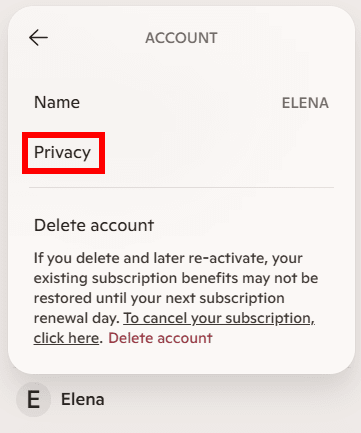

- Sélectionnez votre nom de profil ou votre photo → votre compte → Confidentialité.

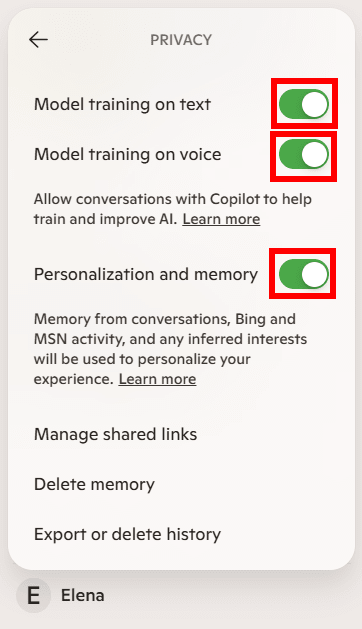

- Désactivez les options suivantes :

- Entraînement du modèle sur le texte

- Entraînement du modèle sur la voix

- Personnalisation et mémoire

- Sélectionnez Supprimer la mémoire pour retirer immédiatement ce que Copilot retient de vous.

- Cliquez sur Exporter ou supprimer l’historique. Cela ouvrira une page de navigateur où vous devrez vous connecter avec le compte Microsoft que vous utilisez pour Copilot.

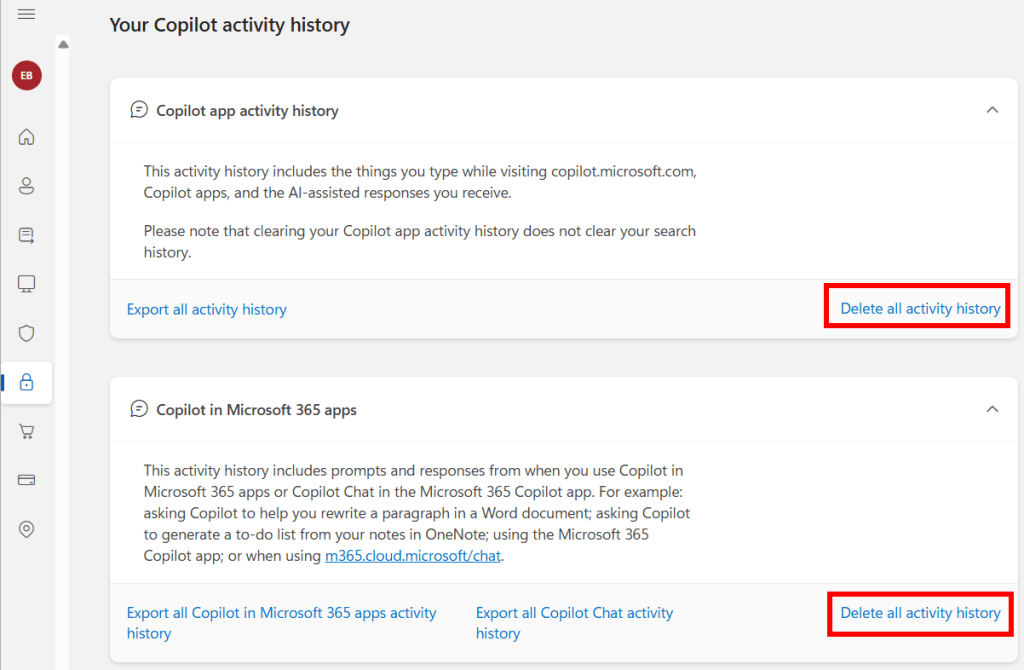

- Sélectionnez Supprimer tout l’historique d’activité pour chacune de ces catégories :

- Historique d’activité de l’application Copilot

- Copilot dans les applications Microsoft 365

- Copilot dans les applications Windows

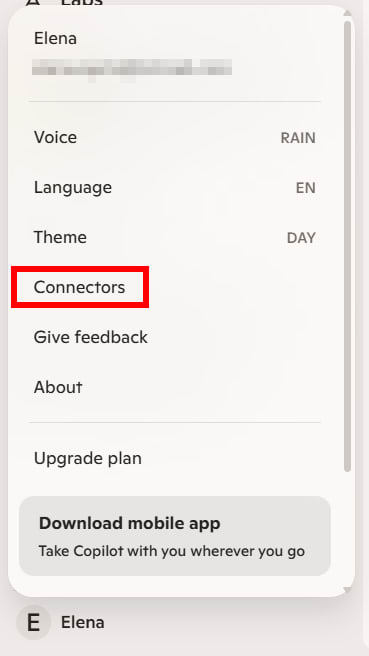

- Sélectionnez votre nom de profil ou votre photo → Connecteurs.

- Désactivez tout, y compris OneDrive, Outlook, Gmail, Google Drive et Google Calendar.

Notez que si vos données ont déjà été utilisées pour l’entraînement du modèle, il n’y a aucun moyen d’annuler cela.

Comment désactiver l’entraînement du modèle Gaming Copilot

- Sur Windows, appuyez sur Win + G pour ouvrir la Game Bar.

- Allez dans Paramètres → Paramètres de confidentialité → Gaming Copilot.

- Désactivez Entraînement du modèle sur le texte.

- Pour masquer le widget Gaming Copilot, retirez-le de la liste des widgets de la Game Bar.

Actuellement, il n’y a aucun moyen de retirer complètement Gaming Copilot de la Xbox Game Bar. De plus, vous ne pouvez pas l’empêcher d’utiliser vos interactions vocales pour aider à entraîner ses modèles d’IA. Si vous vous souciez du respect de la vie privée, il est plus sûr de ne pas interagir avec Gaming Copilot du tout.

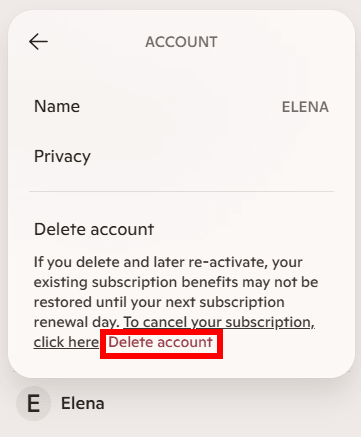

Comment supprimer votre compte Copilot

Dans l’application web Copilot, sélectionnez votre nom de profil ou votre photo → votre compte → Supprimer le compte.

La suppression de votre compte Copilot ne supprime pas votre compte Microsoft, et vous pouvez toujours utiliser Copilot sans vous connecter.

Si vous préférez ne pas compter sur Copilot du tout, envisagez de passer à un assistant IA privé(nouvelle fenêtre) qui ne journalise jamais vos données, ne les utilise pas pour l’entraînement du modèle et ne les partage pas avec des tiers.

Qu’est-ce que Microsoft Copilot ?

Copilot est la gamme d’assistants IA de Microsoft intégrée à ses produits et services, tels que Word, Excel, PowerPoint, Outlook, Teams et Windows. Il utilise de grands modèles de langage (LLM) basés sur les propres technologies d’IA de Microsoft et les GPT d’OpenAI — comme GPT-4o, le même qui alimente ChatGPT.

Comme les LLM, Copilot peut vous aider à être plus productif, créatif et efficace en comprenant les invites en langage naturel, en analysant les données, en générant et en résumant du contenu et en fournissant des suggestions basées sur le contexte.

Microsoft propose Copilot en plusieurs versions, selon que vous l’utilisez à titre personnel ou professionnel, notamment :

- Microsoft Copilot — un assistant IA personnel gratuit pour les tâches quotidiennes. Il est disponible sous forme d’application Windows 11 (installée par défaut), d’application web et d’application macOS.

- Gaming Copilot — un assistant IA personnel gratuit pour les jeux Windows, qui prend des captures d’écran pour comprendre ce qui se passe dans un jeu et offrir des conseils, similaire à la façon dont Recall prend des instantanés de votre activité de bureau.

- Microsoft 365 Copilot — s’intègre à Word, Excel, PowerPoint, Outlook et Teams pour utiliser vos données via Microsoft Graph, une plateforme qui connecte vos données comme les messages, le calendrier et les documents.

Quels sont les risques pour le respect de la vie privée de Microsoft Copilot ?

Microsoft maintient de solides protections du respect de la vie privée pour Copilot dans les environnements d’entreprise tels que Microsoft 365, mais les comptes consommateurs font face à une réalité très différente(nouvelle fenêtre) :

Vos données peuvent être utilisées pour des publicités et le profilage

Les services Copilot dans les comptes consommateurs Microsoft sont connectés à l’écosystème publicitaire de Microsoft. Cela signifie que vos interactions peuvent influencer les publicités et les recommandations que vous voyez. Par exemple, si vous interrogez Copilot sur des offres de voyage, vous pourriez voir plus tard des publicités pour des vols ou des hôtels.

Bien que vous puissiez désactiver les publicités personnalisées dans les paramètres de confidentialité de votre compte Microsoft, l’entreprise conserve toujours ces données d’interaction et peut les utiliser sous forme anonymisée à d’autres fins, telles que l’amélioration du ciblage publicitaire pour d’autres utilisateurs de Copilot ayant des profils similaires au vôtre.

Vous gardez la propriété, mais Microsoft peut toujours utiliser vos données

Bien que Microsoft affirme que vous conservez la propriété de votre contenu, utiliser Copilot signifie que vous accordez à l’entreprise de vastes droits sur celui-ci, y compris pour « copier, distribuer, transmettre, afficher publiquement, exécuter publiquement, modifier, traduire et reformater » vos données, et pour transmettre ces droits à des tiers.

Par exemple, si vous êtes un écrivain qui ajoute des extraits d’une histoire non publiée dans Copilot pour demander une relecture ou un commentaire stylistique, ce texte devient techniquement partie du matériel que Microsoft est autorisé à traiter et à utiliser selon ses conditions de service. Votre propriété intellectuelle non publiée peut toujours être utilisée au-delà de votre contrôle direct, même si elle ne devient jamais publique.

Vos données peuvent être traitées et utilisées pour l’entraînement de l’IA

Les données de vos invites et réponses Copilot peuvent être collectées, journalisées et analysées par Microsoft pour l’entraînement de l’IA. Il n’y a aucune garantie que vos données sensibles ou personnelles seront exclues des ensembles de données d’entraînement.

Comme la plupart des assistants IA, Copilot a besoin de grandes quantités d’informations pour continuer à apprendre et à affiner ses réponses — même lorsque ce processus dérive vers des zones grises de la propriété intellectuelle. Un exemple actuel est une série de poursuites américaines(nouvelle fenêtre) déposées par des auteurs et de grands organes de presse qui allèguent que Microsoft et son partenaire OpenAI ont utilisé leurs œuvres protégées par le droit d’auteur sans autorisation pour entraîner des modèles d’IA tels que Copilot et ChatGPT. OpenAI a elle-même reconnu publiquement(nouvelle fenêtre) qu’il est « impossible d’entraîner les principaux systèmes d’IA d’aujourd’hui sans utiliser de matériel protégé par le droit d’auteur ».

Des personnes peuvent voir vos données sensibles

Les employés de Microsoft peuvent examiner vos saisies et résultats Copilot — y compris tout ce que vous tapez ou importez sous forme de pièces jointes — pour améliorer le service, modérer le contenu nuisible ou lorsque vous choisissez d’envoyer un commentaire. Si cette idée vous met mal à l’aise, vous devriez éviter de saisir des informations sensibles, telles que des données personnellement identifiables ou des secrets commerciaux.

Les connecteurs exposent vos données à des tiers

Les connecteurs permettent à Copilot de se lier aux produits Microsoft (comme OneDrive ou Outlook) et aux services tiers (comme Google Drive), afin qu’il puisse extraire des informations de plusieurs sources. Par exemple, si vous demandez à Copilot de résumer toutes les notes de réunion stockées dans Google Drive, il recherchera dans vos fichiers Drive et renverra un résumé.

Mais lorsque vous activez un connecteur, vous autorisez également Copilot à échanger des informations avec cet autre service. Dans le cas de Google Drive, alors que Copilot obtient l’accès à la structure de fichiers, aux noms, aux horodatages et au contenu de votre Drive, Google reçoit également certaines informations associées à votre compte Microsoft, telles que votre photo de profil, votre nom ou votre adresse e-mail. Vos données précieuses résident désormais dans les deux écosystèmes (Microsoft et Google), créant un profil plus clair et plus complet de vous sur les plateformes.

Vos données peuvent traverser les frontières sous juridiction américaine

Selon votre lieu de résidence, Microsoft peut stocker vos données et interactions Copilot dans votre région. Par exemple, les Européens peuvent avoir leurs données stockées au sein de l’UE. Mais vos données peuvent ne pas toujours y rester. Malgré les engagements de Microsoft en matière de frontière des données de l’UE(nouvelle fenêtre), certains traitements peuvent toujours avoir lieu en dehors de votre région pour des raisons techniques ou de capacité. Et parce que Microsoft est une entreprise américaine, elle est soumise aux lois américaines telles que le CLOUD Act, ce qui signifie que les autorités américaines pourraient demander l’accès à vos données (quel que soit l’endroit où elles sont stockées), parfois sans nécessiter de mandat.

Microsoft surveille de près les données de chat de Copilot

Microsoft analyse les interactions Copilot à grande échelle pour comprendre comment les gens utilisent l’assistant au fil du temps. Dans le rapport d’utilisation de Copilot 2025(nouvelle fenêtre), les chercheurs en IA ont examiné 37,5 millions de conversations Copilot pour identifier les modèles d’utilisation, notant que d’autres rapports seront publiés à mesure que davantage de données seront disponibles. Microsoft n’est pas la seule entreprise à faire cela, car son partenaire OpenAI publie également des données d’utilisation des consommateurs(nouvelle fenêtre) pour ChatGPT.

Microsoft affirme que ces données ont été désidentifiées et réduites à des résumés de haut niveau, mais cela n’élimine pas entièrement les risques pour le respect de la vie privée. La recherche(nouvelle fenêtre) a montré à plusieurs reprises que les données soi-disant anonymes peuvent souvent être réidentifiées lorsqu’elles sont combinées avec d’autres éléments, tels que les horodatages, les caractéristiques de l’appareil ou les signaux d’emplacement. Et comme Copilot est lié à un écosystème basé sur un compte qui s’étend sur Windows, Microsoft 365, Bing, Edge et les services publicitaires, ces connexions interservices facilitent la réassociation au fil du temps.

De plus, on ne sait pas combien de temps les données de conversation Copilot originales et identifiables restent stockées avant la désidentification, ni comment elles sont protégées. Si les données brutes résident sur les serveurs de Microsoft, elles peuvent être exposées à des risques tels que l’accès non autorisé, les menaces internes ou les fuites de données.

Quels sont les risques de sécurité de Microsoft Copilot ?

Puisque Microsoft peut accéder à une moyenne de trois millions d’enregistrements de données sensibles(nouvelle fenêtre) pour chaque organisation, il est important de comprendre les risques de sécurité que cela peut introduire, surtout si vous comptez l’utiliser pour votre entreprise :

- En juin 2025, des chercheurs ont découvert EchoLeak (CVE-2025-32711(nouvelle fenêtre)), une vulnérabilité « zero-click » dans Microsoft 365 Copilot qui permettait aux attaquants de voler des données sans aucune action de l’utilisateur. En masquant des instructions et des liens malveillants dans un message normal, les attaquants pouvaient inciter Copilot à suivre ces commandes, à accéder à ces liens et à envoyer des parties des données de l’utilisateur vers un serveur externe. La vulnérabilité a été corrigée, mais c’est un exemple de la façon dont l’intégration d’assistants IA comme Copilot dans les systèmes centraux — et leur donner un large accès aux messages, documents et données internes — peut les transformer en menaces internes s’ils sont manipulés ou mal configurés.

- En août 2024, une entreprise de cybersécurité(nouvelle fenêtre) a découvert une faille critique de divulgation d’informations dans Microsoft Copilot Studio, qui permettait à des copilotes personnalisés d’exploiter des protections faibles et d’obtenir des informations sensibles (comme des jetons de service et des clés de base de données) pour se déplacer plus loin à l’intérieur d’un système interne. Microsoft a corrigé le problème.

- En octobre 2025, des chercheurs en sécurité(nouvelle fenêtre) ont découvert une technique d’hameçonnage appelée CoPhish qui abuse de Microsoft Copilot Studio pour donner aux pages de connexion malveillantes une apparence totalement légitime. Les attaquants peuvent créer un agent Copilot Studio dont le bouton de connexion redirige les victimes vers une fausse page de consentement OAuth, puis partager le lien de l’agent (hébergé sur un domaine Microsoft approuvé) pour inciter les utilisateurs à accorder l’accès. Une fois le consentement donné, l’attaquant peut obtenir des jetons qui lui permettent de lire, d’écrire ou d’envoyer des données, telles que des messages, des chats, des calendriers et des notes. Microsoft travaille toujours sur ce problème.

Une alternative privée à Copilot et Microsoft

Si vous êtes mal à l’aise avec la profondeur de l’intégration de Copilot dans Windows et la quantité de données collectées par Microsoft via ses services d’IA — mais que vous souhaitez tout de même bénéficier de la commodité d’un chatbot IA — passez à Lumo, notre assistant IA privé(nouvelle fenêtre). Hébergé en Europe, Lumo ne collecte jamais vos données pour s’entraîner, ne vous montre pas de publicités, ne conserve pas de journaux et ne partage vos informations avec personne.

Et si vous êtes prêt à sortir entièrement de l’écosystème Microsoft, vous pouvez créer votre propre espace de travail numérique privé avec notre écosystème chiffré. Vous pouvez utiliser :

- Proton Mail et Calendar pour une boite mail gratuite sécurisée et une planification privée

- Proton Pass pour une gestion sécurisée des mots de passe

- Proton Drive pour un espace de stockage cloud chiffré et le partage de fichiers

- Proton VPN pour protéger votre trafic internet(nouvelle fenêtre)

Chaque service Proton est conçu pour garantir votre respect de la vie privée par défaut, en utilisant le chiffrement de bout en bout, de sorte que personne d’autre que vous ne puisse accéder à vos données — pas même nous.