Da Windows 10-support officielt slutter i oktober 2025, opgraderer mange brugere til Windows 11 for at forblive beskyttet med sikkerhedsopdateringer. Nogle kan dog blive overraskede over at finde en ny AI-ledsager, der venter på dem: Copilot.

Positioneret som Microsofts mest ambitiøse satsning på generativ AI, er Copilot nu dybt integreret på tværs af Windows 11, Edge, Bing og Microsoft 365-suiten. Det er midtpunktet i Microsofts partnerskab til flere milliarder dollars med OpenAI (skaberen af ChatGPT og ChatGPT Atlas), hvis GPT-modeller driver Copilots intelligens. Kombineret med lanceringen af Copilot+ pc’er — udstyret med en dedikeret Copilot-tast — viser alt dette, hvor seriøse Microsoft er omkring at styre Windows mod en AI-drevet fremtid.

Det er dog ikke alle, der byder denne altid tilstedeværende hjælper velkommen, som minder om Clippy, men er langt mere vedholdende. Copilots tætte integration rejser bekymringer om privatliv og sikkerhed, ligesom da Microsoft-ejede LinkedIn begyndte at træne AI ved hjælp af offentlige profiler og aktivitetsdata, eller da Googles abonnement om dybt at integrere sin AI-assistent Gemini i Android for at erstatte Google Assistant.

Kun Microsoft 365 enterprise-brugere og IT-administratorer kan fjerne Copilot fuldstændigt fra Windows 11. I alle andre tilfælde — såsom brugere med personlige eller familieabonnementer, eller intet Microsoft 365-abonnement overhovedet — er der kun måder at begrænse dens funktioner og tone dens synlighed ned.

- Sådan slår De Copilot AI fra

- Sådan fjerner De Microsoft 365 Copilot (enterprise-abonnement)

- Sådan deaktiverer De Microsoft 365 Copilot (personligt eller familieabonnement)

- Sådan skjuler De Copilot-ikoner i Windows 11

- Sådan deaktiverer De data og personaliseringsfunktioner i Copilot-webappen

- Sådan deaktiverer De Gaming Copilot-modeltræning

- Sådan sletter De Deres Copilot-konto

- Hvad er Microsoft Copilot?

- Hvad er risiciene for privatlivet ved Microsoft Copilot?

- Hvad er sikkerhedsrisiciene ved Microsoft Copilot?

- Et privat alternativ til Copilot og Microsoft

Sådan slår De Copilot AI fra

Afhængigt af hvordan De bruger Copilot, er her hvordan De kan fjerne det fra Deres computer, justere dets indstillinger eller skrue ned for dets tilstedeværelse:

Sådan fjerner De Microsoft 365 Copilot (enterprise-abonnement)

Hvis De er en enterprise-bruger, skal De gå til Indstillinger → Apps → Installerede apps, vælge Copilot og klikke på Afinstaller.

IT-administratorer kan fjerne Copilot-appen ved hjælp af følgende kommando i PowerShell:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Sådan deaktiverer De Microsoft 365 Copilot (personligt eller familieabonnement)

- Åbn en vilkårlig Microsoft 365-app (Word, Excel, PowerPoint eller OneNote).

- Gå til Fil → Indstillinger → Copilot.

- Ryd afkrydsningsfeltet Aktivér Copilot.

Gentag disse trin for hver Microsoft-app, De vil deaktivere Copilot i.

Hvis indstillingen Aktivér Copilot ikke findes i nogen af Microsofts apps:

- Åbn Word, Excel, PowerPoint eller OneNote.

- Gå til Fil → Konto → Kontoprivatliv → Administrer indstillinger → Forbundne oplevelser.

- Ryd afkrydsningsfeltet Slå oplevelser til, der analyserer dit indhold.

- Genstart appen.

De behøver kun at gøre dette én gang, da den nye privatlivsindstilling automatisk vil anvende på tværs af alle Microsoft 365-apps linket til Deres konto.

Sådan skjuler De Copilot-ikoner i Windows 11

De kan slå Copilot-ikoner fra i Windows, men De kan ikke fjerne funktionen helt fra Deres computer. Disse trin deaktiverer kun Copilots visuelle og personaliseringselementer, så De vil stadig kunne få adgang til appen.

For at skjule Copilot-knappen fra Deres proceslinje:

- Gå til Indstillinger → Personalisering → Proceslinje.

- Find og slå Copilot fra.

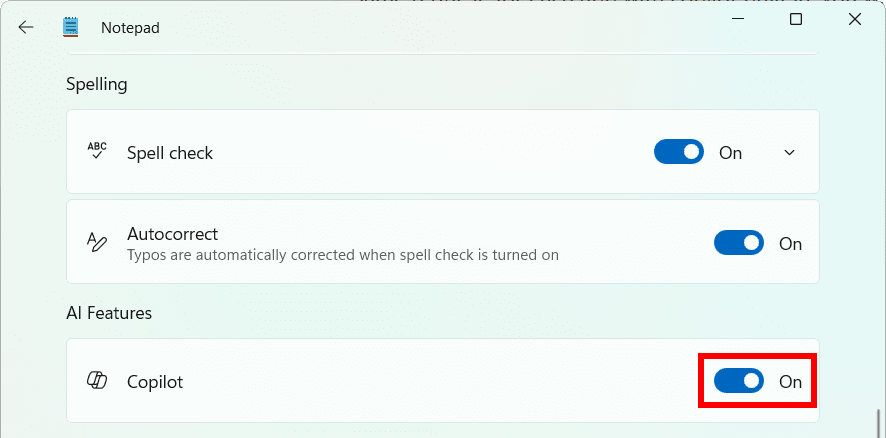

Hvis De bruger apps, der har Copilot indbygget, skal De deaktivere det separat i hver app. For eksempel i Notesblok, gå til Indstillinger → AI-funktioner og slå Copilot fra.

- Genstart Deres computer for at ændringerne træder i kraft.

Sådan deaktiverer De data og personaliseringsfunktioner i Copilot-webappen

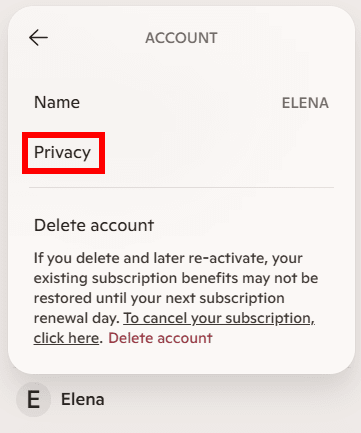

- Vælg Deres profilnavn eller billede → Deres konto → Privatliv.

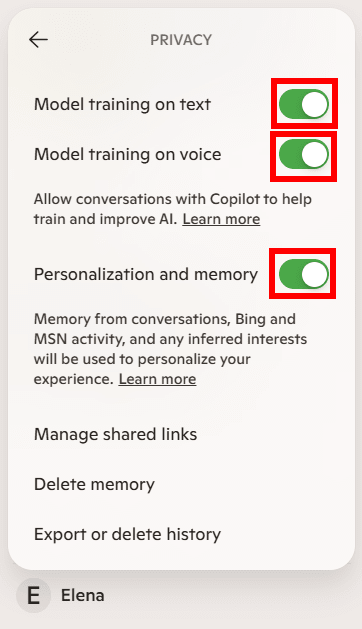

- Slå følgende muligheder fra:

- Modeltræning på tekst

- Modeltræning på stemme

- Personalisering og hukommelse

- Vælg Slet hukommelse for øjeblikkeligt at fjerne, hvad Copilot husker om Dem.

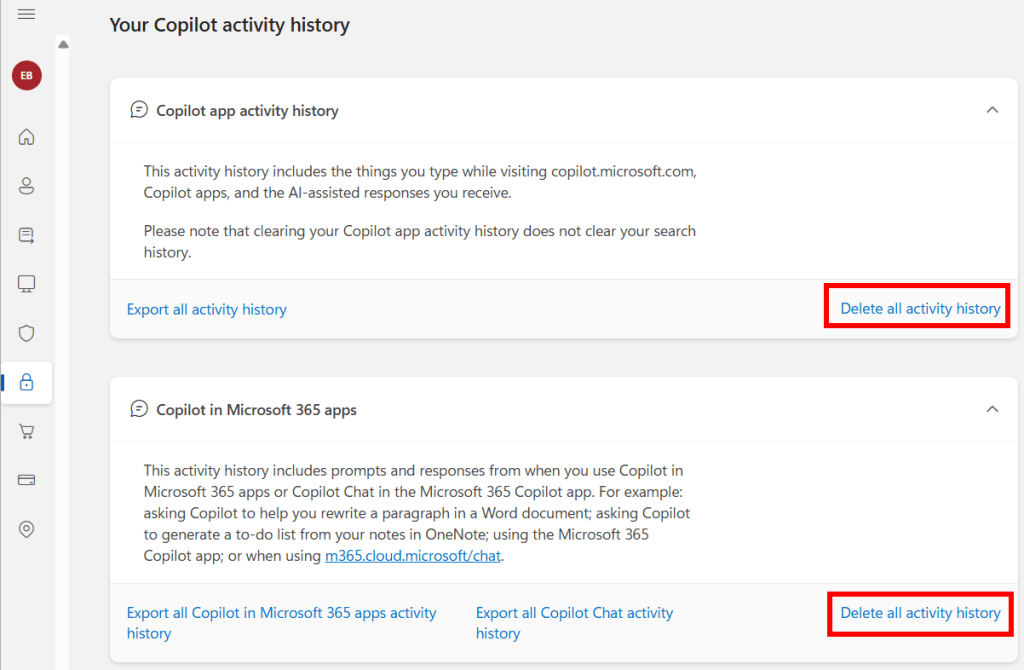

- Klik på Eksportér eller slet historik. Dette vil åbne en browserside, hvor De skal logge ind med den Microsoft-konto, De bruger til Copilot.

- Vælg Slet al aktivitetshistorik for hver af disse kategorier:

- Aktivitetshistorik for Copilot-appen

- Copilot i Microsoft 365-apps

- Copilot i Windows-apps

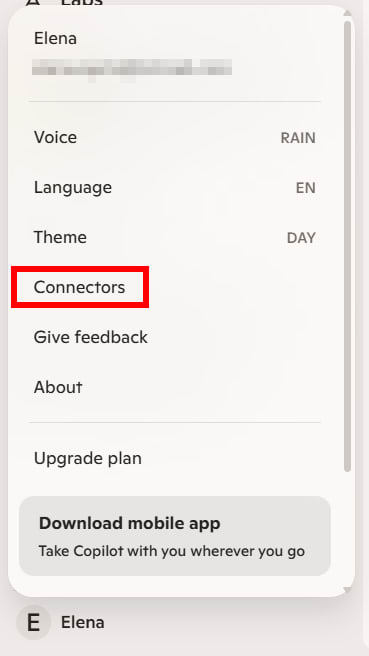

- Vælg Deres profilnavn eller billede → Forbindelser.

- Slå alt fra, inklusive OneDrive, Outlook, Gmail, Google Drev og Google Kalender.

Bemærk, at hvis Deres data allerede er blevet brugt til modeltræning, er der ingen måde at fortryde det på.

Sådan deaktiverer De Gaming Copilot-modeltræning

- På Windows, tryk på Win + G for at åbne Game Bar.

- Gå til Indstillinger → Privatlivsindstillinger → Gaming Copilot.

- Slå Modeltræning på tekst fra.

- For at skjule Gaming Copilot-widgetten, fjern den fra Game Bar-widgetlisten.

I øjeblikket er der ingen måde at fjerne Gaming Copilot fuldstændigt fra Xbox Game Bar. Desuden kan De ikke forhindre den i at bruge Deres stemmeinteraktioner til at hjælpe med at træne sine AI-modeller. Hvis De bekymrer Dem om privatliv, er det sikrest ikke at interagere med Gaming Copilot overhovedet.

Sådan sletter De Deres Copilot-konto

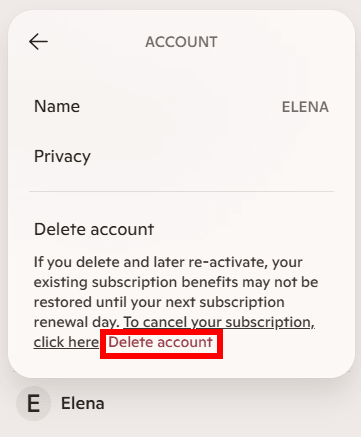

I Copilot-webappen, vælg Deres profilnavn eller billede → Deres konto → Slet konto.

Sletning af Deres Copilot-konto sletter ikke Deres Microsoft-konto, og De kan stadig bruge Copilot uden at logge ind.

Hvis De hellere vil undgå at stole på Copilot overhovedet, kan De overveje at skifte til en AI-assistent til privatliv(nyt vindue), der aldrig logger Deres data, bruger dem til modeltræning eller deler dem med tredjeparter.

Hvad er Microsoft Copilot?

Copilot er Microsofts linje af AI-assistenter integreret på tværs af deres produkter og tjenester, såsom Word, Excel, PowerPoint, Outlook, Teams og Windows. Den bruger store sprogmodeller (LLM’er) baseret på Microsofts egne AI-teknologier og OpenAI’s GPT’er — som GPT-4o, den samme der driver ChatGPT.

Ligesom LLM’er kan Copilot hjælpe Dem med at være mere produktiv, kreativ og effektiv ved at forstå prompter i naturligt sprog, analysere data, generere og opsummere indhold og give forslag baseret på kontekst.

Microsoft leverer Copilot i flere versioner, afhængigt af om De bruger den personligt eller professionelt, herunder:

- Microsoft Copilot — en gratis personlig AI-assistent til hverdagsopgaver. Den er tilgængelig som en Windows 11-app (installeret som standard), en webapp og en macOS-app.

- Gaming Copilot — en gratis personlig AI-assistent til Windows-gaming, som tager skærmbilleder for at forstå, hvad der sker i et spil, og tilbyde tips, ligesom hvordan Recall tager snapshots af din skrivebordsaktivitet.

- Microsoft 365 Copilot — integreres i Word, Excel, PowerPoint, Outlook og Teams for at bruge Deres data via Microsoft Graph, en platform der forbinder Deres data som e-mails, kalender og dokumenter.

Hvad er risiciene for privatlivet ved Microsoft Copilot?

Microsoft opretholder stærke beskyttelser af privatliv for Copilot i virksomhedsmiljøer såsom Microsoft 365, men forbrugerkonti står over for en meget anden virkelighed(nyt vindue):

Deres data kan blive brugt til annoncer og profilering

Copilot-tjenester i Microsoft-forbrugerkonti er forbundet til Microsofts annonceøkosystem. Det betyder, at Deres interaktioner kan påvirke de annoncer og anbefalinger, De ser. For eksempel, hvis De spørger Copilot om rejsetilbud, kan De måske senere se annoncer for fly eller hotel.

Selvom De kan slå personaliserede annoncer fra i Deres Microsoft-kontoprivatlivsindstillinger, beholder virksomheden stadig disse interaktionsdata og kan bruge dem i anonymiseret form til andre formål, såsom at forbedre annoncemålretning for andre Copilot-brugere med profiler, der ligner Deres.

De beholder ejerskab, men Microsoft kan stadig bruge Deres data

Selvom Microsoft siger, at De beholder ejerskabet af Deres indhold, betyder brug af Copilot, at De giver virksomheden brede rettigheder over det, herunder til at ”kopiere, distribuere, transmittere, offentligt vise, offentligt fremføre, redigere, oversætte og reformatere” Deres data, og til at videregive disse rettigheder til tredjeparter.

For eksempel, hvis De er en forfatter, der tilføjer uddrag fra en upubliceret historie i Copilot for at bede om korrekturlæsning eller stilistisk feedback, bliver den tekst teknisk set en del af det materiale, Microsoft har licens til at behandle og bruge under sine servicevilkår. Deres ikke-udgivne intellektuelle ejendom kan stadig blive brugt uden for Deres direkte kontrol, selvom det aldrig bliver offentligt.

Deres data kan blive behandlet og brugt til AI-træning

Data fra Deres Copilot-prompter og svar kan blive indsamlet, logget og analyseret af Microsoft til AI-træning. Der er ingen garanti for, at Deres følsomme eller personlige data vil blive udelukket fra træningsdatasæt.

Som med de fleste AI-assistenter har Copilot brug for enorme mængder information for at blive ved med at lære og forfine sine svar – selv når den proces kan bevæge sig ind i gråzoner for intellektuel ejendom. Et aktuelt eksempel er en række amerikanske retssager(nyt vindue) anlagt af forfattere og store nyhedsmedier, der hævder, at Microsoft og deres partner OpenAI brugte deres ophavsretligt beskyttede værker uden tilladelse til at træne AI-modeller som Copilot og ChatGPT. OpenAI har selv offentligt erkendt(nyt vindue), at det er “umuligt at træne nutidens førende AI-systemer uden brug af ophavsretligt beskyttet materiale.”

Folk kan se dine følsomme data

Microsoft-medarbejdere kan gennemgå dine inputs og outputs i Copilot – herunder alt, hvad du skriver eller uploader som vedhæftede filer – for at forbedre tjenesten, moderere skadeligt indhold, eller når du vælger at indsende feedback. Hvis tanken om det gør dig utilpas, bør du undgå at indtaste følsomme oplysninger, såsom personhenførbare data eller forretningshemmeligheder.

Forbindelser eksponerer dine data for tredjeparter

Forbindelser gør det muligt for Copilot at koble sig sammen med Microsoft-produkter (som OneDrive eller Outlook) og tredjepartstjenester (som Google Drev), så den kan trække information fra flere kilder. Hvis du for eksempel beder Copilot om at opsummere alle mødenotater gemt i Google Drev, vil den søge i dine filer på drevet og returnere et sammendrag.

Men når du aktiverer en forbindelse, tillader du også Copilot at udveksle oplysninger med den anden tjeneste. I Google Drevs tilfælde får Copilot adgang til dit drevs filstruktur, navne, tidsstempler og indhold, mens Google også modtager visse detaljer knyttet til din Microsoft-konto, såsom dit profilbillede, navn eller e-mailadresse. Dine værdifulde data lever nu i begge økosystemer (Microsoft og Google), hvilket skaber en tydeligere og mere komplet profil af dig på tværs af platforme.

Dine data kan krydse grænser under amerikansk jurisdiktion

Afhængigt af hvor du bor, kan Microsoft gemme dine Copilot-data og interaktioner i din region. For eksempel kan europæere få deres data gemt inden for EU. Men dine data bliver muligvis ikke altid der. På trods af virksomhedens forpligtelser vedrørende EU’s datagrænser(nyt vindue), kan en vis behandling stadig forekomme uden for din region af tekniske eller kapacitetsmæssige årsager. Og da Microsoft er en amerikansk virksomhed, er den underlagt amerikansk lovgivning såsom CLOUD Act, hvilket betyder, at amerikanske myndigheder kan anmode om adgang til dine data (uanset hvor de er gemt), nogle gange uden at kræve en dommerkendelse.

Microsoft overvåger Copilot-chatdata nøje

Microsoft analyserer Copilot-interaktioner i stor skala for at forstå, hvordan folk bruger assistenten over tid. I Copilot Usage Report 2025(nyt vindue) kiggede AI-forskere på 37,5 millioner Copilot-samtaler for at identificere brugsmønstre og bemærkede, at flere rapporter vil blive offentliggjort, efterhånden som flere data bliver tilgængelige. Microsoft er ikke den eneste virksomhed, der gør dette, da deres partner OpenAI også offentliggør data om forbrugerbrug(nyt vindue) for ChatGPT.

Microsoft siger, at disse data er blevet afidentificeret og reduceret til sammendrag på højt niveau, men det fjerner ikke privatlivsrisici helt. Forskning(nyt vindue) har gentagne gange vist, at angiveligt anonyme data ofte kan re-identificeres, når de kombineres med andre ting såsom tidsstempler, enhedskarakteristika eller lokationssignaler. Og fordi Copilot er bundet til et kontobaseret økosystem, der spænder over Windows, Microsoft 365, Bing, Edge og annoncetjenester, gør disse forbindelser på tværs af tjenester re-associering lettere over tid.

Derudover er det uklart, hvor længe de originale, identificerbare Copilot-samtaledata forbliver gemt før afidentificering, eller hvordan de beskyttes. Hvis rådata ligger på Microsofts servere, kan de være udsat for risici såsom uautoriseret adgang, trusler fra interne medarbejdere eller databrud.

Hvad er sikkerhedsrisiciene ved Microsoft Copilot?

Da Microsoft kan få adgang til i gennemsnit tre millioner følsomme dataposter(nyt vindue) for hver organisation, er det vigtigt at forstå de sikkerhedsrisici, det kan medføre, især hvis du planlægger at bruge det til din virksomhed:

- I juni 2025 opdagede forskere EchoLeak (CVE-2025-32711(nyt vindue)), en zero-click-sårbarhed i Microsoft 365 Copilot, der lod angribere stjæle data uden nogen brugerhandling. Ved at skjule ondsindede instruktioner og links i en normal e-mail kunne angribere narre Copilot til at følge disse kommandoer, tilgå disse links og sende dele af brugerens data til en ekstern server. Sårbarheden blev patchet, men det er et eksempel på, hvordan integration af AI-assistenter som Copilot i kernesystemer – og tildeling af bred adgang til e-mails, dokumenter og interne data – kan forvandle dem til interne trusler, hvis de manipuleres eller konfigureres forkert.

- I august 2024 opdagede et cybersikkerhedsfirma(nyt vindue) en kritisk fejl vedrørende informationsafsløring i Microsoft Copilot Studio, som tillod brugerdefinerede copilots at udnytte svage beskyttelser og opnå følsomme oplysninger (som servicetokens og databasenøgler) for at bevæge sig længere ind i et internt system. Microsoft har patchet problemet.

- I oktober 2025 afslørede sikkerhedsforskere(nyt vindue) en phishing-teknik kaldet CoPhish, der misbruger Microsoft Copilot Studio til at få ondsindede login-sider til at se fuldstændig legitime ud. Angribere kan oprette en Copilot Studio-agent, hvis login-knap omdirigerer ofre til en falsk OAuth-samtykkeside, og derefter dele agent-linket (hostet på et betroet Microsoft-domæne) for at lokke brugere til at give adgang. Når samtykke er givet, kan angriberen opnå tokens, der lader dem læse, skrive eller sende data såsom e-mails, chats, kalendere og noter. Microsoft arbejder stadig på dette problem.

Et privat alternativ til Copilot og Microsoft

Hvis du er utryg ved, hvor dybt Copilot er integreret i Windows, og hvor mange data Microsoft indsamler gennem deres AI-tjenester – men stadig ønsker bekvemmeligheden ved en AI-chatbot – kan du skifte til Lumo, vores private AI-assistent(nyt vindue). Lumo har hjemme i Europa og høster aldrig data, træner på dine data, viser dig reklamer, fører logs eller deler dine oplysninger med nogen.

Og hvis du er klar til at træde helt ud af Microsoft-økosystemet, kan du bygge dit eget private digitale arbejdsområde med vores krypterede økosystem. Du kan bruge:

- Proton Mail og Calendar for en sikker gratis e-mail og privat planlægning

- Proton Pass til sikker adgangskodehåndtering

- Proton Drive til krypteret cloud-lagerplads og fildeling

- Proton VPN til at beskytte din internettrafik(nyt vindue)

Hver eneste Proton-tjeneste er bygget til at beskytte dit privatliv som standard ved hjælp af end-to-end kryptering, så ingen andre end dig kan få adgang til dine data – ikke engang os.