Con el soporte de Windows 10 terminando oficialmente en octubre de 2025, muchos usuarios están actualizando a Windows 11 para mantenerse protegidos con actualizaciones de seguridad. Sin embargo, algunos pueden sorprenderse al encontrar un nuevo compañero de IA esperándolos: Copilot.

Posicionado como el esfuerzo más ambicioso de Microsoft en IA generativa, Copilot ahora está profundamente integrado en Windows 11, Edge, Bing y la suite Microsoft 365. Es la pieza central de la asociación multimillonaria de Microsoft con OpenAI (el creador de ChatGPT y ChatGPT Atlas), cuyos modelos GPT impulsan la inteligencia de Copilot. Combinado con el lanzamiento de las PC Copilot+, equipadas con una tecla Copilot dedicada, todo esto muestra cuán serio es Microsoft sobre dirigir Windows hacia un futuro impulsado por IA.

Sin embargo, no todos dan la bienvenida a este ayudante siempre presente, que recuerda a Clippy pero mucho más persistente. La estrecha integración de Copilot plantea preocupaciones de privacidad y seguridad, muy parecidas a cuando LinkedIn, propiedad de Microsoft, comenzó a entrenar IA utilizando perfiles públicos y datos de actividad, o cuando el plan de Google de incrustar profundamente su asistente de IA Gemini en Android para reemplazar al Asistente de Google.

Solo los usuarios empresariales de Microsoft 365 y los administradores de TI pueden eliminar completamente Copilot de Windows 11. En todos los demás casos, como usuarios con suscripciones personales o familiares, o sin ninguna suscripción a Microsoft 365, solo hay formas de limitar sus funciones y atenuar su visibilidad.

- Cómo desactivar Copilot AI

- Cómo eliminar Microsoft 365 Copilot (suscripción empresarial)

- Cómo desactivar Microsoft 365 Copilot (suscripción personal o familiar)

- Cómo ocultar los iconos de Copilot en Windows 11

- Cómo desactivar las funciones de datos y personalización en la aplicación web de Copilot

- Cómo desactivar el entrenamiento de modelos de Gaming Copilot

- Cómo eliminar su cuenta de Copilot

- ¿Qué es Microsoft Copilot?

- ¿Cuáles son los riesgos de privacidad de Microsoft Copilot?

- ¿Cuáles son los riesgos de seguridad de Microsoft Copilot?

- Una alternativa privada a Copilot y Microsoft

Cómo desactivar Copilot AI

Dependiendo de cómo use Copilot, aquí le mostramos cómo puede eliminarlo de su computadora, ajustar sus configuraciones o reducir su presencia:

Cómo eliminar Microsoft 365 Copilot (suscripción empresarial)

Si es un usuario empresarial, vaya a Ajustes → Aplicaciones → Aplicaciones instaladas, seleccione Copilot y haga clic en Desinstalar.

Los administradores de TI pueden eliminar la aplicación Copilot utilizando el siguiente comando en PowerShell:

$packageFullName = Get-AppxPackage -Name "Microsoft.Copilot" | Select-Object -ExpandProperty PackageFullName

Remove-AppxPackage -Package $packageFullName

Cómo desactivar Microsoft 365 Copilot (suscripción personal o familiar)

- Abra cualquier aplicación de Microsoft 365 (Word, Excel, PowerPoint o OneNote).

- Vaya a Archivo → Opciones → Copilot.

- Borre la casilla de verificación Activar Copilot.

Repita estos pasos para cada aplicación de Microsoft en la que quiera desactivar Copilot.

Si el ajuste Activar Copilot no existe en ninguna de las aplicaciones de Microsoft:

- Abra Word, Excel, PowerPoint o OneNote.

- Vaya a Archivo → Cuenta → Privacidad de la cuenta → Gestionar ajustes → Experiencias conectadas.

- Borre la casilla de verificación Activar experiencias que analizan su contenido.

- Reinicie la aplicación.

Solo necesita hacer esto una vez, ya que el nuevo ajuste de privacidad se aplicará automáticamente en todas las aplicaciones de Microsoft 365 vinculadas a su cuenta.

Cómo ocultar los íconos de Copilot en Windows 11

Puede desactivar los íconos de Copilot en Windows, pero no puede borrar la función completamente de su computadora. Estos pasos solo desactivan los elementos visuales y de personalización de Copilot, por lo que aún podrá acceder a la aplicación.

Para ocultar el botón de Copilot de su barra de tareas:

- Vaya a Ajustes → Personalización → Barra de tareas.

- Busque y desactive Copilot.

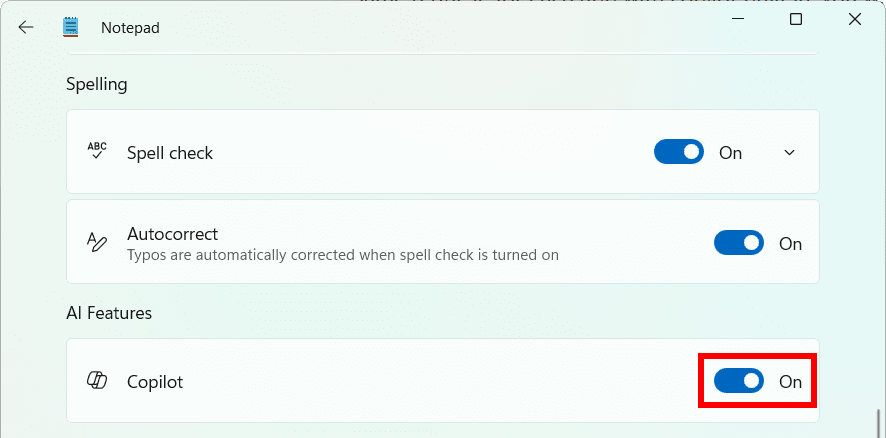

Si utiliza aplicaciones que tienen Copilot integrado, deberá desactivarlo por separado en cada aplicación. Por ejemplo, en el Bloc de notas, vaya a Ajustes → Funciones de IA y desactive Copilot.

- Reinicie su computadora para que los cambios surtan efecto.

Cómo desactivar las funciones de datos y personalización en la aplicación web de Copilot

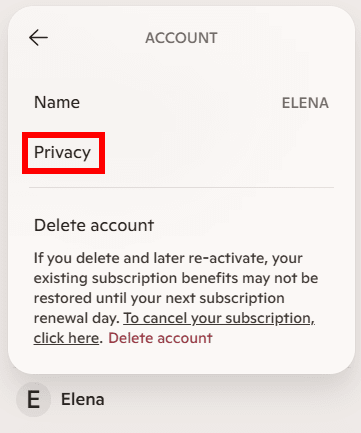

- Seleccione su nombre de perfil o foto → su cuenta → Privacidad.

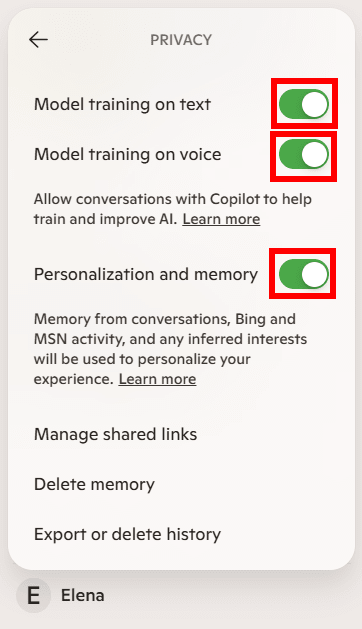

- Desactive las siguientes opciones:

- Entrenamiento de modelos con texto

- Entrenamiento de modelos con voz

- Personalización y memoria

- Seleccione Eliminar memoria para borrar inmediatamente lo que Copilot recuerda sobre usted.

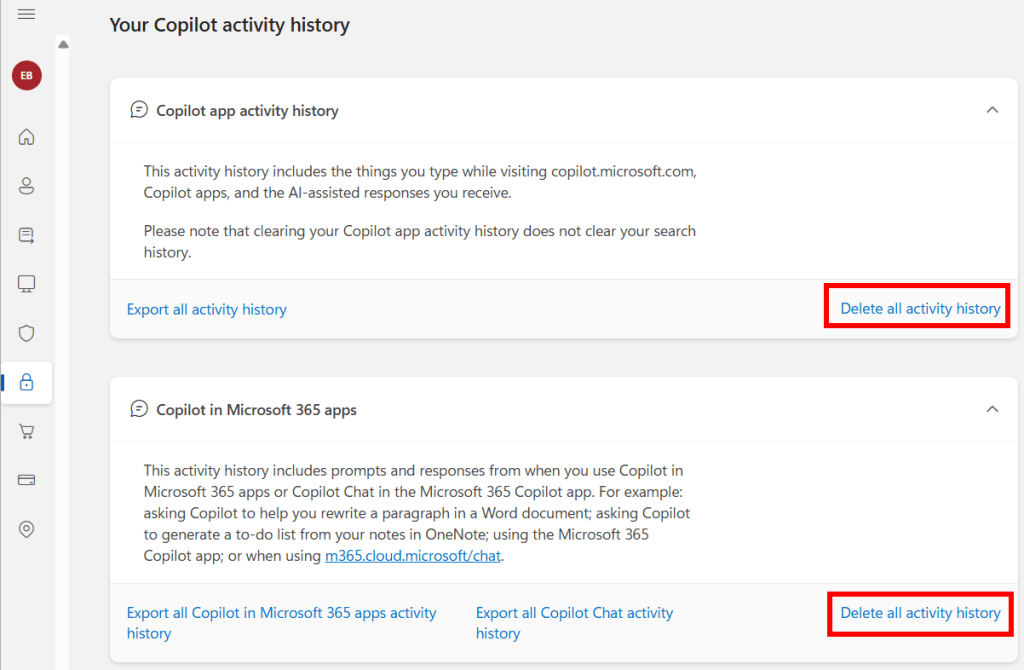

- Haga clic en Exportar o eliminar historial. Esto abrirá una página del navegador donde deberá iniciar sesión con la cuenta de Microsoft que utiliza para Copilot.

- Seleccione Eliminar todo el historial de actividad para cada una de estas categorías:

- Historial de actividad de la aplicación Copilot

- Copilot en las aplicaciones de Microsoft 365

- Copilot en las aplicaciones de Windows

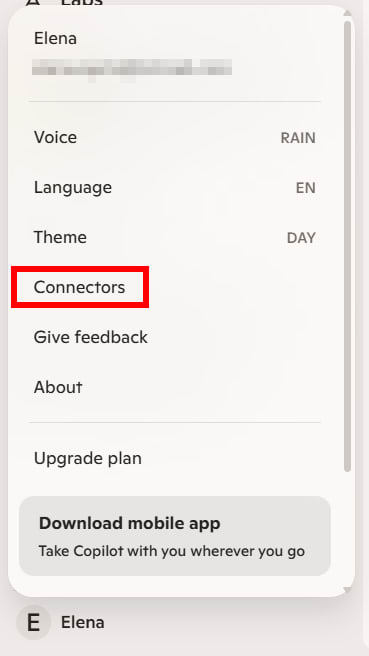

- Seleccione su nombre de perfil o foto → Conectores.

- Desactive todo, incluidos OneDrive, Outlook, Gmail, Google Drive y el Calendario de Google.

Tenga en cuenta que si sus datos ya se han utilizado para el entrenamiento de modelos, no hay forma de deshacerlo.

Cómo desactivar el entrenamiento de modelos de Gaming Copilot

- En Windows, presione Win + G para abrir la Game Bar.

- Vaya a Ajustes → Ajustes de privacidad → Gaming Copilot.

- Desactive Entrenamiento de modelos con texto.

- Para ocultar el widget de Gaming Copilot, bórrelo de la lista de widgets de la Game Bar.

Actualmente, no hay forma de borrar completamente Gaming Copilot de la Xbox Game Bar. Además, no puede evitar que utilice sus interacciones de voz para ayudar a entrenar sus modelos de IA. Si le importa la privacidad, lo más seguro es no interactuar con Gaming Copilot en absoluto.

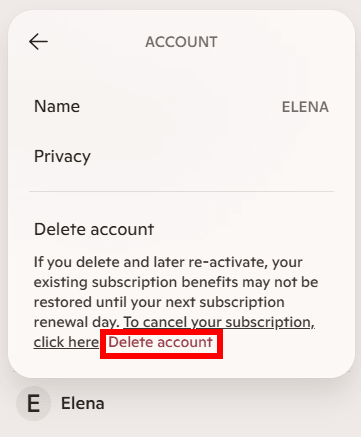

Cómo eliminar su cuenta de Copilot

En la aplicación web de Copilot, seleccione su nombre de perfil o foto → su cuenta → Eliminar cuenta.

Eliminar su cuenta de Copilot no elimina su cuenta de Microsoft, y aún puede utilizar Copilot sin iniciar sesión.

Si prefiere no depender de Copilot en absoluto, considere cambiar a un asistente de IA de privacidad(nueva ventana) que nunca registra sus datos, los utiliza para el entrenamiento de modelos ni los comparte con terceros.

¿Qué es Microsoft Copilot?

Copilot es la línea de asistentes de IA de Microsoft integrados en sus productos y servicios, como Word, Excel, PowerPoint, Outlook, Teams y Windows. Utiliza grandes modelos de lenguaje (LLM) basados en las propias tecnologías de IA de Microsoft y los GPT de OpenAI, como GPT-4o, el mismo que impulsa ChatGPT.

Al igual que los LLM, Copilot puede ayudarlo a ser más productivo, creativo y eficiente al comprender instrucciones en lenguaje natural, analizar datos, generar y resumir contenido, y proporcionar sugerencias basadas en el contexto.

Microsoft proporciona Copilot en varias versiones, dependiendo de si lo utiliza de forma personal o profesional, incluyendo:

- Microsoft Copilot: un asistente personal de IA gratuito para tareas cotidianas. Está disponible como una aplicación de Windows 11 (instalada por defecto), una aplicación web y una aplicación de macOS.

- Gaming Copilot: un asistente personal de IA gratuito para juegos en Windows, que toma capturas de pantalla para entender qué está sucediendo en un juego y ofrecer consejos, similar a cómo Recall toma instantáneas de su actividad de escritorio.

- Microsoft 365 Copilot: se integra en Word, Excel, PowerPoint, Outlook y Teams para usar sus datos a través de Microsoft Graph, una plataforma que conecta sus datos como correos electrónicos, calendario y documentos.

¿Cuáles son los riesgos de privacidad de Microsoft Copilot?

Microsoft mantiene fuertes protecciones de privacidad para Copilot en ajustes empresariales como Microsoft 365, pero las cuentas de consumidor enfrentan una realidad muy diferente(nueva ventana):

Sus datos pueden ser utilizados para anuncios y elaboración de perfiles

Los servicios de Copilot en las cuentas de consumidor de Microsoft están conectados al ecosistema publicitario de Microsoft. Esto significa que sus interacciones pueden influir en los anuncios y recomendaciones que ve. Por ejemplo, si le pregunta a Copilot sobre ofertas de viaje, es posible que más tarde vea anuncios de vuelos u hoteles.

Aunque puede desactivar los anuncios personalizados en los ajustes de privacidad de su cuenta de Microsoft, la empresa aún conserva esos datos de interacción y puede usarlos de forma anónima para otros fines, como mejorar la segmentación de anuncios para otros usuarios de Copilot con perfiles similares a los suyos.

Usted conserva la propiedad, pero Microsoft aún puede usar sus datos

Aunque Microsoft dice que usted conserva la propiedad de su contenido, usar Copilot significa que otorga a la empresa amplios derechos sobre él, incluyendo “copiar, distribuir, transmitir, mostrar públicamente, ejecutar públicamente, editar, traducir y reformatear” sus datos, y transferir esos derechos a terceros.

Por ejemplo, si es un escritor que agrega extractos de una historia inédita en Copilot para pedir corrección de pruebas o comentarios estilísticos, ese texto técnicamente se convierte en parte del material que Microsoft tiene licencia para procesar y usar bajo sus términos de servicio. Su propiedad intelectual no publicada aún puede ser utilizada fuera de su control directo, incluso si nunca se hace pública.

Sus datos pueden ser procesados y utilizados para el entrenamiento de IA

Los datos de sus instrucciones y respuestas de Copilot pueden ser recopilados, registrados y analizados por Microsoft para el entrenamiento de IA. No hay garantía de que sus datos confidenciales o personales sean excluidos de los conjuntos de datos de entrenamiento.

Al igual que con la mayoría de los asistentes de IA, Copilot necesita grandes cantidades de información para seguir aprendiendo y refinando sus respuestas, incluso cuando ese proceso puede derivar en zonas grises de propiedad intelectual. Un ejemplo actual es una serie de demandas en EE. UU.(nueva ventana) presentadas por autores y principales medios de comunicación que alegan que Microsoft y su socio OpenAI utilizaron sus obras protegidas por derechos de autor sin permiso para entrenar modelos de IA como Copilot y ChatGPT. La propia OpenAI ha reconocido públicamente(nueva ventana) que es “imposible entrenar los sistemas de IA líderes de hoy en día sin utilizar materiales protegidos por derechos de autor”.

Es posible que otras personas vean sus datos sensibles

Es posible que los empleados de Microsoft revisen sus entradas y salidas de Copilot (incluido todo lo que escriba o cargue como archivos adjuntos) para mejorar el servicio, moderar contenido dañino o cuando decida enviar comentarios. Si la idea le incomoda, debería evitar ingresar cualquier información sensible, como datos de identificación personal o secretos comerciales.

Los conectores exponen sus datos a terceros

Los conectores permiten que Copilot se vincule con productos de Microsoft (como OneDrive u Outlook) y servicios de terceros (como Google Drive), para que pueda extraer información de múltiples fuentes. Por ejemplo, si le pide a Copilot que resuma todas las notas de reuniones almacenadas en Google Drive, buscará en sus archivos de Drive y devolverá un resumen.

Pero cuando activa un conector, también está permitiendo que Copilot intercambie información con ese otro servicio. En el caso de Google Drive, mientras que Copilot obtiene acceso a la estructura de archivos, nombres, marcas de tiempo y contenidos de su Drive, Google también recibe ciertos detalles asociados con su cuenta de Microsoft, como su foto de perfil, nombre o dirección de correo electrónico. Sus datos valiosos ahora viven en ambos ecosistemas (Microsoft y Google), creando un perfil más claro y completo de usted a través de las plataformas.

Sus datos pueden cruzar fronteras bajo la jurisdicción de EE. UU.

Dependiendo de dónde viva, Microsoft puede almacenar sus datos e interacciones de Copilot en su región. Por ejemplo, es posible que los europeos tengan sus datos almacenados dentro de la UE. Pero sus datos no siempre permanecen allí. A pesar de los compromisos de la Frontera de Datos de la UE(nueva ventana) de la compañía, aún puede ocurrir cierto procesamiento fuera de su región debido a razones técnicas o de capacidad. Y debido a que Microsoft es una empresa estadounidense, está sujeta a leyes de EE. UU. como la Ley CLOUD, lo que significa que las autoridades estadounidenses podrían solicitar acceso a sus datos (sin importar dónde estén almacenados), a veces sin requerir una orden judicial.

Microsoft monitorea de cerca los datos de chat de Copilot

Microsoft analiza las interacciones de Copilot a escala para entender cómo la gente usa el asistente a lo largo del tiempo. En el Informe de uso de Copilot 2025(nueva ventana), los investigadores de IA examinaron 37,5 millones de conversaciones de Copilot para identificar patrones de uso, señalando que se publicarán más informes a medida que haya más datos disponibles. Microsoft no es la única empresa que hace esto, ya que su socio OpenAI también publica datos de uso del consumidor(nueva ventana) para ChatGPT.

Microsoft dice que estos datos fueron desidentificados y reducidos a resúmenes de alto nivel, pero eso no elimina los riesgos de privacidad por completo. Las investigaciones(nueva ventana) han demostrado repetidamente que los datos supuestamente anónimos a menudo pueden ser reidentificados cuando se combinan con otras cosas, como marcas de tiempo, características del dispositivo o señales de ubicación. Y debido a que Copilot está vinculado a un ecosistema basado en cuentas que abarca Windows, Microsoft 365, Bing, Edge y servicios de publicidad, esas conexiones entre servicios facilitan la reasociación con el tiempo.

Además, no está claro cuánto tiempo permanecen almacenados los datos originales e identificables de la conversación de Copilot antes de la desidentificación, o cómo se protegen. Si los datos brutos residen en los servidores de Microsoft, pueden estar expuestos a riesgos como acceso no autorizado, amenazas internas o vulneraciones de datos.

¿Cuáles son los riesgos de seguridad de Microsoft Copilot?

Dado que Microsoft puede acceder a un promedio de tres millones de registros de datos sensibles(nueva ventana) por cada organización, es importante entender los riesgos de seguridad que puede introducir, especialmente si planea usarlo para su negocio:

- En junio de 2025, investigadores descubrieron EchoLeak (CVE-2025-32711(nueva ventana)), una vulnerabilidad de cero clics en Microsoft 365 Copilot que permitía a los atacantes robar datos sin ninguna acción del usuario. Al ocultar instrucciones maliciosas y enlaces dentro de un correo electrónico normal, los atacantes podían engañar a Copilot para que siguiera esos comandos, accediendo a esos enlaces y enviando partes de los datos del usuario a un servidor externo. La vulnerabilidad fue parcheada, pero es un ejemplo de cómo integrar asistentes de IA como Copilot en sistemas centrales (y darles amplio acceso a correos electrónicos, documentos y datos internos) puede convertirlos en amenazas internas si son manipulados o mal configurados.

- En agosto de 2024, una firma de ciberseguridad(nueva ventana) descubrió un fallo crítico de divulgación de información en Microsoft Copilot Studio, que permitía a los copilotos personalizados explotar protecciones débiles y obtener información sensible (como tokens de servicio y claves de base de datos) para moverse más adentro de un sistema interno. Microsoft parchó el problema.

- En octubre de 2025, investigadores de seguridad(nueva ventana) descubrieron una técnica de suplantación llamada CoPhish que abusa de Microsoft Copilot Studio para hacer que las páginas de inicio de sesión maliciosas parezcan completamente legítimas. Los atacantes pueden crear un agente de Copilot Studio cuyo botón de inicio de sesión redirige a las víctimas a una página de consentimiento OAuth falsa, luego compartir el enlace del agente (alojado en un dominio de confianza de Microsoft) para atraer a los usuarios para conceder acceso. Una vez dado el consentimiento, el atacante puede obtener tokens que le permiten leer, escribir o enviar datos, como correos electrónicos, chats, calendarios y notas. Microsoft todavía está trabajando en este problema.

Una alternativa privada a Copilot y Microsoft

Si se siente intranquilo sobre cuán profundamente está integrado Copilot en Windows y cuántos datos recolecta Microsoft a través de sus servicios de IA (pero aún desea la comodidad de un chatbot de IA), cámbiese a Lumo, nuestro asistente de IA privado(nueva ventana). Alojado en Europa, Lumo nunca recolecta ni entrena con sus datos, le muestra anuncios, guarda registros ni comparte su información con nadie.

Y si está listo para salir del ecosistema de Microsoft por completo, puede construir su propio espacio de trabajo digital privado con nuestro ecosistema cifrado. Puede usar:

- Proton Mail y Calendar para un correo electrónico gratuito seguro y programación privada

- Proton Pass para una gestión de contraseñas segura

- Proton Drive para almacenamiento en nube e intercambio de archivos cifrado

- Proton VPN para proteger su tráfico de internet(nueva ventana)

Cada servicio de Proton está construido para proteger su privacidad por defecto, usando cifrado de extremo a extremo, para que nadie más que usted pueda acceder a sus datos (ni siquiera nosotros).