ChatGPT to potężny asystent AI(nowe okno), z którego codziennie korzystają miliony użytkowników codziennie, ale czy jest on bezpieczny w użyciu? Jest własnością i jest obsługiwany przez firmę OpenAI, jedną z największych firm technologicznych na świecie. Podobnie jak wiele platform Big Tech, OpenAI gromadzi ogromne ilości danych użytkowników. Dane te nie są chronione szyfrowaniem zero-access, więc firma może je udostępnić partnerom biznesowym (w tym firmom reklamowym i analitycznym), rządowi oraz hakerom w przypadku naruszenia danych.

Za kulisami duże modele językowe (LLM) firmy OpenAI nieustannie uczą się na podstawie tego, co wpisujesz. Wrażliwe pytania, takie jak te dotyczące objawów zdrowotnych, kwestii prawnych lub własności intelektualnej, mogą trafiać do złożonych systemów profilowania lub pomagać w trenowaniu modeli AI wykorzystywanych w celach daleko wykraczających poza Twoje pierwotne intencje.

Obawy o to, jak firmy z branży sztucznej inteligencji traktują dane użytkowników, rosną. W marcu 2026 r. ponad 2,5 miliona użytkowników(nowe okno) zadeklarowało odejście z ChatGPT po tym, jak kontrowersyjna współpraca z rządem USA wzbudziła pytania o to, jak systemy AI są wdrażane i zarządzane. Przypomina to o tym, że wchodząc w interakcję z asystentem AI bez silnej ochrony prywatności, możesz udostępniać więcej informacji, niż zdajesz sobie sprawę.

- Czy ChatGPT jest bezpieczny? Ryzyka korzystania z AI takich jak ChatGPT i innych z sektora Big Tech

- Rzeczy, których nigdy nie powinieneś udostępniać ChatGPT

- Jak zachować bezpieczeństwo podczas korzystania z ChatGPT

- Zmień asystenta na prywatnego asystenta AI

Czy ChatGPT jest bezpieczny? Ryzyko korzystania z AI takich jak ChatGPT i innych z sektora Big Tech

Przed wyborem narzędzi AI, takich jak ChatGPT, Gemini, Meta AI, Copilot i DeepSeek, warto zrozumieć ich bezpieczeństwo oraz ryzyka dla prywatności:

| Ryzyko | Potencjalny wpływ | Dlaczego to ma znaczenie |

| Gromadzenie i logowanie danych | Wprowadzane zapytania, przesłane pliki i wzorce interakcji mogą być przechowywane | Mogą być używane do trenowania AI, profilowania behawioralnego lub przeglądu przez ludzi |

| Brak szyfrowania zero-access | OpenAI i jego partnerzy mogą mieć dostęp do wątków | Zwiększa ryzyko ujawnienia wrażliwych danych |

| Kwestie prawne i własności intelektualnej | Naruszenie przepisów GDPR/HIPAA lub wyciek zastrzeżonych danych | Odpowiedzialność prawna i konsekwencje finansowe |

| System o zamkniętym kodzie źródłowym | Ograniczona przejrzystość przetwarzania danych | Wymaga zaufania do OpenAI |

| Reklamy w aplikacji | Zwiększone śledzenie i profilowanie | Niejasne, w jaki sposób dane z czatu wpływają na spersonalizowane reklamy |

Prywatność osobista

Oto co ryzykujesz, korzystając z ChatGPT:

- ChatGPT może gromadzić informacje, które wpiszesz — takie jak pytania, odpowiedzi i sposób Twojej interakcji z narzędziem — aby szkolić swoje modele sztucznej inteligencji. Jeśli prześlesz CV, dokument prawny, raport medyczny lub inny plik z danymi osobowymi, te treści również mogą być przechowywane i przetwarzane.

- Nawet jeśli nigdy nie wpiszesz swojego imienia i nazwiska ani innych danych osobowych, z czasem Twoje zapytania mogą ujawnić pewne wzorce, takie jak problemy zdrowotne, wątpliwości religijne, poglądy polityczne, status rodzinny czy stan emocjonalny. W połączeniu z Twoim adresem IP(nowe okno) i innymi identyfikatorami technicznymi wzorce te mogą zostać użyte do zbudowania szczegółowych profili behawioralnych.

- Możesz zrezygnować z bycia częścią szkolenia sztucznej inteligencji, ale Twoje wątki wciąż trafiają w logi, a wrażliwe szczegóły mogą zostać wyświetlone przez weryfikatorów, jeśli zostaną oflagowane, na przykład gdy zostawisz opinię.

- Historia Twojego czatu jest chroniona, gdy jest wysyłana i kiedy informacje są przechowywane, ale nie jest objęta szyfrowaniem zero-access, więc OpenAI lub osoby trzecie mogą nadal uzyskać dostęp do Twoich wcześniejszych wątków.

- W lipcu 2025 r. tysiące wątków udostępnionych przez ChatGPT pojawiło się w wynikach wyszukiwania Google(nowe okno), ujawniając wysoce osobistą korespondencję, o której użytkownicy prawdopodobnie sądzili, że jest całkowicie prywatna. OpenAI wkrótce wycofało tę funkcję i oświadczyło, że współpracuje z Google w celu wyindeksowania wyników. Ten incydent podkreśla jednak, jak łatwo interakcje z AI mogą trafić do domeny publicznej bez Twojej wiedzy.

- Na początku 2026 r. OpenAI wprowadziło reklamy dla użytkowników ChatGPT w darmowym planie oraz planie ChatGPT Go. Pomimo zapewnień, że reklamy nie wpłyną na odpowiedzi ani nie będą wiązały się z udostępnianiem danych osobowych reklamodawcom, ruch ten wpisuje się w utrwalony schemat działań firm typu Big Tech, w których wprowadzanie reklam w końcu staje się normą mimo początkowych obaw o prywatność.

Ryzyko biznesowe

OpenAI to firma z siedzibą w USA, więc korzystanie z ChatGPT może budzić obawy dotyczące ochrony danych oraz stwarzać ryzyko wycieku wrażliwych informacji. Jeśli mieszkasz w Europie lub w innym miejscu, Twoje dane nadal mogą podlegać jurysdykcji USA, ponieważ są przetwarzane przez tamtejszą firmę. Oto, co to oznacza:

- Bez silnych gwarancji ochrony danych Twoja organizacja naraża się na kary pieniężne i kontrole organów nadzorczych na podstawie takich przepisów jak GDPR i HIPAA(nowe okno).

- Szkoląc modele sztucznej inteligencji na danych Twojej firmy, narażasz się na ryzyko wycieków. Przykładowo, pracownicy mogą wpisać zastrzeżony kod, poufne umowy lub informacje o kliencie do ChatGPT, co może doprowadzić do ujawnienia własności intelektualnej, tajemnic handlowych lub danych klientów.

- OpenAI może udostępniać dane partnerom, dostawcom, innym osobom trzecim lub poprzez integracje przez aplikacje, z czym mogą wiązać się słabsze metody ochrony prywatności czy inne zasady przetwarzania danych. W 2025 r. naruszenie z udziałem jednego z dostawców analitycznych OpenAI ujawniło informacje identyfikacyjne klientów używających interfejs API.

- Na mocy praw USA, takich jak Patriot Act czy FISA (Foreign Intelligence Surveillance Act), firmy mogą zostać prawnie zmuszone do przekazywania danych agencjom rządowym, często z objęciem nakazem zachowania tajności, który uniemożliwia firmie powiadomienie użytkowników.

Brak przejrzystości

Powyższe to znane ryzyka. Prawdziwe niebezpieczeństwo ChatGPT (oraz innych rodzajów oprogramowania o zamkniętym kodzie źródłowym) wynika z tego, czego użytkownik nie może się dowiedzieć.

- Kod aplikacji ChatGPT nie ma formatu otwartego kodu źródłowego, przez co brak publicznego nadzoru nad tym, w jaki sposób działa aplikacja, co wpada w jej logi i w jaki sposób od kuchni przetwarza Twoje dane. Musisz polegać na zasadach udostępnionych przez OpenAI i po prostu ufać, że system przetwarza Twoje dane w sposób odpowiedzialny.

- Chociaż OpenAI wypuściło modele typu open-weight, które można publicznie analizować, to same modele sztucznej inteligencji używane przez ChatGPT nie opierają się na technologii o otwartym kodzie źródłowym, więc nie masz możliwości sprawdzenia, w jaki sposób dane były wcześniej szkolone przy użyciu olbrzymich zbiorów.

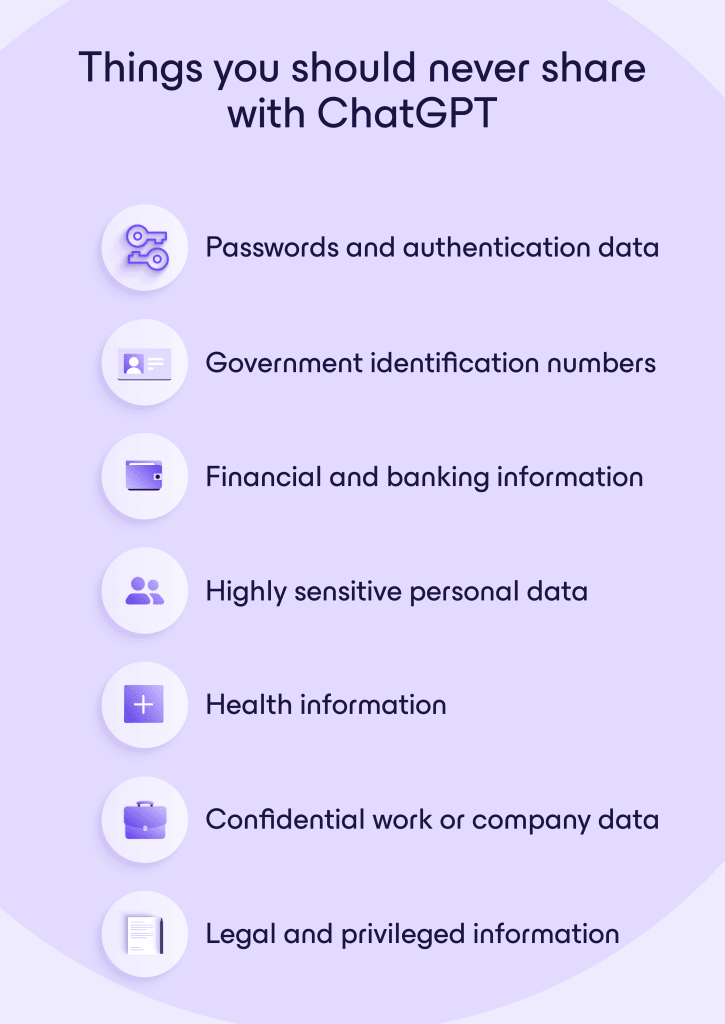

Czego nigdy nie udostępniać ChatGPT

Chociaż aplikacja ChatGPT może być bardzo pomocna, to w żadnym wypadku nie powinieneś traktować jej jako wyjątkowo bezpiecznego sejfu dla poufnych informacji. Nigdy nie wpisuj do niej żadnych informacji, które w przypadku, gdy będą przechowywane, nadzorowane lub zostaną przypadkiem ujawnione, mogłyby zaszkodzić Tobie, Twojej firmie lub innym:

Hasła i dane do uwierzytelniania, czyli np. hasła przypisane do Twojego konta, kody uwierzytelniania dwustopniowego (2FA), kody uwierzytelniania tworzone jako kopia zapasowa czy prywatne klucze dla interfejsu API.

Rządowe numery służące identyfikacji, co obejmuje numer Ubezpieczenia Społecznego, krajowy numer dowodu osobistego, paszport, prawo jazdy czy numery używane do identyfikacji w urzędach podatkowych.

Informacje dotyczące Twoich finansów czy działań bankowych, do których należą m.in. numery Twoich kart kredytowych lub debetowych, numery IBAN, dane logowania do bankowości online, dane z funkcją zaloguj się dla konta inwestycyjnego czy klucze prywatne Twojego portfela w kryptowalucie Bitcoin.

Wysoce wrażliwe dane osobowe, które mogą umożliwić identyfikację lub śledzenie Ciebie i Twojej rodziny, w tym domowy adres, numer telefonu, data urodzenia czy prywatne fotografie i dokumenty.

Informacje na temat Twojego zdrowia takie jak sprawozdania i raporty medyczne, dane dotyczące diagnoz, numery używane do ubezpieczeń, dowody tożsamości pacjentów czy dogłębna historia pacjenta przypisana do Twojej tożsamości.

Poufne dane pracownicze lub firmowe zawierające np. zastrzeżony własnościowo kod, dokumenty stanowiące o wewnętrznej strategii rynkowej, umowy ujęte klauzulą poufności, bazy danych konsumentów i klientów i ich szczególne szczegóły, prognozy rynkowe, wciąż nieopublikowane oświadczenia czy wszelkiego rodzaju umowy NDA.

Informacje poufne i objęte rygorem prawnym tak samo jak te poruszane podczas rozmów między prawnikiem i oskarżonym, a ponadto strategie dotyczące sporów sądowych, dowody rzeczowe i dokumentacyjne, czy dyskusje podczas prywatnych rozpraw ugody.

W jaki sposób zachować bezpieczeństwo, gdy używasz ChatGPT

Nie musisz w pełni unikać używania sztucznej inteligencji, ale na narzędzia z tej kategorii zawsze należy patrzeć przez pryzmat faktu, że są one raczej przeznaczone do użytku w celach publicznych, a nie by chronić czyjeś prywatne środowisko. Masz szansę obniżyć powiązane z tym ryzyko, jeżeli upewnisz się, że postępujesz w oparciu o pewne nieskomplikowane nawyki:

- Zadbaj o to, aby nigdy nie udostępniać informacji na tyle wrażliwych, że byłoby wysoce problematyczne, gdyby były one przechowywane, podglądane czy udostępniane dla podmiotów ze strefy publicznej.

- Usuń jakiekolwiek szczegóły mogące pozwolić na identyfikację albo użyj w ich miejsce zmiennych lub przykładowych wartości.

- Do tego rodzaju aplikacji prześlij wyłącznie te pliki, w których brak jakichkolwiek drażliwych lub poufnych danych.

- Korzystaj z usług komunikacyjnych opartych na AI w sposób podobny, z jakim traktujesz wsparcie czy wysyłanie wiadomości e-mail, tzn. pamiętaj, że prawdopodobnie ujrzy to ktoś jeszcze poza docelowym odbiorcą.

- Upewnij się co obejmują ustawienia prywatności i wyłącz te ustawienia, które zapisują historię z rozmów na czacie, pamięć czy trening i uczenie asystentów AI.

- Usuń wszelkie wątki, które już przestały mieć dla Ciebie jakiekolwiek zastosowanie, a tym samym drastycznie obniż ilość danych pozwalających na powiązanie z informacjami stanowiącymi Twoje konto.

Zmiana dostawcy na w pełni prywatnego asystenta AI

Jeżeli czujesz jakiekolwiek zmartwienia przed tym, by udostępniać osobiste dane albo zawiłości i klauzule Twojego biznesu narzędziom wykorzystującym AI, powinieneś spróbować Lumo. Z Lumo, prywatna alternatywa względem ChatGPT zyskuje całkiem nowe znaczenie. Ta usługa nigdy nie poddaje monitorowaniu w logach tego co piszesz w swoich wątkach, nie trenuje na nich też w żaden sposób wykorzystywanych przez siebie modeli maszynowych. Wszystkie dotyczące Cię dane są zabezpieczone rozwiązaniem obejmującym dwukierunkowe szyfrowanie asymetryczne (jest to odnoga z rodzaju metod w jakich zabezpieczają szyfrowania end-to-end). Dodatkowo Twoje dane trafiają do przetwarzania wyłącznie na europejski serwer, poddany rygorystycznym formom kontroli przez samo Proton.

Z chwilą, w jakiej wchodzisz na Lumo poprzez własne zarejestrowane konto Proton, wszystkie dostępne z jego poziomu wątki są chronione opartym o brak nadzoru osób trzecich szyfrowaniem z rodziny zero-access, co sprawia, że wyłącznie Ty masz jakiekolwiek szanse podglądu jako przeczytane wszystkiego tego o czym mówisz. Tyczy to się nawet samego Proton. Zaś gdy zechcesz upewnić się o swojej pełnej i nieskazitelnej prywatności, tryb ukrywania historii pozwoli Ci działać na narzędziach z Lumo bez ryzyka zebrania z tejże historii absolutnie czegokolwiek.

W oprogramowaniu Lumo funkcjonują typowe modele z gamy o otwartym kodzie źródłowym. W ten oto sposób nikt nie powstrzyma jakichkolwiek starań zebrania danych mających sprawdzić, czy ktokolwiek nie wykorzystał tam jakiegoś ukrytego programu skanującego informacje u źródła.

Wypróbuj Lumo i zobacz, jak wygląda AI, gdy Twoja prywatność liczy się najbardziej. A gdy zechcesz wdrożyć ten sam poziom prywatności do swojej firmy, usługi Lumo for Business pomogą zespołowi na bezpieczną i produktywną współpracę bez obaw o to, że poufne dane Twojej firmy będą zagrożone.

Możesz także pobrać aplikację Lumo ze sklepu Google Play(nowe okno) lub App Store(nowe okno).