ChatGPT è un potente assistente AI(nuova finestra) usato da milioni di utenti ogni giorno, ma è sicuro da usare? È di proprietà e gestito da OpenAI, una delle più grandi aziende tecnologiche al mondo. E come molte piattaforme Big Tech, OpenAI raccoglie grandi quantità di dati dell’utente. Tali dati non sono protetti con la crittografia ad accesso zero, quindi l’azienda può divulgarli ai partner commerciali (incluse le società pubblicitarie e di analisi), al governo e agli hacker in caso di un evento come una violazione dei dati.

Dietro le quinte, i grandi modelli linguistici (LLM) di OpenAI imparano costantemente da ciò che scrivi. Domande sensibili, come chiedere informazioni su sintomi di salute, questioni legali o proprietà intellettuale, possono alimentare complessi sistemi di profilazione o aiutare ad addestrare modelli AI usati ben oltre il tuo intento originale.

Crescono le preoccupazioni su come le aziende AI usano gli Handle per i dati dell’utente. Nel marzo 2026, oltre 2,5 milioni di utenti(nuova finestra) si sono impegnati a lasciare ChatGPT dopo che una controversa partnership con il governo degli Stati Uniti ha sollevato interrogativi su come i sistemi AI vengano distribuiti e governati. È un promemoria che, quando interagisci con un assistente AI senza forti protezioni per la privacy, potresti condividere più informazioni di quante te ne accorga.

- ChatGPT è sicuro? I rischi di usare AI come ChatGPT e altre Big Tech

- Cose che non dovresti mai condividere con ChatGPT

- Come stare al sicuro usando ChatGPT

- Passa a un assistente AI privato

ChatGPT è sicuro? I rischi di usare AI come ChatGPT e altre Big Tech

Prima di scegliere strumenti AI come ChatGPT, Gemini, Meta AI, Copilot e DeepSeek, vale la pena comprendere i loro rischi per la sicurezza e la privacy:

| Rischio | Impatto potenziale | Perché è importante |

| Raccolta dati e logging | Prompt, caricamenti di file e pattern di interazione potrebbero essere archiviati | Possono essere usati per l’addestramento dell’AI, la profilazione comportamentale o la revisione umana |

| Mancanza di crittografia ad accesso zero | OpenAI e i suoi partner potrebbero accedere alle conversazioni | Aumenta il rischio di esporre dati sensibili |

| Preoccupazioni normative e di proprietà intellettuale (IP) | Esposizione al GDPR/HIPAA o perdite di dati proprietari | Responsabilità legale e conseguenze finanziarie |

| Sistema closed-source | Trasparenza limitata nella gestione dei dati | Richiede fiducia in OpenAI |

| Annunci in-app | Maggiore tracciamento e profilazione | Non è chiaro come i dati delle chat influenzino gli annunci personalizzati |

Privacy personale

Ecco cosa rischi usando ChatGPT:

- ChatGPT potrebbe raccogliere le informazioni che inserisci, come domande, risposte e il modo in cui interagisci con lo strumento, per addestrare i suoi modelli AI. Se scegli di caricare un curriculum, un documento legale, un referto medico o un altro file con dati personali, anche quel contenuto potrebbe essere archiviato ed elaborato.

- Anche se non inserisci mai il tuo nome o altri dati personali, i tuoi prompt possono rivelare schemi nel tempo, come problemi di salute, dubbi religiosi, tendenze politiche, stato familiare o stato emotivo. Insieme al tuo indirizzo IP(nuova finestra) e ad altri identificatori tecnici, questi schemi possono essere usati per costruire profili comportamentali dettagliati.

- Potresti riuscire a disattivare l’addestramento dell’AI, ma le tue conversazioni vengono ancora salvate nei log e i dettagli sensibili potrebbero essere visti da revisori umani se vengono segnalati, ad esempio quando invii un feedback.

- La cronologia delle tue chat è protetta mentre viene inviata e archiviata, ma non è protetta con la crittografia ad accesso zero, quindi OpenAI o una terza parte possono ancora accedere alle tue conversazioni passate.

- Nel luglio 2025, migliaia di conversazioni ChatGPT che gli utenti hanno scelto di condividere sono apparse nei risultati di ricerca di Google(nuova finestra), esponendo scambi profondamente personali che gli utenti probabilmente presumevano fossero privati. OpenAI ha subito ritirato la funzionalità e ha affermato che stava collaborando con Google per deindicizzare i risultati, ma l’incidente evidenzia con quanta facilità le interazioni AI possano finire nel dominio pubblico senza che tu te ne accorga.

- All’inizio del 2026, OpenAI ha introdotto annunci per gli utenti di ChatGPT sui piani gratuiti e ChatGPT Go. Nonostante le rassicurazioni che gli annunci non influenzeranno le risposte né comporteranno la necessità di condividere i dati personali con gli inserzionisti, la mossa segue un modello ben consolidato di Big Tech in cui la pubblicità alla fine diventa la normalità dopo le iniziali preoccupazioni per la privacy.

Rischio aziendale

OpenAI è un’azienda statunitense, quindi usare ChatGPT può sollevare dubbi sulla protezione dei dati e sui rischi di perdite di informazioni sensibili. Se ti trovi in Europa o altrove, i tuoi dati potrebbero essere ancora soggetti alla giurisdizione degli Stati Uniti poiché vengono elaborati da un’azienda statunitense. Ecco cosa significa:

- Senza solide garanzie sulla protezione dei dati, la tua organizzazione rischia sanzioni o controlli normativi ai sensi di leggi come GDPR e HIPAA(nuova finestra).

- Rischi perdite di dati addestrando modelli AI sui dati aziendali. Ad esempio, i dipendenti potrebbero decidere di inserire codice proprietario, contratti riservati o informazioni sui clienti in ChatGPT, esponendo potenzialmente proprietà intellettuale, segreti commerciali o dati dei clienti.

- OpenAI potrebbe condividere i dati con partner, fornitori, altre terze parti o tramite integrazioni di app, che potrebbero avere protezioni della privacy più deboli o diverse Policy sui dati. Nel 2025, una violazione che ha coinvolto uno dei fornitori di analisi di OpenAI ha esposto le informazioni identificative sui clienti delle API.

- Secondo le leggi statunitensi come il Patriot Act o la FISA (Foreign Intelligence Surveillance Act), le aziende possono essere obbligate a fornire i dati alle agenzie governative, spesso con ordini di segretezza che impediscono loro di informare gli utenti.

Mancanza di trasparenza

Quelli sopra citati sono rischi noti. Ma ciò che è particolarmente rischioso riguardo a ChatGPT (e ad altri software closed source) è ciò che non ti è permesso sapere.

- Il codice delle app di ChatGPT non è open source, quindi non c’è supervisione pubblica su come funzioni, su cosa metta nei log o su come elabori i tuoi dati dietro le quinte. Devi affidarti alle Policy di OpenAI e avere fiducia che il sistema usi un Handle per i dati in modo responsabile.

- Sebbene OpenAI abbia rilasciato modelli a pesi aperti che possono essere esaminati pubblicamente, i modelli IA che ChatGPT utilizza non sono open source, quindi non puoi verificare come i dati siano stati pre-addestrati su set di dati di grandi dimensioni.

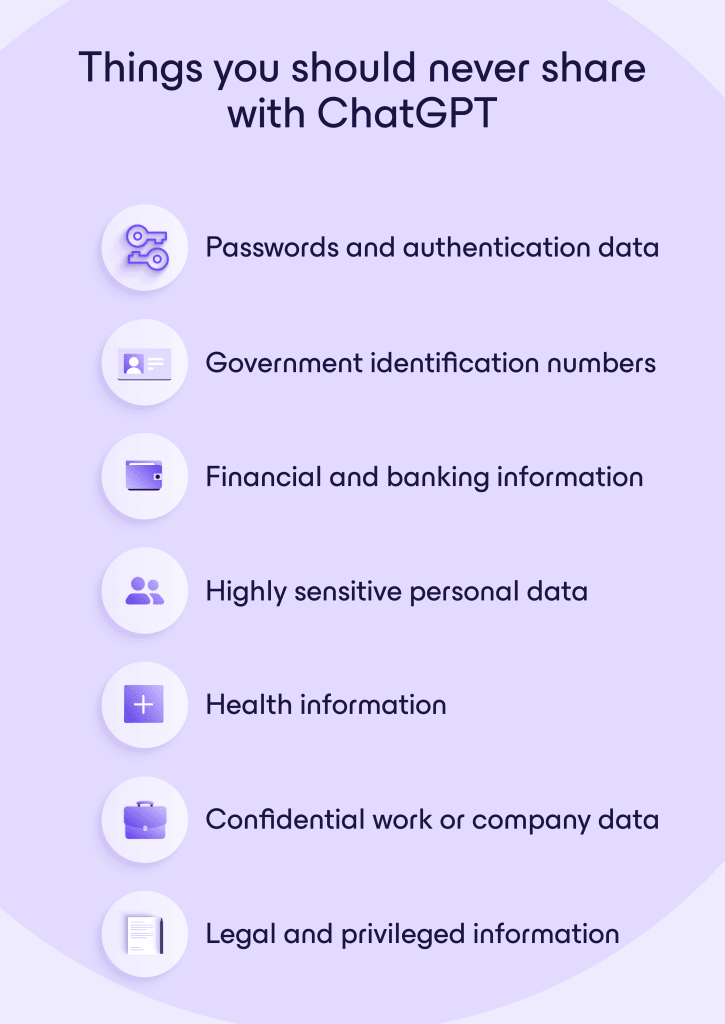

Cose che non dovresti mai condividere con ChatGPT

Anche se ChatGPT può essere utile, non dovresti mai trattarlo come una cassaforte sicura per informazioni sensibili. Evita di inserire qualsiasi cosa che potrebbe danneggiare te, la tua azienda o altri se fosse archiviato, esaminato o esposto accidentalmente:

Password e dati di autenticazione, come password degli account, codici di autenticazione a due fattori (2FA), codici di autenticazione di backup o chiavi API private.

Numeri di identificazione governativi, inclusi codici fiscali, carte d’identità nazionali, passaporti, patenti di guida (Driver) e numeri di identificazione fiscale.

Informazioni finanziarie e bancarie, come numeri di carte di credito o debito, IBAN, credenziali di banking online, login di account di investimento o chiavi private del portafoglio Bitcoin.

Dati personali altamente sensibili che potrebbero essere utilizzati per identificare o rintracciare te o la tua famiglia, come indirizzo di casa e numero di telefono, data di nascita, o foto e documenti in stato privato.

Informazioni sulla salute, come referti medici, cartelle cliniche diagnostiche, numeri di assicurazione, ID paziente o storie cliniche dettagliate legate alla tua identità.

Dati aziendali o di lavoro riservati, inclusi codice sorgente proprietario, documenti di strategia interna, contratti riservati, database di clienti, dettagli dei clienti, proiezioni finanziarie, rapporti non pubblicati o NDA.

Informazioni legali e privilegiate, come comunicazioni avvocato-cliente, strategie di cause legali, documenti di prova o discussioni riservate di transazione.

Come rimanere al sicuro quando usi ChatGPT

Non devi evitare del tutto gli strumenti IA, ma dovresti trattarli come servizi rivolti al pubblico piuttosto che come spazi di lavoro in stato privato. Alcune semplici abitudini possono ridurre significativamente il tuo rischio:

- Evita di condividere informazioni sensibili che non vorresti venissero esaminate, esposte pubblicamente o conservate in stato archiviato.

- Scegli di rimuovere i dettagli identificativi o sostituiscili con segnaposto o esempi fittizi.

- Devi caricare solo File che non contengono informazioni sensibili o riservate.

- Tratta le chat IA come email o ticket di supporto che potrebbero essere visti da altre persone.

- Rivedi le impostazioni privacy e scegli di disattivare impostazioni come la cronologia delle chat, la memoria o l’addestramento dell’IA.

- Scegli di eliminare le conversazioni di cui non hai più bisogno per ridurre la quantità di informazioni personali che rimangono associate al tuo account.

Passa a un assistente IA privato

Se ti preoccupa condividere informazioni personali o aziendali con strumenti IA, prova Lumo. La nostra alternativa privata a ChatGPT non produce log delle tue conversazioni né le utilizza per l’addestramento dei modelli. I tuoi dati sono protetti con crittografia asimmetrica bidirezionale (una forma di crittografia end-to-end) ed elaborati su server europei controllati da Proton.

Quando usi Lumo con un account Proton, le tue conversazioni sono protette con crittografia ad accesso zero, il che significa che solo tu puoi procedere a leggere tali dati, nemmeno Proton. Per la massima privacy, la modalità Fantasma ti consente di utilizzare Lumo senza salvare alcuna cronologia.

Lumo utilizza modelli open source, in modo che chiunque possa verificare che non avvengano tracciamenti nascosti o raccolte di dati.

Prova Lumo ora e scopri com’è l’IA quando la tua privacy conta di più. E quando sei pronto a portare quello stesso livello di privacy nel tuo ambiente di lavoro, Lumo for Business aiuta il tuo team a collaborare in modo sicuro e a rimanere produttivo senza compromettere i dati sensibili dell’azienda.

Puoi anche scaricare Lumo da Google Play(nuova finestra) o dall’App Store(nuova finestra).