ChatGPT — это мощный ИИ-помощник(новое окно), которым ежедневно пользуются миллионы пользователей, но безопасно ли его использовать? Он принадлежит и управляется OpenAI, одной из крупнейших технологических компаний в мире. И, как и многие платформы Big Tech, OpenAI собирает большие объемы пользовательских данных. Эти данные не защищены шифрованием с нулевым доступом, поэтому компания может раскрывать их бизнес-партнерам (включая рекламные и аналитические компании), правительству и хакерам в случае утечки данных.

За кулисами большие языковые модели (LLM) OpenAI постоянно учатся на том, что вы вводите. Конфиденциальные вопросы, например о симптомах болезни, юридических вопросах или интеллектуальной собственности, могут подпитывать сложные системы профилирования или помогать обучать модели ИИ, используемые далеко за пределами ваших изначальных намерений.

Опасения по поводу того, как компании ИИ обращаются с пользовательскими данными, растут. В марте 2026 года более 2,5 миллиона пользователей(новое окно) пообещали уйти из ChatGPT после спорного партнерства с правительством США, которое вызвало вопросы о том, как внедряются и регулируются системы ИИ. Это напоминает о том, что, взаимодействуя с ИИ-помощником без надежной защиты конфиденциальности, вы можете делиться большим объемом информации, чем осознаете.

- Безопасен ли ChatGPT? Риски использования ИИ вроде ChatGPT и других сервисов Big Tech

- Чем никогда не стоит делиться с ChatGPT

- Как оставаться в безопасности при использовании ChatGPT

- Перейдите на конфиденциального ИИ-помощника

Безопасен ли ChatGPT? Риски использования ИИ вроде ChatGPT и других сервисов Big Tech

Прежде чем выбирать инструменты ИИ, такие как ChatGPT, Gemini, Meta AI, Copilot и DeepSeek, стоит понять их риски для безопасности и конфиденциальности:

| Риск | Потенциальное воздействие | Почему это важно |

| Сбор и журналирование данных | Подсказки, загруженные файлы и шаблоны взаимодействия могут храниться | Могут использоваться для обучения ИИ, поведенческого профилирования или проверки человеком |

| Отсутствие шифрования с нулевым доступом | OpenAI и ее партнеры могут получать доступ к перепискам | Увеличивает риск раскрытия конфиденциальных данных |

| Регуляторные риски и риски для ИС | Риски, связанные с GDPR/HIPAA, или утечки служебных данных | Юридическая ответственность и финансовые последствия |

| Система с закрытым исходным кодом | Ограниченная прозрачность в обработке данных | Требует доверия к OpenAI |

| Реклама в приложении | Усиленное отслеживание и профилирование | Неясно, как данные чата влияют на персонализированную рекламу |

Личная конфиденциальность

Вот чем вы рискуете, используя ChatGPT:

- ChatGPT может собирать вводимую вами информацию — например вопросы, ответы и то, как вы взаимодействуете с инструментом, — чтобы обучать свои модели ИИ. Если вы загрузите резюме, юридический документ, медицинский отчет или другой файл с персональными данными, это содержимое тоже может храниться и обрабатываться.

- Даже если вы никогда не вводите свое имя или другие персональные данные, ваши запросы со временем могут раскрывать шаблоны, такие как проблемы со здоровьем, религиозные сомнения, политические взгляды, семейное положение или эмоциональное состояние. В сочетании с вашим IP-адресом(новое окно) и другими техническими идентификаторами эти шаблоны могут использоваться для создания подробных поведенческих профилей.

- Вы можете отказаться от обучения ИИ, но ваши переписки все равно журналируются, а конфиденциальные сведения могут видеть люди-проверяющие, если они будут помечены, например когда вы отправляете отзыв.

- История ваших чатов защищена во время передачи и хранения, но не защищена шифрованием с нулевым доступом, поэтому OpenAI или третья сторона все равно могут получить доступ к вашим прошлым перепискам.

- В июле 2025 года тысячи общих переписок ChatGPT появились в результатах поиска Google(новое окно), раскрыв глубоко личные обмены сообщениями, которые пользователи, вероятно, считали приватными. Вскоре OpenAI убрала эту функцию и заявила, что работает с Google над удалением результатов из индекса, но этот инцидент показывает, насколько легко взаимодействия с ИИ могут оказаться в публичном пространстве без вашего ведома.

- В начале 2026 года OpenAI ввела рекламу для пользователей ChatGPT на бесплатном тарифе и тарифе ChatGPT Go. Несмотря на заверения, что реклама не будет влиять на ответы и не будет связана с передачей персональных данных рекламодателям, этот шаг следует хорошо знакомому шаблону Big Tech, при котором реклама со временем становится нормой после первоначальных опасений по поводу конфиденциальности.

Бизнес-риски

OpenAI — американская компания, поэтому использование ChatGPT может вызывать опасения по поводу защиты данных и рисков утечки конфиденциальной информации. Если вы находитесь в Европе или в другом регионе, ваши данные все равно могут подпадать под юрисдикцию США, поскольку их обрабатывает американская компания. Вот что это означает:

- Без надежных гарантий защиты данных ваша организация рискует получить штрафы или столкнуться с вниманием регуляторов в рамках таких законов, как GDPR и HIPAA(новое окно).

- Вы рискуете утечками, обучая модели ИИ на данных вашей компании. Например, сотрудники могут вводить в ChatGPT служебный код, конфиденциальные контракты или информацию о клиентах, потенциально раскрывая интеллектуальную собственность, коммерческие тайны или данные клиентов.

- OpenAI может передавать данные партнерам, поставщикам, другим третьим сторонам или через интеграции приложений — а у них может быть более слабая защита конфиденциальности или иные политики в отношении данных. В 2025 году утечка у одного из аналитических поставщиков OpenAI раскрыла идентифицирующую информацию о клиентах API.

- Согласно законам США, таким как Patriot Act или FISA (Foreign Intelligence Surveillance Act), компании могут быть обязаны предоставлять данные государственным органам, часто с предписаниями о секретности, которые запрещают им уведомлять пользователей.

Недостаток прозрачности

Выше перечислены известные риски. Но особенно рискованным в ChatGPT (и другом программном обеспечении с закрытым исходным кодом) является то, что вам не разрешено знать.

- Код приложений ChatGPT не является открытым исходным кодом, поэтому общественный контроль за тем, как он работает, что журналирует и как обрабатывает ваши данные за кулисами, отсутствует. Вам приходится полагаться на политики OpenAI и доверять тому, что система ответственно обращается с данными.

- Хотя OpenAI выпустила модели с открытыми весами, которые можно публично изучать, модели ИИ, используемые ChatGPT, не имеют открытого исходного кода, поэтому вы не можете проверить, как данные были предварительно обучены на больших наборах данных.

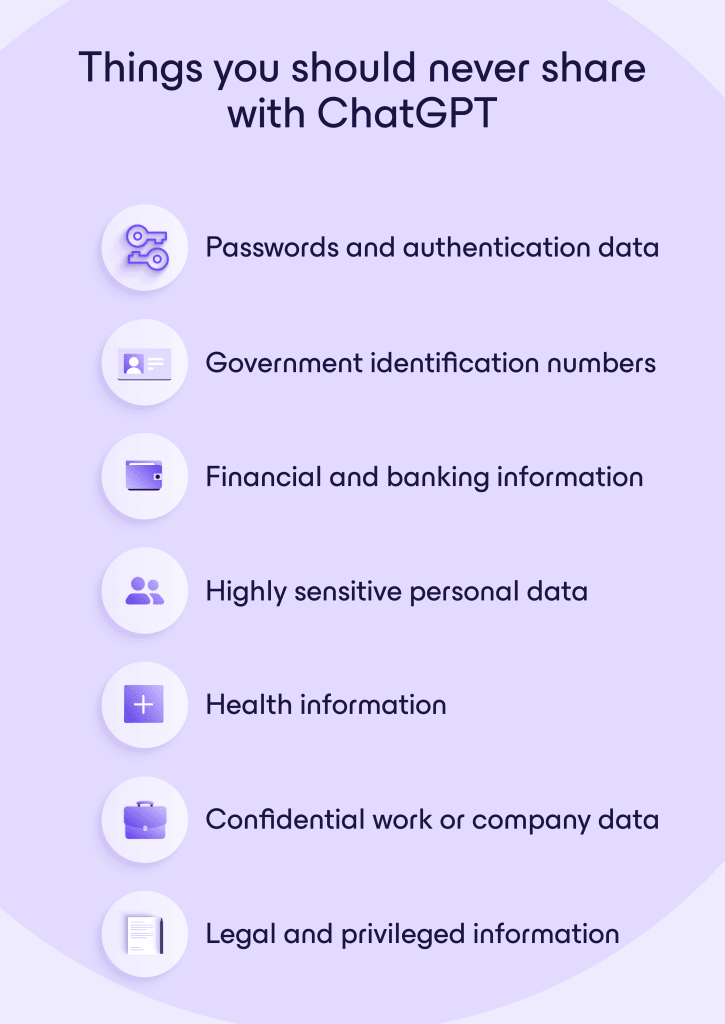

Чем никогда не стоит делиться с ChatGPT

Хотя ChatGPT может быть полезным, никогда не стоит воспринимать его как безопасное хранилище конфиденциальной информации. Не вводите ничего, что может навредить вам, вашей компании или другим людям, если это будет сохранено, проверено или случайно раскрыто:

Пароли и данные аутентификации, такие как пароли аккаунтов, коды двухфакторной аутентификации (2FA), резервные коды аутентификации или конфиденциальные ключи API.

Номера государственных удостоверений личности, включая номер социального страхования, национальный ID, паспорт, водительское удостоверение и налоговые идентификационные номера.

Финансовая и банковская информация, такая как номера кредитных или дебетовых карт, IBAN, учетные данные для онлайн-банкинга, данные для входа в инвестиционные аккаунты или конфиденциальные ключи Bitcoin-кошельков.

Крайне конфиденциальные персональные данные, которые могут использоваться для вашей идентификации или отслеживания вас или вашей семьи, например домашний адрес и номер телефона, дата рождения или конфиденциальные фотографии и документы.

Информация о здоровье, такая как медицинские отчеты, диагностические записи, страховые номера, ID пациентов или подробная история здоровья, связанная с вашей личностью.

Конфиденциальные рабочие или корпоративные данные, включая служебный исходный код, внутренние стратегические документы, конфиденциальные контракты, клиентские базы данных, данные клиентов, финансовые прогнозы, неопубликованные отчеты или NDA.

Юридическая и привилегированная информация, такая как переписка между адвокатом и клиентом, стратегии по юридическим делам, доказательные документы или конфиденциальные обсуждения урегулирования.

Как оставаться в безопасности при использовании ChatGPT

Вам не нужно полностью избегать инструментов ИИ, но стоит относиться к ним как к публичным сервисам, а не как к частным рабочим пространствам. Несколько простых привычек могут существенно снизить ваш риск:

- Не делитесь конфиденциальной информацией, которую вы не хотели бы видеть сохраненной, проверенной или раскрытой публично.

- Удаляйте идентифицирующие сведения или заменяйте их заполнителями либо вымышленными примерами.

- Загружайте только те файлы, которые не содержат конфиденциальной информации.

- Относитесь к чатам с ИИ как к электронным письмам или тикетам поддержки, которые могут увидеть другие люди.

- Проверяйте настройки конфиденциальности и отключайте такие параметры, как история чатов, память или обучение ИИ.

- Удаляйте переписки, которые вам больше не нужны, чтобы уменьшить объем персональной информации, связанной с вашим аккаунтом.

Перейдите на конфиденциального ИИ-помощника

Если вас беспокоит передача персональной или корпоративной информации инструментам ИИ, попробуйте Lumo. Наша конфиденциальная альтернатива ChatGPT никогда не журналирует ваши переписки и не использует их для обучения моделей. Ваши данные защищены двунаправленным асимметричным шифрованием (одной из форм сквозного шифрования) и обрабатываются на европейских серверах под контролем Proton.

Когда вы используете Lumo с аккаунтом Proton, ваши переписки защищены шифрованием с нулевым доступом, то есть читать их можете только вы — даже Proton не может. Для максимальной конфиденциальности режим Ghost mode позволяет использовать Lumo вообще без сохранения истории.

Lumo использует модели с открытым исходным кодом, поэтому любой может проверить, что скрытого отслеживания или сбора данных не происходит.

Попробуйте Lumo сейчас и посмотрите, как выглядит ИИ, когда ваша конфиденциальность важнее всего. А когда вы будете готовы обеспечить такой же уровень конфиденциальности на своем рабочем месте, Lumo for Business поможет вашей команде безопасно сотрудничать и оставаться продуктивной, не раскрывая конфиденциальные данные компании.

Вы также можете скачать Lumo из Google Play(новое окно) или App Store(новое окно).